HappyHorse-1.0:为什么这个新的 AI 视频模型备受关注

- 1. 深入探讨前的快速概述

- 2. HappyHorse-1.0 究竟是什么?

- 3. 它为何崛起得如此之快?

- 4. 它目前最强的领域

- 5. 开源声明:我们能验证什么,不能验证什么

- 6. HappyHorse 与 Seedance 2.0:优势在哪里,劣势又在哪里

- 7. 这对创作者、小团队和市场的影响

- 8. 如何在实际中评估 HappyHorse,而不仅仅是看炒作

- 9. 常见问题

- 10. 关于 HappyHorse-1.0 的总结

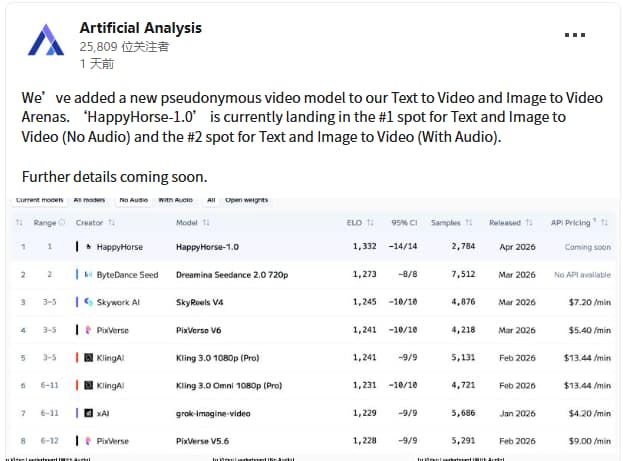

HappyHorse-1.0 之所以重要,主要原因是:它并未通过发布会、产品演示或创始人帖子进入 AI 视频领域的讨论。它是通过在 Artificial Analysis 上作为一个新的匿名视频模型出现的,并且已经在无音频文本转视频和图像转视频排名中占据首位,同时在音频支持类别中排名第二。这并不寻常,这也是人们关注它的原因。

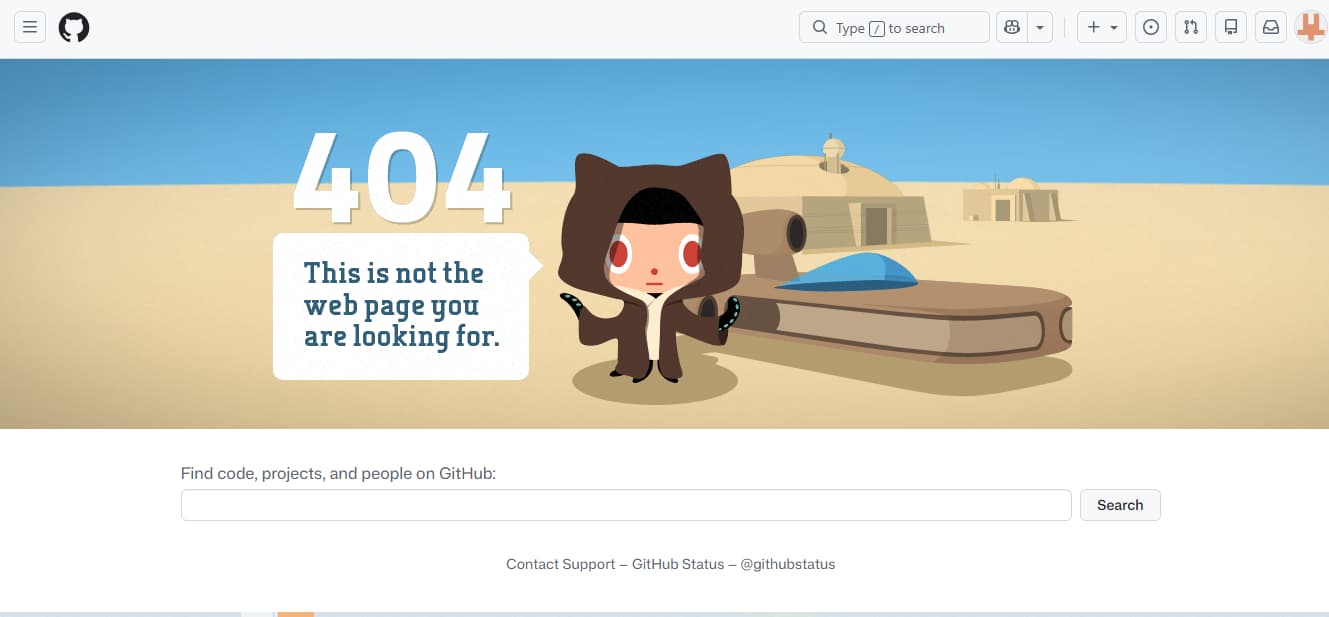

更难的部分是:公众故事仍然不完整。官方的 Happy Horse 网站描述了一个 15B 参数的统一 Transformer,可以联合生成视频和同步音频,支持七种唇同步语言,并能生成 5–8 秒的 1080p 视频片段。同一网站还声称模型、蒸馏检查点、超分辨率模块和推理代码已开放发布并具有商业使用权。但从该网站链接的 GitHub 仓库目前返回 404,而链接的 Hugging Face 账户显示0 个公开模型。因此,这不是一个动手部署的评测,而是一个更清晰的问题:HappyHorse-1.0 是什么?它为何如此迅速崛起?我们现在究竟能验证什么?

1. 深入探讨前的快速概述

| 信号 | 当前看起来真实的内容 | 为什么重要 |

|---|---|---|

| 身份 | HappyHorse-1.0 被 Artificial Analysis 作为一个匿名模型呈现 | 在所有权故事尚未确定之前,该模型已经影响了排名 |

| 排名状态 | 它在无音频文本转视频和图像转视频中排名第一,在音频支持类别中排名第二 | 这是一个强烈的偏好信号,而不仅仅是规格表上的声明 |

| 官方定位 | 官方网站将其定位为一个 15B 参数的统一 Transformer,用于联合视频 + 音频生成 | 这个定位远远超出了"另一个文本转视频模型" |

| 公众可验证性 | 网站声称开放发布并具有商业使用权,但链接的 GitHub 仓库 404,Hugging Face 上没有公开模型 | 这是故事中最大的信任缺口 |

| 当前最佳解读 | 强信号,不完整的证据 | 值得认真关注,但不能盲目相信 |

目前有一个来源承担了大部分"这是真实的"权重:Artificial Analysis 描述 HappyHorse-1.0 为一个新的匿名模型,并表示它在无音频文本转视频和图像转视频中占据了首位,同时在音频支持类别中排名第二。官方网站则承担了大部分"这是模型自我描述"的权重。这两者并不相同。将它们分开,故事就更容易理解。

结论:HappyHorse-1.0 已经拥有了强大的排名信号,迫使人们关注,但它尚未拥有赢得自动信任的公开发布轨迹。

2. HappyHorse-1.0 究竟是什么?

简短的回答是,HappyHorse-1.0 被定位为一个统一的多模态视频系统,而不仅仅是一个带有后期添加音频的无声视频生成器。官方网站称它是一个 15B 参数的 Transformer,可以从文本或图像提示中联合生成视频和同步音频,支持七种唇同步语言,采用 40 层自注意力架构,并以 5–8 秒的 1080p 视频片段为目标。这是向公众呈现的产品定义。

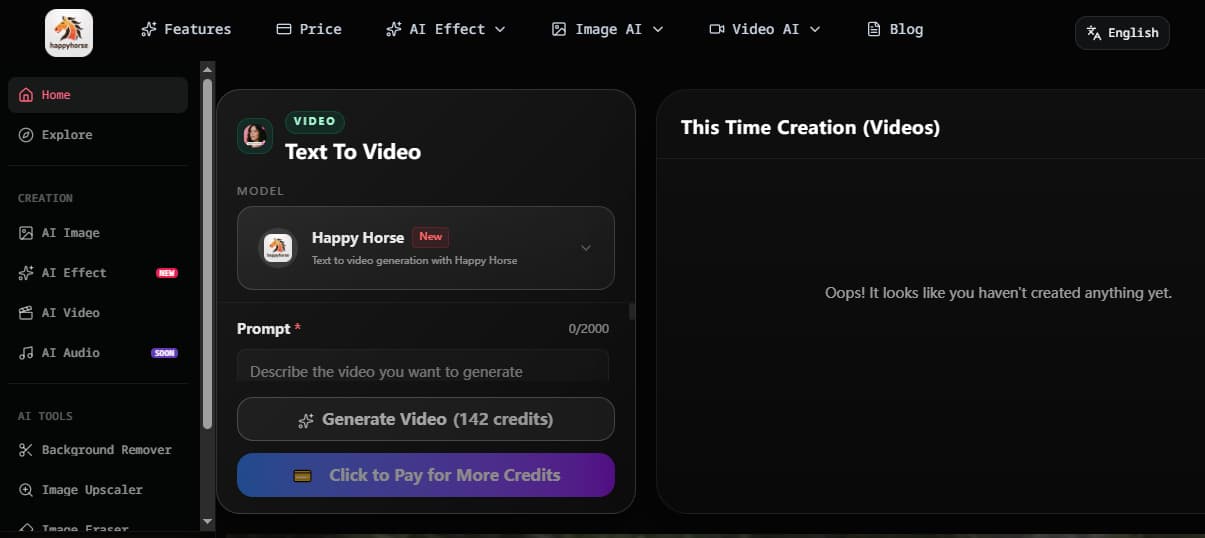

你还可以通过当前的示例视频片段更清楚地了解Happy Horse 1.0 的定位,例如下面的片段,突出了短小、精致、以表现力为主导的输出,这种输出正在塑造围绕该模型的讨论。

这种描述很重要,因为它改变了人们对其的看法。如果定位仅仅是"一个更好的扩散视频模型",这将只是一个排名故事。而现在的定位更接近于:一个模型,一次生成,一个输出流,其中对话、环境音效和唇同步一起解决。这是一个更具野心的主张。这也解释了为什么讨论迅速从"不错的排行榜结果"转向"这是否改变了开放和封闭系统之间的平衡?"

我不会将此写成传统的"测试评测"。公开的信息足以解释 HappyHorse 自称是什么,但不足以将每个部署声明视为既定事实。这种区分是有用文章和炒作文章之间的区别。

结论:HappyHorse-1.0 应首先被理解为一个声称的统一音视频生成系统,其次才是一个新的排行榜条目。

3. 它为何崛起得如此之快?

答案并不是"因为人们喜欢参数"。Artificial Analysis 的作用在于,它的排名基于盲用户偏好,而不是实验室风格的架构评分卡。36氪的报道也指出了这一点:排名是基于真实用户的盲测,这使得反应更难被视为营销噱头或基准测试漏洞。

我的解读是,HappyHorse 受益于比技术新颖性更人性化的因素。当人们投票选择短片时,他们并不是在评估模型卡片,而是在反应一个结果是否看起来可观看、连贯且完成。如果一个模型让 5–8 秒的短片看起来不像拼接的动作,而更像一个单一的导演节奏,这往往会迅速赢得关注。围绕联合音视频生成的官方定位正指向这一方向,即使更广泛的公众证明仍在追赶。

这也是故事传播如此迅速的原因。匿名模型通常不会获得信任,而是怀疑。HappyHorse 也得到了怀疑,但它仍然获得了关注,因为排名结果先行到达。人们不得不解释一个已经摆在他们面前的信号。

结论:HappyHorse 崛起得如此之快,是因为排名信号先于背景故事到达,而盲偏好胜利很难被轻易否定。

4. 它目前最强的领域

将 HappyHorse 称为"最好的视频模型"是最弱的写法。这对读者毫无帮助。更好的问题是,它最有可能首先在哪些领域建立优势。根据官方定位以及故事的讨论方式,最合理的答案并不是"所有领域"。而是以人为中心的短视频:肖像镜头、说话人形式、以图像为主导的片段、数字人内容,以及同步语音和面部时序比壮观物理效果更重要的短场景。

这并不意味着它不能在其他地方表现出色。这意味着当前最强的案例更为狭窄。官方网站本身强调了同步对话、环境音效、拟音、多语言唇同步以及社交平台友好的 1080p 视频片段。36氪也将机会框定为垂直领域,指出肖像、数字人和虚拟主播是开放模型达到"可交付"门槛后实际改变成本结构的用例。

下面的片段非常符合这种更狭窄的解读:短小、以表现力为主导,并围绕可观看性而非单纯的壮观效果构建。

这是一种更有用的思考方式。不是将其视为一个神奇的通用赢家,而是一个可能在商业上非常相关的切入点模型。

结论:当前最强的解读不是"HappyHorse 解决了视频问题",而是"HappyHorse 在面部、语音和短视频交付方面可能特别有意义。"

5. 开源声明:我们能验证什么,不能验证什么

这是大多数文章仍然模糊的部分。

可以验证的很简单。官方 Happy Horse 网站称该项目是开源的,包括商业使用权,并发布了基础模型、蒸馏模型、超分辨率模块和推理代码。它甚至提供了克隆 GitHub 仓库和从 Hugging Face 加载预训练模型的示例命令。这些声明显然在网站上。

无法轻易通过的是,这些公开发布声明是否已经与可访问、可验证的工件相匹配。从网站链接的 GitHub 仓库目前返回404 Not Found。链接的 Hugging Face 账户显示0 个模型且"尚无公开模型"。这并不能证明发布不会发生,但确实意味着"今天完全开源且可公开验证"这个说法过于强烈。

这一差距比人们想象的更重要。在 AI 视频领域,"开放"至少可以有三种不同的含义:

- 营销页面上的公开声明

- 带有条款的可下载工件

- 第三方实际上可以运行的可重现发布

HappyHorse 可能最终会达到第三种情况。今天,公共证据更接近第一种而非第三种。这就是为什么正确的编辑语气不是不相信,而是克制。

结论:HappyHorse 的开源故事是一个严肃的声明,但公众可验证性尚未赶上围绕它的语言。

6. HappyHorse 与 Seedance 2.0:优势在哪里,劣势又在哪里

最清晰的说法是:如果你的标准是无音频类别中的盲用户偏好,HappyHorse 已经以最强势的方式进入。这部分足够真实,足以引起关注。36氪明确将这一时刻框定为 HappyHorse 超越 Seedance 2.0 在 Artificial Analysis 上的表现,并将排名转变为一个真正的信号,而非另一个投机性的发布叙事。

需要更谨慎书写的是之后的所有内容。"击败 Seedance"可以意味着几种非常不同的事情。它可以意味着用户在盲测竞技场中更喜欢一组片段。它可以意味着模型更易于访问。它可以意味着模型更易于重现。它可以意味着模型是今天更好的商业选择。这些并不可以互换。而目前,HappyHorse 仅在第一种意义上有明确的领先。

这仍然是一个大事件。但这并不等同于说市场已经翻转。即使是更乐观的 36氪框架也没有超出这一点,并表示 HappyHorse 在短期内不会撼动 Seedance 或 Kling。这似乎是正确的谨慎程度。这更像是一个警告信号,而不是一个全面的政权更迭。

结论:HappyHorse 已经赢得了与 Seedance 严肃比较的权利,但尚未赢得被写成每个重要类别的既定赢家的权利。

7. 这对创作者、小团队和市场的影响

真正的故事是定价能力。

长期以来,闭源视频产品可以依赖一个简单的论点:开放模型很有趣,但不足以交付面向客户的工作。36氪表示,这种差距正是闭源玩家建立其定价能力的地方,这也是为什么这一时刻很重要。如果一个开放或准开放模型能够在真人盲测中接近"可交付"质量,市场就会开始问一个不同的问题:我们现在到底在为溢价支付什么?

这不会立即重写技术栈。团队仍然关心可用性、支持、正常运行时间、内容审核、文档和可预测的输出。闭源产品在很多方面仍然占优。但这就是故事变得有趣的地方。36氪将 HappyHorse 的出现框定为一个真正的开放与闭源定价能力信号,特别是在肖像、数字人和虚拟主播场景中,一旦质量从"可用"跨越到"可交付",自托管经济学可能会迅速改变。

这就是为什么不要轻视这一点,即使 HappyHorse 本身在一段时间内仍然部分未解决,市场信号已经出现。

结论:HappyHorse 的重要性在于它对"闭源模型是实现可交付视频质量的唯一可信途径"的叙事施加了压力。

8. 如何在实际中评估 HappyHorse,而不仅仅是看炒作

如果你真的想判断这一时刻的意义,不要从关于谁构建了它的抽象争论开始。从任务开始。

使用一个肖像。使用一个说话人脚本。使用一个产品图像。使用一个短场景描述。然后在以下关键点上比较输出:

- 镜头连贯性 — 片段是感觉像一个节奏,还是一系列不连贯的猜测?

- 面部稳定性 — 身份和表情从头到尾是否保持一致?

- 音频与画面匹配 — 如果涉及语音,片段看起来是解决的还是拼接的?

- 重运行可靠性 — 如果你需要三个可用版本,你会得到三个,还是一个幸运的例外?

这就是为什么我不会等到围绕 HappyHorse 的每一个传闻都被解决后再建立自己的基线。如果 HappyHorse 最终变得完全公开和可重现,这一基线将变得更加有价值。如果没有,你仍然学到了有用的东西:你的工作流程实际需要什么样的片段质量。

结论:对 HappyHorse 炒作周期的正确回应不是相信或不相信,而是受控比较。

9. 常见问题

什么是 HappyHorse-1.0?

HappyHorse-1.0 是一个匿名的 AI 视频模型,Artificial Analysis 表示它在无音频文本转视频和图像转视频中排名第一,在音频支持类别中排名第二。官方网站将其描述为一个 15B 参数的统一 Transformer,可以从文本或图像提示中联合生成视频和同步音频。

HappyHorse-1.0 是开源的吗?

官方网站是这样呈现的,称模型、蒸馏检查点、超分辨率模块和推理代码是开放发布的,并具有商业使用权。但链接的 GitHub 仓库目前返回 404,链接的 Hugging Face 账户没有公开模型。因此,今天最安全的表述是:声称开源,但尚未完全公开验证。

HappyHorse 比 Seedance 2.0 更好吗?

这取决于"更好"是什么意思。今天最强的公开案例是,HappyHorse 已经在盲用户偏好领域赢得了关注。这与证明它更易于访问、更易于重现或目前对每个团队来说是更好的生产选择并不相同。

今天可以使用 HappyHorse-1.0 吗?

你可以研究今天的公开声明。你可以讨论今天的排名信号。尚不清楚的是,第三方是否可以独立访问并重现官方网站所描述的完整发布,而不会遇到缺失链接或缺失工件。

谁现在最应该关注 HappyHorse?

从事肖像、数字人、虚拟主持人、说话人视频以及以图像为主导的短片制作的团队应该密切关注。这是当前排名信号和官方功能声明看起来最具商业相关性的领域。

10. 关于 HappyHorse-1.0 的总结

HappyHorse-1.0 的有趣之处不在于它带着一个精心打磨的产品故事到来,而在于它在没有产品故事的情况下,仍然强势进入了 AI 视频讨论的中心。Artificial Analysis 已经为它提供了一个人们无法忽视的排名信号。官方网站为它提供了一个雄心勃勃的身份。公开发布轨迹尚未赶上。这种紧张感就是故事本身。

我的判断很简单。将 HappyHorse 视为一个严肃的市场信号,而不是一个完全确定的事实模式。如果你的工作依赖于短小、以人为中心的视频,这是少数值得密切关注的新模型之一。如果你今天需要一个完全透明、完全文档化、完全可重现的发布,公开证据尚未达到。

这已经足够了。实际上已经足够多了。因为一旦一个模型在赢得用户偏好之前就赢得了完美的清晰度,每个闭源视频实验室都必须开始认真对待这一威胁。