HappyHorse-1.0: Por Que Este Novo Modelo de Vídeo de IA Está Chamando Tanta Atenção

- 1. Resumo Rápido Antes de Aprofundarmos

- 2. O Que é o HappyHorse-1.0, Exatamente?

- 3. Por Que Ele Subiu Tão Rápido?

- 4. Onde Parece Mais Forte Agora

- 5. A Reivindicação de Código Aberto: O Que Podemos Verificar, O Que Não Podemos

- 6. HappyHorse vs. Seedance 2.0: Onde a Vantagem é Real — e Onde Não É

- 7. O Que Isso Muda para Criadores, Pequenas Equipes e o Mercado

- 8. Como Avaliar o HappyHorse na Vida Real em Vez de Apenas Assistir ao Hype

- 9. FAQ

- 10. A Conclusão sobre o HappyHorse-1.0

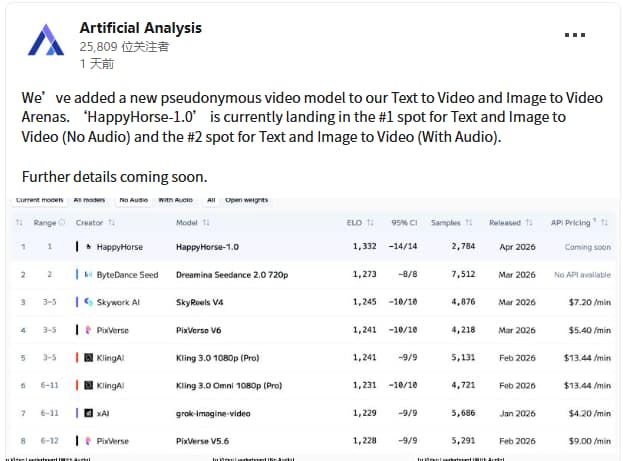

HappyHorse-1.0 importa por uma razão acima de tudo: ele não entrou na conversa sobre vídeo de IA por meio de um evento de lançamento, uma demonstração de produto ou uma thread do fundador. Ele entrou aparecendo no Artificial Analysis como um novo modelo de vídeo pseudônimo que já estava liderando os rankings de texto-para-vídeo e imagem-para-vídeo sem áudio, enquanto ocupava o segundo lugar nas categorias com áudio ativado. Isso não é normal. É por isso que as pessoas estão prestando atenção.

A parte mais difícil é esta: a história pública ainda está incompleta. O site oficial do Happy Horse descreve um Transformer unificado de 15B que gera conjuntamente vídeo e áudio sincronizado, suporta sete idiomas de sincronização labial e pode produzir clipes de 5 a 8 segundos em 1080p. O mesmo site também afirma que o modelo, o checkpoint destilado, o módulo de super-resolução e o código de inferência são lançados abertamente com direitos de uso comercial. Mas o repositório do GitHub vinculado a esse site atualmente retorna um 404, e a conta vinculada no Hugging Face mostra 0 modelos públicos. Portanto, esta não é uma análise prática de implantação. É uma questão mais clara: o que é o HappyHorse-1.0, por que ele subiu tão rápido e o que podemos realmente verificar agora?

1. Resumo Rápido Antes de Aprofundarmos

| Sinal | O que parece verdadeiro agora | Por que importa |

|---|---|---|

| Identidade | HappyHorse-1.0 foi apresentado pelo Artificial Analysis como um modelo pseudônimo | O modelo já está influenciando os rankings antes de sua história de propriedade ser resolvida |

| Status no ranking | Está em 1º lugar em texto-para-vídeo e imagem-para-vídeo sem áudio, e em 2º lugar nas categorias com áudio ativado | Este é um sinal de preferência forte, não apenas uma alegação de especificações |

| Posicionamento oficial | O site oficial o apresenta como um Transformer unificado de 15B para geração conjunta de vídeo + áudio | A proposta é muito maior do que "mais um modelo de texto-para-vídeo" |

| Verificabilidade pública | O site afirma lançamento aberto e direitos de uso comercial, mas o repositório do GitHub vinculado retorna 404 e o Hugging Face não tem modelo público ainda | Esta é a maior lacuna de confiança na história |

| Melhor leitura atual | Sinal forte, prova incompleta | Vale atenção séria, mas não certeza cega |

Uma fonte está carregando a maior parte do peso do "isso é real" no momento: Artificial Analysis descreveu o HappyHorse-1.0 como um novo modelo pseudônimo e disse que ele estava ocupando o primeiro lugar em texto-para-vídeo e imagem-para-vídeo sem áudio, enquanto ficava em segundo lugar nas categorias com áudio ativado. O site oficial está carregando a maior parte do peso do "é isso que o modelo afirma ser". Essas não são a mesma coisa. Mantenha-as separadas e a história fica muito mais fácil de ler.

Conclusão: HappyHorse-1.0 já tem o tipo de sinal de ranking que força atenção, mas ainda não tem o tipo de trilha de lançamento público que ganha confiança automática.

2. O Que é o HappyHorse-1.0, Exatamente?

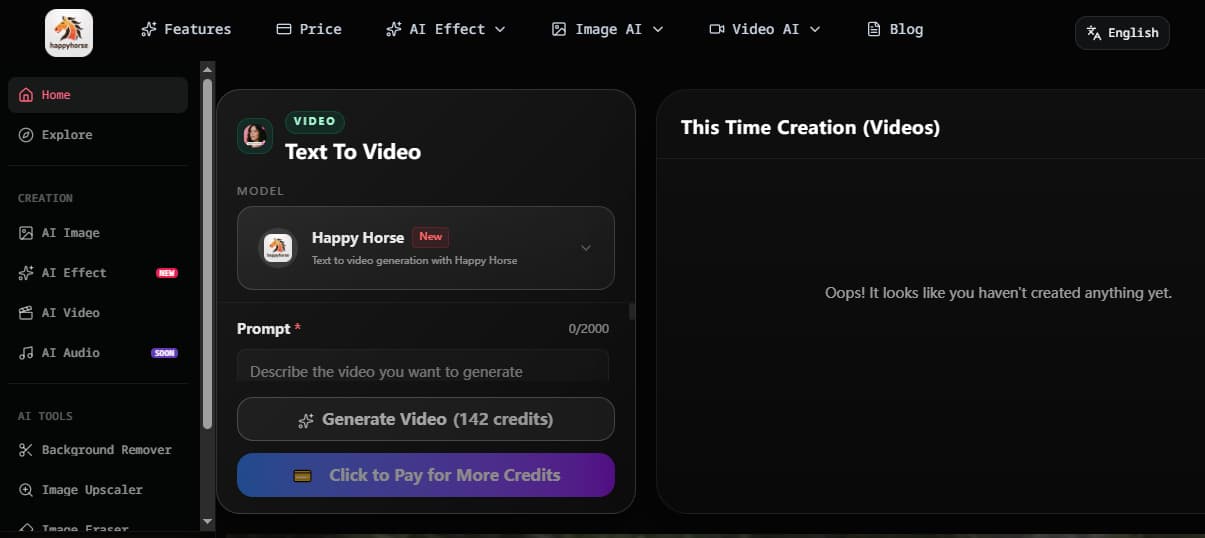

A resposta curta é que o HappyHorse-1.0 está sendo apresentado como um sistema de vídeo multimodal unificado, não apenas um gerador de vídeo silencioso com áudio adicionado posteriormente. O site oficial afirma que é um Transformer de 15 bilhões de parâmetros que produz conjuntamente vídeo e áudio sincronizado a partir de prompts de texto ou imagem, suporta sete idiomas de sincronização labial, utiliza uma arquitetura de autoatenção de 40 camadas e visa clipes de 5 a 8 segundos em 1080p. Essa é a definição de produto sendo apresentada ao público.

Você também pode ter uma ideia mais clara de como Happy Horse 1.0 está sendo posicionado a partir de clipes de exemplo atuais como o abaixo, que enfatiza o tipo de saída curta, polida e orientada por desempenho que agora molda a conversa em torno do modelo.

Essa descrição é importante porque muda o que as pessoas pensam que estão vendo. Se a proposta fosse simplesmente "um modelo de vídeo de difusão melhor", isso seria uma história de rankings. Em vez disso, a proposta é mais próxima de: um modelo, uma passagem, um fluxo de saída onde diálogo, som ambiente e sincronização labial são resolvidos juntos. Essa é uma reivindicação muito mais ambiciosa. Também explica por que a discussão mudou tão rapidamente de "bom resultado no ranking" para "isso muda o equilíbrio entre sistemas abertos e fechados?"

Eu não escreveria isso como uma "análise testada" convencional ainda. As informações públicas são suficientes para explicar o que o HappyHorse diz que é. Não é suficiente para tratar todas as alegações de implantação como resolvidas. Essa distinção é a diferença entre um artigo útil e um post de hype.

Conclusão: HappyHorse-1.0 deve ser entendido primeiro como um sistema de geração de áudio e vídeo unificado reivindicado, e apenas em segundo lugar como uma nova entrada no ranking.

3. Por Que Ele Subiu Tão Rápido?

A resposta não é "porque as pessoas amam parâmetros". O Artificial Analysis é útil aqui precisamente porque seu ranking é baseado na preferência cega do usuário, não em um placar de arquitetura estilo laboratório. A cobertura do 36Kr fez o mesmo ponto: o ranking é construído a partir de testes cegos de usuários reais, o que torna a reação mais difícil de descartar como um truque de marketing ou uma brecha de benchmark.

Minha leitura é que o HappyHorse está se beneficiando de algo mais humano do que uma novidade técnica. Quando as pessoas votam em clipes curtos, elas não estão avaliando cartões de modelo. Elas estão reagindo a se um resultado parece assistível, coerente e acabado. Se um modelo faz clipes de 5 a 8 segundos parecerem menos como movimento costurado e mais como um único ritmo dirigido, isso tende a ganhar atenção rapidamente. O posicionamento oficial em torno da geração conjunta de áudio e vídeo aponta exatamente nessa direção, mesmo que a prova pública mais ampla ainda esteja alcançando.

Isso também explica por que a história se espalhou tão rapidamente. Modelos anônimos geralmente não recebem o benefício da dúvida. Eles recebem suspeitas. O HappyHorse também recebeu suspeitas. Mas chamou atenção mesmo assim, porque o resultado do ranking chegou primeiro. As pessoas tiveram que explicar um sinal que já estava na frente delas.

Conclusão: HappyHorse subiu rapidamente porque o sinal de ranking apareceu antes da história de fundo, e vitórias de preferência cega são difíceis de ignorar.

4. Onde Parece Mais Forte Agora

A maneira mais fraca de escrever sobre o HappyHorse é chamá-lo de "o melhor modelo de vídeo, ponto final." Isso não diz nada ao leitor. A melhor pergunta é onde ele parece mais provável de estabelecer uma vantagem primeiro. Com base no posicionamento oficial e na forma como a história está sendo discutida, a resposta mais plausível não é "tudo". É vídeo curto centrado em pessoas: retratos, formatos de cabeça falante, clipes baseados em imagens, conteúdo humano digital e cenas curtas onde fala sincronizada e tempo facial importam mais do que física espetacular.

Isso não significa que ele não possa ter um bom desempenho em outros lugares. Significa que o caso mais forte atual é mais restrito. O próprio site oficial enfatiza diálogo sincronizado, som ambiente, Foley, sincronização labial multilíngue e clipes prontos para redes sociais em 1080p. O 36Kr também enquadrou a oportunidade em termos verticais, apontando para retratos, humanos digitais e âncoras virtuais como os tipos de casos de uso onde um modelo aberto atingindo um limiar "entregável" realmente mudaria a estrutura de custos.

O clipe abaixo se encaixa bem nessa leitura mais restrita: curto, orientado por desempenho e construído em torno da assistibilidade em vez de apenas espetáculo.

Essa é uma maneira mais útil de pensar sobre isso. Não como um vencedor universal mágico. Como um modelo que pode ter encontrado uma brecha comercialmente muito relevante.

Conclusão: A leitura mais forte atual não é "HappyHorse resolve vídeo." É "HappyHorse pode ser especialmente significativo onde rostos, vozes e entrega de formato curto importam mais."

5. A Reivindicação de Código Aberto: O Que Podemos Verificar, O Que Não Podemos

Esta é a parte que a maioria dos artigos ainda confunde.

O que pode ser verificado é simples. O site oficial do Happy Horse afirma que o projeto é de código aberto, inclui direitos de uso comercial e lança o modelo base, modelo destilado, módulo de super-resolução e código de inferência. Ele até fornece comandos de exemplo para clonar um repositório do GitHub e carregar um modelo pré-treinado do Hugging Face. Essas alegações estão claramente no site.

O que não pode ser aceito sem questionamento é se essas alegações de lançamento público já são correspondidas por artefatos acessíveis e verificáveis. O repositório do GitHub vinculado ao site atualmente retorna 404 Not Found. A conta vinculada no Hugging Face mostra 0 modelos e "Nenhum público ainda." Isso não prova que o lançamento não acontecerá. Significa que "totalmente de código aberto e publicamente verificável hoje" é uma frase forte demais no momento.

Essa lacuna importa mais do que as pessoas pensam. Em vídeo de IA, "aberto" pode significar pelo menos três coisas diferentes:

- uma alegação pública em uma página de marketing

- um artefato baixável com termos

- um lançamento reproduzível que terceiros podem realmente executar

HappyHorse ainda pode chegar ao terceiro nível. Hoje, as evidências públicas estão muito mais próximas do primeiro do que do terceiro. É por isso que o tom editorial correto não é descrença. É contenção.

Conclusão: A história de código aberto do HappyHorse é uma reivindicação séria, mas a verificabilidade pública ainda não alcançou a linguagem usada em torno dela.

6. HappyHorse vs. Seedance 2.0: Onde a Vantagem é Real — e Onde Não É

A coisa mais limpa a dizer é esta: se seu padrão é preferência cega do usuário nas categorias sem áudio, HappyHorse já fez a entrada mais forte possível. Essa parte é real o suficiente para importar. O 36Kr enquadrou explicitamente o momento como o HappyHorse superando o Seedance 2.0 no Artificial Analysis e transformando os rankings em um sinal genuíno em vez de outra narrativa especulativa de lançamento.

A parte que deve ser escrita com mais cuidado é tudo depois disso. "Superar o Seedance" pode significar algumas coisas muito diferentes. Pode significar que os usuários preferiram um conjunto de clipes em uma arena cega. Pode significar que o modelo é mais fácil de acessar. Pode significar que o modelo é mais reproduzível. Pode significar que o modelo é uma escolha de negócios melhor hoje. Essas coisas não são intercambiáveis. E agora, HappyHorse só tem uma liderança clara no primeiro sentido.

Isso ainda é um grande negócio. Mas não é o mesmo que dizer que o mercado mudou. Mesmo o enquadramento mais otimista do 36Kr para por aí e diz que o HappyHorse não vai abalar o Seedance ou o Kling no curto prazo. Isso parece o nível certo de cautela. Isso parece mais um tiro de advertência do que uma mudança total de regime.

Conclusão: HappyHorse ganhou o direito de ser comparado seriamente com o Seedance, mas não ganhou o direito de ser escrito como o vencedor estabelecido de todas as categorias que importam.

7. O Que Isso Muda para Criadores, Pequenas Equipes e o Mercado

A verdadeira história aqui é o poder de precificação.

Por muito tempo, produtos de vídeo de código fechado puderam contar com um argumento simples: modelos abertos eram interessantes, mas não bons o suficiente para enviar trabalhos voltados para clientes. O 36Kr diz que essa lacuna é exatamente onde os players fechados construíram grande parte de seu poder de precificação, e é por isso que este momento importa. Se um modelo aberto ou quase aberto puder se aproximar o suficiente da qualidade "entregável" em testes cegos avaliados por humanos, o mercado começa a fazer uma pergunta diferente: exatamente pelo que estamos pagando o prêmio agora?

Isso não reescreve instantaneamente a pilha. As equipes ainda se preocupam com disponibilidade, suporte, tempo de atividade, moderação, documentação e saída previsível. Produtos fechados ainda vencem em muitos desses aspectos. Mas é aqui que a história fica interessante. 36Kr enquadrou o surgimento do HappyHorse como um sinal real de poder de precificação aberto vs. fechado, especialmente em retratos, humanos digitais e cenários de âncoras virtuais onde a economia de auto-hospedagem poderia mudar rapidamente uma vez que a qualidade cruzasse o limiar de "usável" para "entregável."

Essa é a razão mais profunda para não descartar isso como uma curiosidade. Mesmo que o próprio HappyHorse permaneça parcialmente não resolvido por um tempo, o sinal do mercado já está aí.

Conclusão: HappyHorse importa porque pressiona a narrativa de que modelos fechados são a única rota credível para qualidade de vídeo enviável.

8. Como Avaliar o HappyHorse na Vida Real em Vez de Apenas Assistir ao Hype

Se você realmente quer julgar o que este momento significa, não comece com argumentos abstratos sobre quem o construiu. Comece com tarefas.

Use um retrato. Use um script de cabeça falante. Use uma imagem de produto. Use uma descrição curta de cena. Em seguida, compare saídas nas coisas que importam quando um clipe precisa sair da pasta de testes:

- Coerência do clipe — o clipe parece um ritmo único ou uma sequência de palpites desconexos?

- Estabilidade facial — a identidade e a expressão se mantêm do início ao fim?

- Ajuste áudio-imagem — se houver fala envolvida, o clipe parece resolvido ou costurado?

- Confiabilidade de reexecução — se você precisar de três versões utilizáveis, você obtém três ou um caso de sorte?

É por isso que eu não esperaria que todos os rumores em torno do HappyHorse fossem resolvidos antes de construir sua própria linha de base. Se o HappyHorse eventualmente se tornar totalmente público e reproduzível, essa linha de base se tornará ainda mais valiosa. Se não, você ainda aprendeu algo útil: que tipo de qualidade de clipe seu fluxo de trabalho realmente precisa.

Envie uma imagem de referência e execute seu próprio teste lado a lado

Conclusão: A resposta certa ao ciclo de hype do HappyHorse não é crença ou descrença. É comparação controlada.

9. FAQ

O que é o HappyHorse-1.0?

HappyHorse-1.0 é um modelo de vídeo de IA pseudônimo que o Artificial Analysis afirma estar em 1º lugar em texto-para-vídeo e imagem-para-vídeo sem áudio, e em 2º lugar nas categorias com áudio ativado. O site oficial o descreve como um Transformer unificado de 15B que gera conjuntamente vídeo e áudio sincronizado a partir de prompts de texto ou imagem.

O HappyHorse-1.0 é de código aberto?

Está sendo apresentado dessa forma no site oficial, que afirma que o modelo, o checkpoint destilado, o módulo de super-resolução e o código de inferência são lançados abertamente com direitos de uso comercial. Mas o repositório do GitHub vinculado atualmente retorna 404, e a conta vinculada no Hugging Face não tem modelo público ainda. Então, a redação mais segura hoje é: reivindicado como código aberto, ainda não totalmente verificável publicamente.

O HappyHorse é melhor que o Seedance 2.0?

Depende do que "melhor" significa. O caso público mais forte hoje é que o HappyHorse já está ganhando atenção em arenas de preferência cega do usuário. Isso não é o mesmo que provar que é mais fácil de acessar, mais fácil de reproduzir ou a melhor escolha de produção para todas as equipes agora.

Você pode usar o HappyHorse-1.0 hoje?

Você pode estudar as alegações públicas hoje. Você pode falar sobre o sinal de ranking hoje. O que ainda não está claro é se um terceiro pode acessar e reproduzir independentemente o lançamento completo conforme descrito no site oficial sem encontrar links ou artefatos ausentes.

Quem deve prestar mais atenção ao HappyHorse agora?

Equipes que trabalham com retratos, humanos digitais, apresentadores virtuais, vídeos de cabeça falante e clipes curtos baseados em imagens devem observá-lo de perto. É aí que a combinação atual de sinal de ranking e reivindicações de recursos oficiais parece mais comercialmente relevante.

10. A Conclusão sobre o HappyHorse-1.0

HappyHorse-1.0 não é interessante porque chegou com uma história de produto polida. É interessante porque chegou sem uma e ainda assim forçou seu caminho para o centro da conversa sobre vídeo de IA. O Artificial Analysis já deu a ele um sinal de ranking que as pessoas não podem ignorar. O site oficial deu a ele uma identidade ambiciosa. A trilha de lançamento público ainda não alcançou. Essa tensão é a história.

Meu julgamento é simples. Trate o HappyHorse como um sinal de mercado sério, não como um padrão de fato totalmente estabelecido. Se seu trabalho depende de vídeos curtos centrados em pessoas, este é um dos poucos novos modelos que vale a pena acompanhar de perto. Se você precisa de um lançamento totalmente transparente, totalmente documentado e totalmente reproduzível hoje, as evidências públicas ainda não estão lá.

E isso é suficiente. Mais do que suficiente, na verdade. Porque uma vez que um modelo pode ganhar preferência do usuário antes de ganhar clareza perfeita, todos os laboratórios de vídeo fechados têm que começar a levar a ameaça a sério.