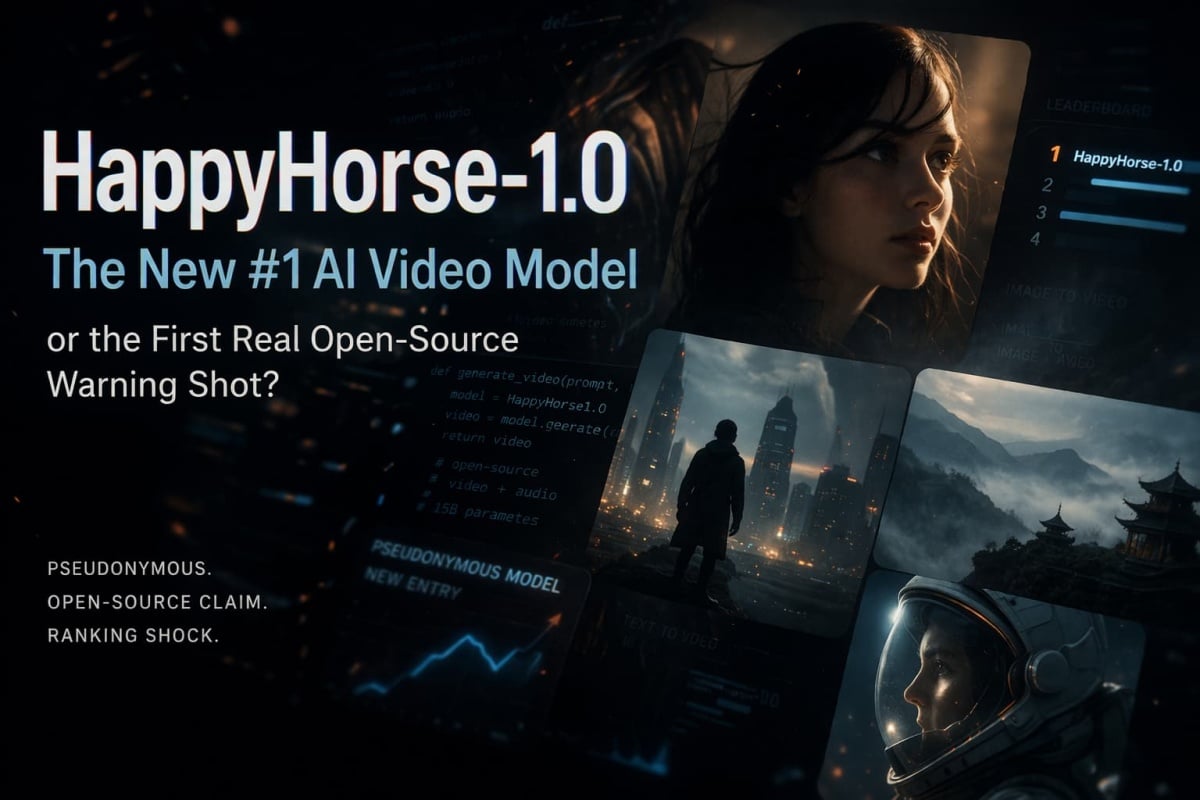

HappyHorse-1.0 : Pourquoi ce nouveau modèle vidéo IA attire autant l'attention

- 1. Aperçu rapide avant d'aller plus loin

- 2. Qu'est-ce que HappyHorse-1.0, exactement ?

- 3. Pourquoi a-t-il progressé si rapidement ?

- 4. Où il semble le plus fort en ce moment

- 5. La revendication open-source : ce que nous pouvons vérifier, ce que nous ne pouvons pas

- 6. HappyHorse vs. Seedance 2.0 : Où l'avantage est réel — et où il ne l'est pas

- 7. Ce que cela change pour les créateurs, les petites équipes et le marché

- 8. Comment évaluer HappyHorse dans la vie réelle au lieu de simplement regarder le battage

- 9. FAQ

- 10. Conclusion sur HappyHorse-1.0

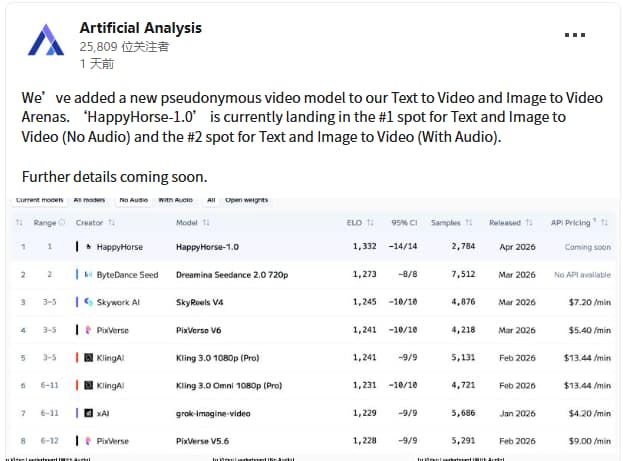

HappyHorse-1.0 est important pour une raison avant tout : il n'est pas entré dans la conversation sur la vidéo IA via un événement de lancement, une démonstration de produit ou un fil de discussion du fondateur. Il est apparu sur Artificial Analysis comme un nouveau modèle vidéo pseudonyme qui était déjà en tête des classements de texte-à-vidéo et image-à-vidéo sans audio, tout en se classant deuxième dans les catégories avec audio activé. Ce n'est pas normal. C'est pourquoi les gens y prêtent attention.

La partie la plus difficile est celle-ci : l'histoire publique est encore incomplète. Le site officiel de Happy Horse décrit un Transformer unifié de 15 milliards de paramètres qui génère conjointement des vidéos et des audios synchronisés, prend en charge sept langues de synchronisation labiale et peut produire des clips 1080p de 5 à 8 secondes. Le même site indique également que le modèle, le checkpoint distillé, le module de super-résolution et le code d'inférence sont publiés ouvertement avec des droits d'utilisation commerciale. Mais le dépôt GitHub lié à ce site renvoie actuellement un 404, et le compte Hugging Face lié montre 0 modèles publics. Ce n'est donc pas un examen de déploiement pratique. C'est une question plus claire : qu'est-ce que HappyHorse-1.0, pourquoi a-t-il progressé si rapidement, et que pouvons-nous réellement vérifier en ce moment ?

1. Aperçu rapide avant d'aller plus loin

| Signal | Ce qui semble vrai en ce moment | Pourquoi cela compte |

|---|---|---|

| Identité | HappyHorse-1.0 a été présenté par Artificial Analysis comme un modèle pseudonyme | Le modèle influence déjà les classements avant que son histoire de propriété ne soit réglée |

| Statut de classement | Il est classé n°1 dans les catégories texte-à-vidéo et image-à-vidéo sans audio, et n°2 dans les catégories avec audio activé | C'est un signal de préférence fort, pas seulement une affirmation sur la fiche technique |

| Positionnement officiel | Le site officiel le présente comme un Transformer unifié de 15 milliards de paramètres pour la génération conjointe vidéo + audio | L'argument est bien plus ambitieux que « un autre modèle texte-à-vidéo » |

| Vérifiabilité publique | Le site prétend une publication ouverte et des droits d'utilisation commerciale, mais le dépôt GitHub lié renvoie un 404 et Hugging Face n'a pas encore de modèle public | C'est le plus grand écart de confiance dans l'histoire |

| Meilleure lecture actuelle | Signal fort, preuve incomplète | Mérite une attention sérieuse, mais pas une certitude aveugle |

Une source porte actuellement la majeure partie du poids du « ceci est réel » : Artificial Analysis a décrit HappyHorse-1.0 comme un nouveau modèle pseudonyme et a indiqué qu'il prenait la première place dans les catégories texte-à-vidéo et image-à-vidéo sans audio, tout en se classant deuxième dans les catégories avec audio activé. Le site officiel porte la majeure partie du poids du « voici ce que le modèle prétend être ». Ce ne sont pas la même chose. Les garder séparés rend l'histoire beaucoup plus facile à lire.

Conclusion : HappyHorse-1.0 a déjà le type de signal de classement qui force l'attention, mais il n'a pas encore le type de publication publique qui inspire une confiance automatique.

2. Qu'est-ce que HappyHorse-1.0, exactement ?

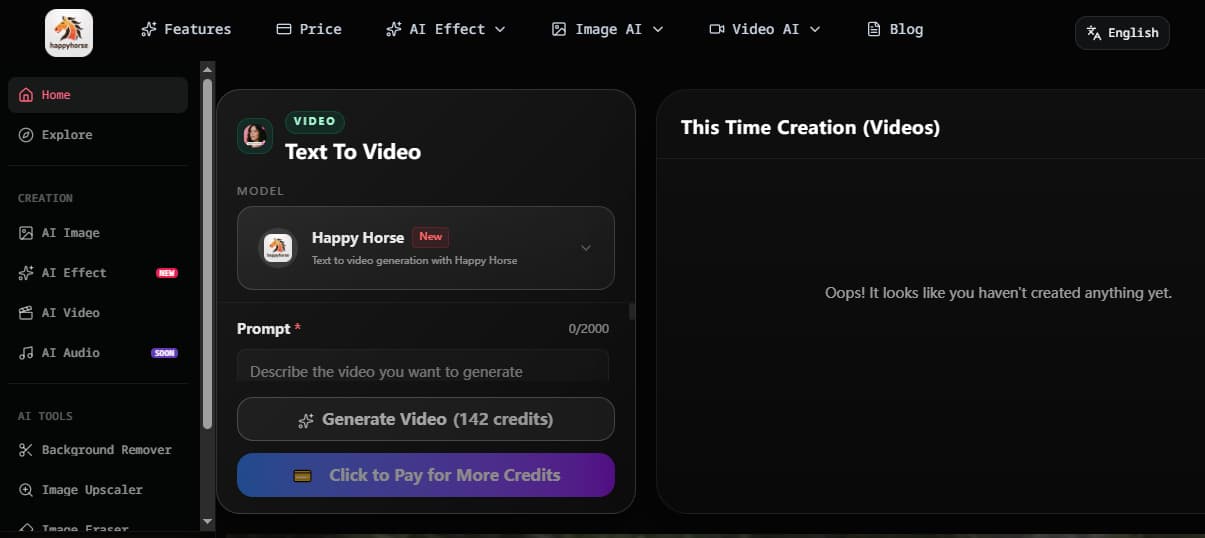

La réponse courte est que HappyHorse-1.0 est présenté comme un système vidéo multimodal unifié, pas seulement un générateur de vidéo silencieuse avec audio ajouté plus tard. Le site officiel indique qu'il s'agit d'un Transformer de 15 milliards de paramètres qui produit conjointement des vidéos et des audios synchronisés à partir de textes ou d'images, prend en charge sept langues de synchronisation labiale, utilise une architecture d'auto-attention à 40 couches, et vise des clips 1080p de 5 à 8 secondes. C'est la définition du produit présentée au public.

Vous pouvez également avoir une idée plus claire de la façon dont Happy Horse 1.0 est positionné à partir des clips d'exemple actuels comme celui ci-dessous, qui met en avant le type de sortie courte, soignée et axée sur la performance qui façonne maintenant la conversation autour du modèle.

Cette description est importante car elle change ce que les gens pensent qu'ils regardent. Si l'argument était simplement « un meilleur modèle de vidéo par diffusion », ce serait une histoire de classement. Au lieu de cela, l'argument est plus proche de : un modèle, un passage, un flux de sortie où le dialogue, le son ambiant et la synchronisation labiale sont résolus ensemble. C'est une affirmation beaucoup plus ambitieuse. Cela explique également pourquoi la discussion est passée si rapidement de « bon résultat de classement » à « cela change-t-il l'équilibre entre systèmes ouverts et fermés ? »

Je n'écrirais pas cela comme une « revue testée » conventionnelle pour l'instant. Les informations publiques suffisent à expliquer ce que HappyHorse prétend être. Elles ne suffisent pas à traiter chaque affirmation de déploiement comme un fait établi. Cette distinction est la différence entre un article utile et un post de battage.

Conclusion : HappyHorse-1.0 doit d'abord être compris comme un système revendiqué de génération audio-vidéo unifié, et seulement ensuite comme une nouvelle entrée au classement.

3. Pourquoi a-t-il progressé si rapidement ?

La réponse n'est pas « parce que les gens aiment les paramètres ». Artificial Analysis est utile ici précisément parce que son classement est basé sur la préférence utilisateur aveugle, et non sur une fiche technique de style laboratoire. La couverture de 36Kr a fait le même point : le classement est construit à partir de tests aveugles d'utilisateurs réels, ce qui rend la réaction plus difficile à rejeter comme un tour de marketing ou une faille de benchmark.

Mon analyse est que HappyHorse bénéficie de quelque chose de plus humain qu'une nouveauté technique. Lorsque les gens votent sur des clips courts, ils n'évaluent pas des fiches techniques. Ils réagissent à savoir si un résultat semble regardable, cohérent et terminé. Si un modèle rend les clips de 5 à 8 secondes moins comme des mouvements assemblés et plus comme un seul rythme dirigé, cela tend à attirer rapidement l'attention. Le positionnement officiel autour de la génération conjointe audio-vidéo pointe exactement dans cette direction, même si la preuve publique plus large est encore en train de rattraper.

C'est aussi pourquoi l'histoire s'est propagée si rapidement. Les modèles anonymes ne bénéficient généralement pas du doute. Ils suscitent la suspicion. HappyHorse a également suscité la suspicion. Mais il a attiré l'attention quand même, parce que le résultat du classement est arrivé en premier. Les gens ont dû expliquer un signal qui était déjà devant eux.

Conclusion : HappyHorse a progressé rapidement parce que le signal de classement est arrivé avant l'histoire de fond, et les victoires de préférence aveugle sont difficiles à écarter.

4. Où il semble le plus fort en ce moment

La pire façon d'écrire sur HappyHorse est de l'appeler « le meilleur modèle vidéo, point final ». Cela ne dit rien au lecteur. La meilleure question est où il semble le plus susceptible de prendre un avantage en premier. Sur la base du positionnement officiel et de la façon dont l'histoire est discutée, la réponse la plus plausible n'est pas « tout ». C'est vidéo courte centrée sur les personnes : portraits, formats de présentateurs, clips basés sur des images, contenu humain numérique et scènes courtes où le discours synchronisé et le timing facial comptent plus que des effets physiques spectaculaires.

Cela ne signifie pas qu'il ne peut pas performer ailleurs. Cela signifie que le cas actuel le plus fort est plus étroit. Le site officiel lui-même met en avant le dialogue synchronisé, le son ambiant, les bruitages, la synchronisation labiale multilingue et les clips 1080p prêts pour les réseaux sociaux. 36Kr a également encadré l'opportunité en termes verticaux, en pointant les portraits, les humains numériques et les présentateurs virtuels comme les types de cas d'utilisation où un modèle ouvert atteignant un seuil « livrable » changerait réellement la structure des coûts.

Le clip ci-dessous correspond assez bien à cette lecture plus étroite : format court, axé sur la performance, et construit autour de la regardabilité plutôt que du spectacle seul.

C'est une façon plus utile de penser à cela. Pas comme un gagnant universel magique. Comme un modèle qui pourrait avoir trouvé un créneau très pertinent commercialement.

Conclusion : La lecture actuelle la plus forte n'est pas « HappyHorse résout la vidéo ». C'est « HappyHorse pourrait être particulièrement significatif là où les visages, les voix et la livraison en format court comptent le plus. »

5. La revendication open-source : ce que nous pouvons vérifier, ce que nous ne pouvons pas

C'est la partie que la plupart des articles brouillent encore.

Ce qui peut être vérifié est simple. Le site officiel de Happy Horse indique que le projet est open source, inclut des droits d'utilisation commerciale, et publie le modèle de base, le modèle distillé, le module de super-résolution et le code d'inférence. Il fournit même des commandes d'exemple pour cloner un dépôt GitHub et charger un modèle pré-entraîné depuis Hugging Face. Ces affirmations sont clairement sur le site.

Ce qui ne peut pas être validé immédiatement est si ces affirmations de publication publique sont déjà accompagnées d'artefacts accessibles et vérifiables. Le dépôt GitHub lié au site renvoie actuellement 404 Not Found. Le compte Hugging Face lié montre 0 modèles et « Aucun public pour l'instant ». Cela ne prouve pas que la publication ne se produira pas. Cela signifie que « entièrement open-source et publiquement vérifiable aujourd'hui » est une phrase trop forte pour l'instant.

Cet écart compte plus que les gens ne le pensent. Dans la vidéo IA, « ouvert » peut signifier au moins trois choses différentes :

- une revendication publique sur une page marketing

- un artefact téléchargeable avec des conditions

- une publication reproductible que des tiers peuvent réellement exécuter

HappyHorse pourrait encore atteindre le troisième niveau. Aujourd'hui, les preuves publiques sont beaucoup plus proches du premier que du troisième. C'est pourquoi le ton éditorial approprié n'est pas l'incrédulité. C'est la retenue.

Conclusion : L'histoire open-source de HappyHorse est une revendication sérieuse, mais la vérifiabilité publique n'a pas encore rattrapé le langage utilisé autour d'elle.

6. HappyHorse vs. Seedance 2.0 : Où l'avantage est réel — et où il ne l'est pas

La chose la plus simple à dire est celle-ci : si votre standard est préférence utilisateur aveugle dans les catégories sans audio, HappyHorse a déjà fait l'entrée la plus forte possible. Cette partie est suffisamment réelle pour compter. 36Kr a explicitement encadré le moment comme HappyHorse dépassant Seedance 2.0 sur Artificial Analysis et transformant les classements en un signal réel plutôt qu'une autre narration de lancement spéculative.

La partie qui devrait être écrite plus prudemment est tout ce qui suit. « Battre Seedance » peut signifier plusieurs choses très différentes. Cela peut signifier que les utilisateurs ont préféré un ensemble de clips dans une arène aveugle. Cela peut signifier que le modèle est plus facile à accéder. Cela peut signifier que le modèle est plus reproductible. Cela peut signifier que le modèle est un meilleur choix commercial aujourd'hui. Ces choses ne sont pas interchangeables. Et pour l'instant, HappyHorse n'a un avantage clair que dans le premier sens.

C'est toujours un gros problème. Mais ce n'est pas la même chose que de dire que le marché a basculé. Même le cadrage plus optimiste de 36Kr s'arrête avant cela et dit que HappyHorse ne secouera pas Seedance ou Kling à court terme. Cela semble être le bon niveau de prudence. Cela ressemble plus à un coup de semonce qu'à un changement de régime total.

Conclusion : HappyHorse a gagné le droit d'être comparé sérieusement à Seedance, mais il n'a pas gagné le droit d'être écrit comme le gagnant établi de toutes les catégories importantes.

7. Ce que cela change pour les créateurs, les petites équipes et le marché

L'histoire réelle ici est le pouvoir de tarification.

Pendant longtemps, les produits vidéo à source fermée pouvaient s'appuyer sur un argument simple : les modèles ouverts étaient intéressants, mais pas assez bons pour expédier du travail orienté client. 36Kr dit que cet écart est exactement là où les acteurs fermés ont construit une grande partie de leur pouvoir de tarification, et c'est pourquoi ce moment est important. Si un modèle ouvert ou quasi-ouvert peut se rapprocher suffisamment de la qualité « livrable » dans des tests aveugles évalués par des humains, le marché commence à poser une autre question : pour quoi exactement payons-nous la prime maintenant ?

Cela ne réécrit pas instantanément la pile. Les équipes se soucient toujours de la disponibilité, du support, du temps de fonctionnement, de la modération, de la documentation et de la sortie prévisible. Les produits fermés gagnent toujours sur beaucoup de ces points. Mais c'est là que l'histoire devient intéressante. 36Kr a encadré l'apparition de HappyHorse comme un signal réel de pouvoir de tarification ouvert contre fermé, en particulier dans les scénarios de portrait, d'humain numérique et de présentateur virtuel où l'économie d'hébergement autonome pourrait changer rapidement une fois que la qualité franchit le seuil de « utilisable » à « livrable ».

C'est la raison plus profonde de ne pas rejeter cela comme une curiosité. Même si HappyHorse lui-même reste partiellement non résolu pendant un certain temps, le signal du marché est déjà là.

Conclusion : HappyHorse est important car il met en pression l'histoire selon laquelle les modèles fermés sont la seule voie crédible vers une qualité vidéo expédiable.

8. Comment évaluer HappyHorse dans la vie réelle au lieu de simplement regarder le battage

Si vous voulez vraiment juger ce que ce moment signifie, ne commencez pas par des arguments abstraits sur qui l'a construit. Commencez par des tâches.

Utilisez un portrait. Utilisez un script de présentateur. Utilisez une image de produit. Utilisez une description de scène courte. Ensuite, comparez les sorties sur les choses qui comptent lorsqu'un clip doit quitter le dossier de test :

- Cohérence du plan — le clip semble-t-il être un seul rythme ou une séquence de suppositions déconnectées ?

- Stabilité du visage — l'identité et l'expression tiennent-elles du début à la fin ?

- Correspondance audio-image — si un discours est impliqué, le clip semble-t-il résolu ou assemblé ?

- Fiabilité des réexécutions — si vous avez besoin de trois versions utilisables, obtenez-vous trois, ou une exception chanceuse ?

C'est pourquoi je ne voudrais pas attendre que chaque rumeur autour de HappyHorse soit résolue avant de construire votre propre référence. Si HappyHorse devient finalement entièrement public et reproductible, cette référence deviendra encore plus précieuse. Si ce n'est pas le cas, vous avez quand même appris quelque chose d'utile : quel type de qualité de clip votre flux de travail nécessite réellement.

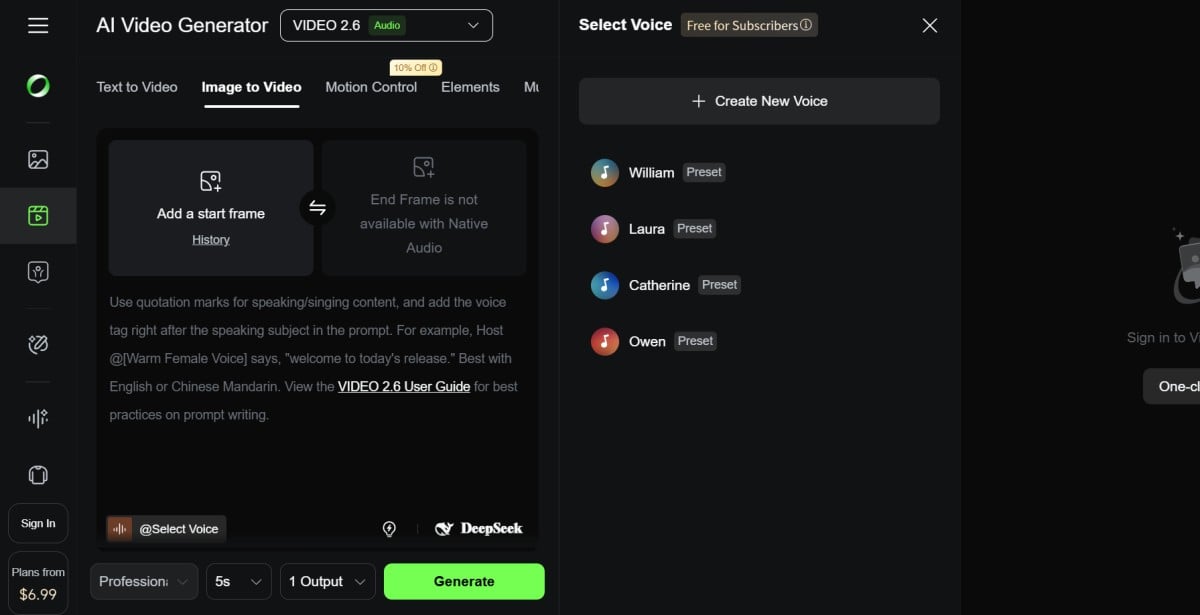

Téléchargez une image de référence et effectuez votre propre test côte à côte

Conclusion : La bonne réponse au cycle de battage autour de HappyHorse n'est pas la croyance ou l'incrédulité. C'est une comparaison contrôlée.

9. FAQ

Qu'est-ce que HappyHorse-1.0 ?

HappyHorse-1.0 est un modèle vidéo IA pseudonyme qu'Artificial Analysis indique être classé n°1 dans les catégories texte-à-vidéo et image-à-vidéo sans audio, et n°2 dans les catégories avec audio activé. Le site officiel le décrit comme un Transformer unifié de 15 milliards de paramètres qui génère conjointement des vidéos et des audios synchronisés à partir de textes ou d'images.

HappyHorse-1.0 est-il open source ?

Il est présenté ainsi sur le site officiel, qui indique que le modèle, le checkpoint distillé, le module de super-résolution et le code d'inférence sont publiés ouvertement avec des droits d'utilisation commerciale. Mais le dépôt GitHub lié renvoie actuellement un 404, et le compte Hugging Face lié n'a pas encore de modèle public. Donc, la formulation la plus sûre aujourd'hui est : revendiqué open source, pas encore entièrement vérifiable publiquement.

HappyHorse est-il meilleur que Seedance 2.0 ?

Cela dépend de ce que signifie « meilleur ». Le cas public le plus fort aujourd'hui est que HappyHorse attire déjà l'attention dans les arènes de préférence utilisateur aveugle. Ce n'est pas la même chose que de prouver qu'il est plus facile à accéder, plus facile à reproduire, ou le meilleur choix de production pour chaque équipe en ce moment.

Pouvez-vous utiliser HappyHorse-1.0 aujourd'hui ?

Vous pouvez étudier les revendications publiques aujourd'hui. Vous pouvez parler du signal de classement aujourd'hui. Ce qui reste incertain, c'est si un tiers peut accéder et reproduire indépendamment la publication complète comme décrit sur le site officiel sans rencontrer de liens manquants ou d'artefacts manquants.

Qui devrait prêter le plus d'attention à HappyHorse en ce moment ?

Les équipes travaillant sur des portraits, des humains numériques, des présentateurs virtuels, des vidéos de présentateurs et des clips courts basés sur des images devraient le surveiller de près. C'est là que la combinaison actuelle de signal de classement et de revendications de fonctionnalités officielles semble la plus pertinente commercialement.

10. Conclusion sur HappyHorse-1.0

HappyHorse-1.0 n'est pas intéressant parce qu'il est arrivé avec une histoire de produit bien ficelée. Il est intéressant parce qu'il est arrivé sans cela et a quand même forcé son chemin au centre de la conversation sur la vidéo IA. Artificial Analysis lui a déjà donné un signal de classement que les gens ne peuvent pas ignorer. Le site officiel lui a donné une identité ambitieuse. La publication publique n'a pas encore rattrapé. Cette tension est l'histoire.

Mon jugement est simple. Traitez HappyHorse comme un signal de marché sérieux, pas comme un ensemble de faits totalement établi. Si votre travail dépend de vidéos courtes centrées sur les personnes, c'est l'un des rares nouveaux modèles à suivre de près. Si vous avez besoin d'une publication entièrement transparente, entièrement documentée et entièrement reproductible aujourd'hui, les preuves publiques ne sont pas encore là.

Et cela suffit. Plus qu'assez, en fait. Parce qu'une fois qu'un modèle peut gagner la préférence des utilisateurs avant de gagner une clarté parfaite, chaque laboratoire vidéo fermé doit commencer à prendre la menace au sérieux.