HappyHorse-1.0: Perché Questo Nuovo Modello Video AI Sta Ricevendo Così Tante Attenzioni

- 1. Analisi Rapida Prima di Approfondire

- 2. Cos'è Esattamente HappyHorse-1.0?

- 3. Perché È Cresciuto Così Rapidamente?

- 4. Dove Sembra Più Forte Al Momento

- 5. La Pretesa Open-Source: Cosa Possiamo Verificare, Cosa No

- 6. HappyHorse vs. Seedance 2.0: Dove Il Vantaggio È Reale — e Dove Non Lo È

- 7. Cosa Cambia per i Creatori, i Piccoli Team e il Mercato

- 8. Come Valutare HappyHorse nella Vita Reale Invece di Guardare Solo l'Hype

- 9. FAQ

- 10. La Conclusione su HappyHorse-1.0

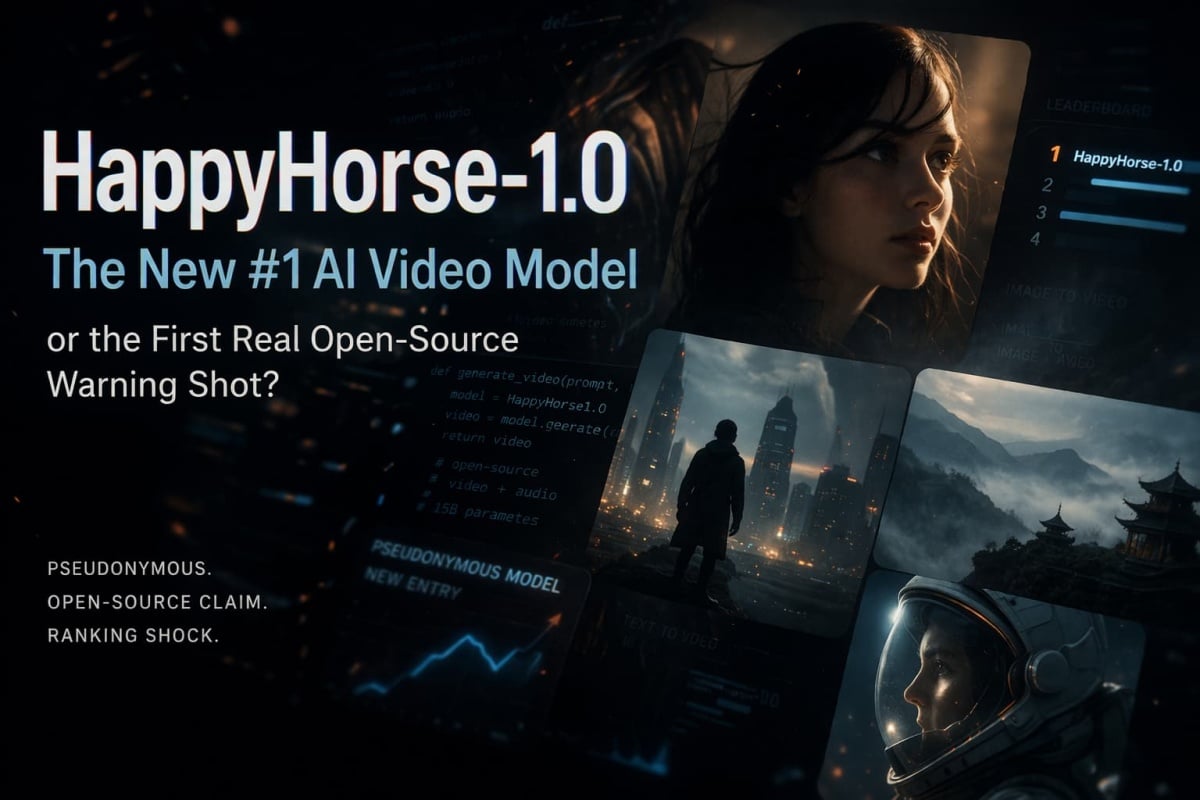

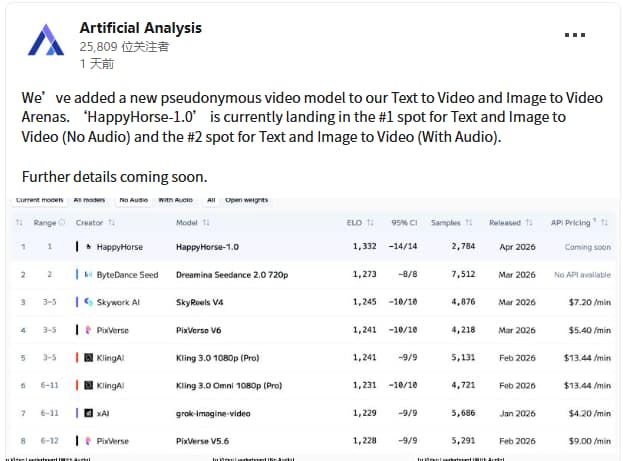

HappyHorse-1.0 è importante per una ragione sopra tutte: non è entrato nella conversazione sui video AI attraverso un evento di lancio, una demo di prodotto o un thread del fondatore. È entrato apparendo su Artificial Analysis come un nuovo modello video pseudonimo che era già in cima alle classifiche di testo-a-video e immagine-a-video senza audio, posizionandosi al secondo posto nelle categorie con audio. Questo non è normale. È il motivo per cui le persone stanno prestando attenzione.

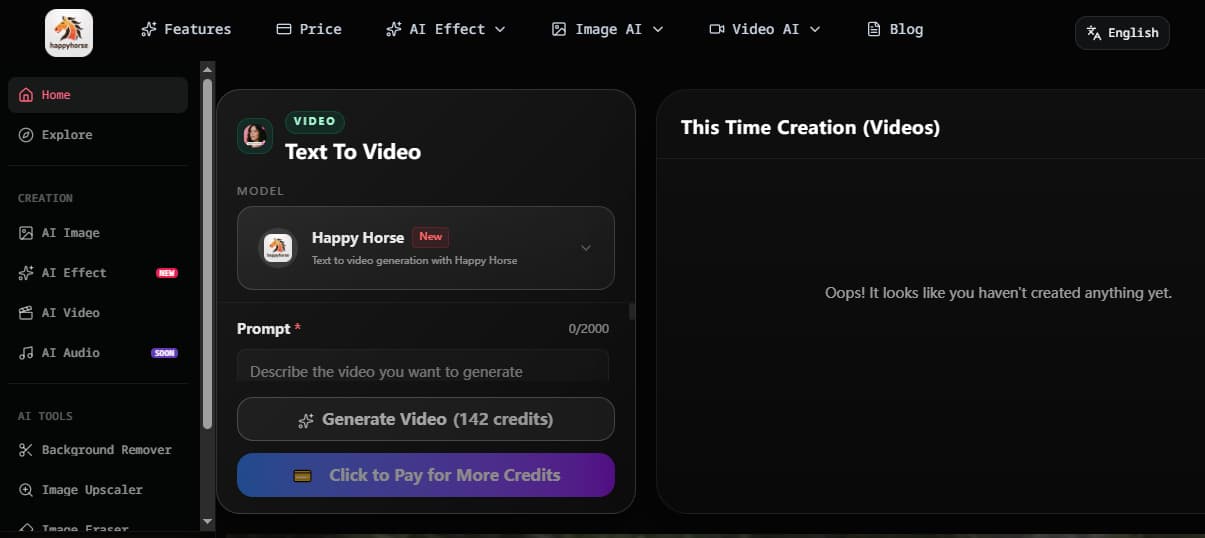

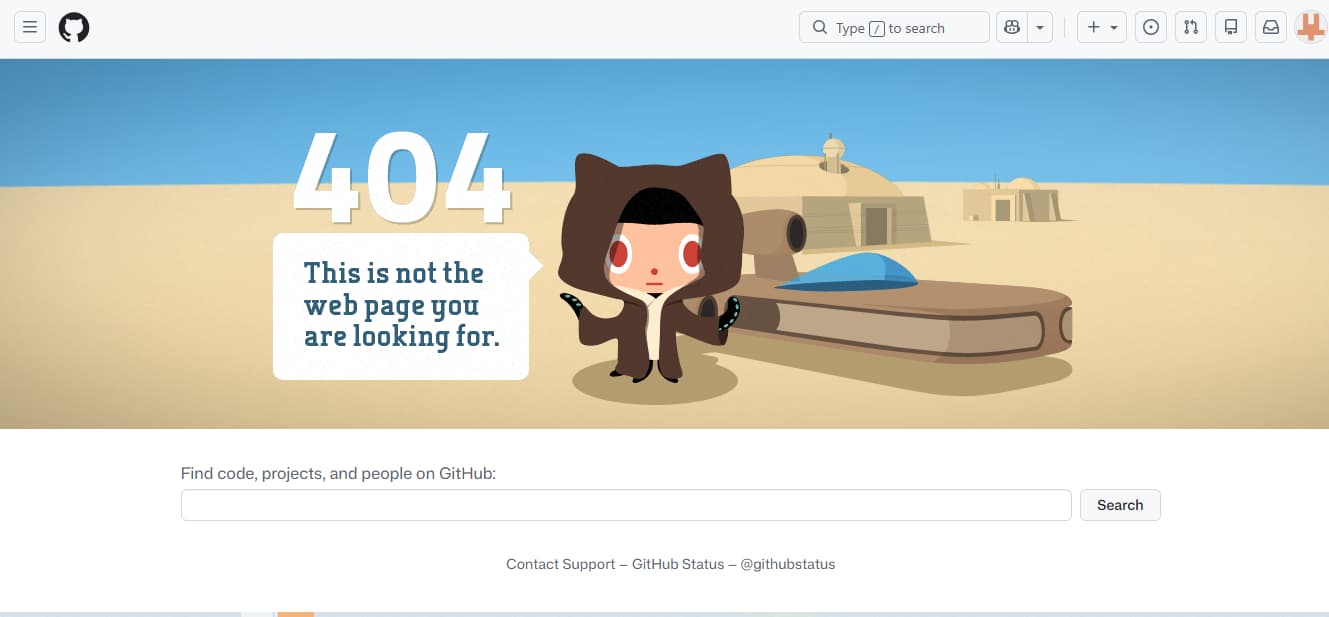

La parte più difficile è questa: la storia pubblica è ancora incompleta. Il sito ufficiale di Happy Horse descrive un Transformer unificato da 15 miliardi che genera congiuntamente video e audio sincronizzato, supporta sette lingue per il lip-sync e può produrre clip 1080p di 5–8 secondi. Lo stesso sito afferma anche che il modello, il checkpoint distillato, il modulo di super-risoluzione e il codice di inferenza sono rilasciati apertamente con diritti di uso commerciale. Ma il repository GitHub collegato da quel sito attualmente restituisce un errore 404, e l'account Hugging Face collegato mostra 0 modelli pubblici. Quindi questa non è una recensione di implementazione pratica. È una domanda più chiara: cos'è HappyHorse-1.0, perché è cresciuto così rapidamente e cosa possiamo effettivamente verificare in questo momento?

1. Analisi Rapida Prima di Approfondire

| Segnale | Cosa sembra vero al momento | Perché è importante |

|---|---|---|

| Identità | HappyHorse-1.0 è stato presentato da Artificial Analysis come un modello pseudonimo | Il modello sta già influenzando le classifiche prima che la sua storia di proprietà sia definita |

| Stato delle classifiche | Sta raggiungendo il #1 in testo-a-video e immagine-a-video senza audio, e il #2 nelle categorie con audio | Questo è un segnale di preferenza forte, non solo una dichiarazione sulla scheda tecnica |

| Posizionamento ufficiale | Il sito ufficiale lo presenta come un Transformer unificato da 15 miliardi per la generazione congiunta di video + audio | La proposta è molto più grande di "un altro modello testo-a-video" |

| Verificabilità pubblica | Il sito afferma rilascio aperto e diritti di uso commerciale, ma il repository GitHub collegato restituisce 404 e Hugging Face non ha ancora modelli pubblici | Questo è il più grande gap di fiducia nella storia |

| Migliore interpretazione attuale | Segnale forte, prova incompleta | Merita attenzione seria, ma non certezza cieca |

Una fonte sta portando la maggior parte del peso del "questo è reale" al momento: Artificial Analysis ha descritto HappyHorse-1.0 come un nuovo modello pseudonimo e ha detto che stava prendendo il primo posto in testo-a-video e immagine-a-video senza audio, posizionandosi al secondo posto nelle categorie con audio. Il sito ufficiale sta portando la maggior parte del peso del "questo è ciò che il modello afferma di essere". Questi non sono la stessa cosa. Tenerli separati rende la storia molto più facile da leggere.

Conclusione: HappyHorse-1.0 ha già il tipo di segnale di classifica che attira attenzione, ma non ha ancora il tipo di percorso di rilascio pubblico che guadagna fiducia automatica.

2. Cos'è Esattamente HappyHorse-1.0?

La risposta breve è che HappyHorse-1.0 viene presentato come un sistema video multimodale unificato, non solo un generatore di video silenziosi con audio aggiunto successivamente. Il sito ufficiale afferma che è un Transformer da 15 miliardi di parametri che produce congiuntamente video e audio sincronizzato da prompt di testo o immagine, supporta sette lingue per il lip-sync, utilizza un'architettura di autoattenzione a 40 livelli e punta a clip 1080p di 5–8 secondi. Questa è la definizione del prodotto presentata al pubblico.

Puoi anche avere un'idea più chiara di come Happy Horse 1.0 viene posizionato dagli attuali clip di esempio come quello qui sotto, che si concentra sul tipo di output breve, raffinato e orientato alle prestazioni che sta ora plasmando la conversazione intorno al modello.

Questa descrizione è importante perché cambia ciò che le persone pensano di guardare. Se la proposta fosse semplicemente "un modello di diffusione video migliore", questa sarebbe una storia di classifiche. Invece, la proposta è più vicina a: un modello, un passaggio, un flusso di output dove dialogo, suono ambientale e sincronizzazione labiale sono risolti insieme. Questa è una pretesa molto più ambiziosa. Spiega anche perché la discussione si è spostata così rapidamente da "bel risultato in classifica" a "questo cambia l'equilibrio tra sistemi aperti e chiusi?"

Non scriverei questo come una "recensione testata" convenzionale ancora. Le informazioni pubbliche sono sufficienti per spiegare cosa HappyHorse afferma di essere. Non sono sufficienti per trattare ogni affermazione di implementazione come definitiva. Questa distinzione è la differenza tra un articolo utile e un post di hype.

Conclusione: HappyHorse-1.0 dovrebbe essere compreso prima come un sistema di generazione audio-video unificato dichiarato, e solo in secondo luogo come una nuova voce in classifica.

3. Perché È Cresciuto Così Rapidamente?

La risposta non è "perché le persone amano i parametri." Artificial Analysis è utile qui proprio perché la sua classifica si basa sulla preferenza cieca degli utenti, non su una scheda tecnica in stile laboratorio. La copertura di 36Kr ha fatto lo stesso punto: la classifica è costruita da test ciechi di utenti reali, il che rende la reazione più difficile da liquidare come un trucco di marketing o una scappatoia di benchmark.

La mia interpretazione è che HappyHorse stia beneficiando di qualcosa di più umano che di una novità tecnica. Quando le persone votano su clip brevi, non stanno valutando schede tecniche. Stanno reagendo a se un risultato sembra guardabile, coerente e finito. Se un modello fa sembrare clip di 5–8 secondi meno come movimento cucito e più come un singolo battito diretto, tende a attirare attenzione rapidamente. Il posizionamento ufficiale intorno alla generazione audio-video congiunta punta esattamente in quella direzione, anche se la prova pubblica più ampia sta ancora recuperando terreno.

Questo è anche il motivo per cui la storia si è diffusa così rapidamente. I modelli anonimi di solito non ottengono il beneficio del dubbio. Ottengono sospetti. Anche HappyHorse ha ottenuto sospetti. Ma ha ottenuto attenzione comunque, perché il risultato della classifica è arrivato per primo. Le persone hanno dovuto spiegare un segnale che era già davanti a loro.

Conclusione: HappyHorse è cresciuto rapidamente perché il segnale di classifica è arrivato prima della storia di fondo, e le vittorie di preferenza cieca sono difficili da ignorare.

4. Dove Sembra Più Forte Al Momento

Il modo più debole per scrivere su HappyHorse è chiamarlo "il miglior modello video, punto." Questo non dice nulla al lettore. La domanda migliore è dove sembra più probabile stabilire un vantaggio per primo. Basandosi sul posizionamento ufficiale e sul modo in cui la storia viene discussa, la risposta più plausibile non è "tutto." È video breve centrato sulle persone: riprese di ritratti, formati di testa parlante, clip guidati da immagini, contenuti digitali umani e scene brevi dove il discorso sincronizzato e il tempismo facciale contano più della fisica spettacolare.

Questo non significa che non possa funzionare altrove. Significa che il caso più forte attuale è più ristretto. Lo stesso sito ufficiale si concentra su dialoghi sincronizzati, suono ambientale, Foley, sincronizzazione labiale multilingue e clip 1080p pronti per i social. Anche 36Kr ha inquadrato l'opportunità in termini verticali, indicando ritratti, umani digitali e ancore virtuali come i tipi di casi d'uso dove un modello aperto che raggiunge una soglia "consegnabile" cambierebbe effettivamente la struttura dei costi.

Il clip qui sotto si adatta abbastanza bene a questa lettura più ristretta: breve, orientato alle prestazioni e costruito intorno alla guardabilità piuttosto che solo allo spettacolo.

Questo è un modo più utile di pensarci. Non come un vincitore universale magico. Come un modello che potrebbe aver trovato un punto di ingresso molto rilevante dal punto di vista commerciale.

Conclusione: La lettura più forte attuale non è "HappyHorse risolve il video." È "HappyHorse potrebbe essere particolarmente significativo dove facce, voci e consegna breve contano di più."

5. La Pretesa Open-Source: Cosa Possiamo Verificare, Cosa No

Questa è la parte che la maggior parte degli articoli ancora confonde.

Ciò che può essere verificato è semplice. Il sito ufficiale di Happy Horse afferma che il progetto è open source, include diritti di uso commerciale e rilascia il modello base, il modello distillato, il modulo di super-risoluzione e il codice di inferenza. Fornisce persino comandi di esempio per clonare un repository GitHub e caricare un modello preaddestrato da Hugging Face. Queste affermazioni sono chiaramente sul sito.

Ciò che non può essere accettato senza riserve è se queste affermazioni di rilascio pubblico siano già corrispondenti ad artefatti accessibili e verificabili. Il repository GitHub collegato dal sito attualmente restituisce 404 Not Found. L'account Hugging Face collegato mostra modelli 0 e "Nessuno pubblico ancora." Questo non prova che il rilascio non avverrà. Significa che "completamente open-source e verificabile pubblicamente oggi" è una frase troppo forte al momento.

Quel gap conta più di quanto si pensi. Nei video AI, "aperto" può significare almeno tre cose diverse:

- una dichiarazione pubblica su una pagina di marketing

- un artefatto scaricabile con termini

- un rilascio riproducibile che terze parti possono effettivamente eseguire

HappyHorse potrebbe ancora arrivare al terzo livello. Oggi, le prove pubbliche sono molto più vicine al primo che al terzo. È per questo che il tono editoriale giusto non è incredulità. È moderazione.

Conclusione: La storia open-source di HappyHorse è una pretesa seria, ma la verificabilità pubblica non ha ancora raggiunto il linguaggio utilizzato intorno ad essa.

6. HappyHorse vs. Seedance 2.0: Dove Il Vantaggio È Reale — e Dove Non Lo È

La cosa più semplice da dire è questa: se il tuo standard è preferenza cieca degli utenti nelle categorie senza audio, HappyHorse ha già fatto l'ingresso più forte possibile. Quella parte è abbastanza reale da contare. 36Kr ha esplicitamente inquadrato il momento come HappyHorse che supera Seedance 2.0 su Artificial Analysis e trasforma le classifiche in un segnale genuino piuttosto che un'altra narrativa di lancio speculativa.

La parte che dovrebbe essere scritta più attentamente è tutto il resto. "Battere Seedance" può significare alcune cose molto diverse. Può significare che gli utenti hanno preferito un set di clip in un'arena cieca. Può significare che il modello è più facile da accedere. Può significare che il modello è più riproducibile. Può significare che il modello è una scelta commerciale migliore oggi. Questi non sono intercambiabili. E al momento, HappyHorse ha solo un vantaggio chiaro nel primo senso.

Questo è comunque un grosso problema. Ma non è lo stesso che dire che il mercato è cambiato. Anche il più ottimista framing di 36Kr si ferma prima di questo e dice che HappyHorse non scuoterà Seedance o Kling nel breve termine. Questo sembra il livello giusto di cautela. Questo sembra più un colpo di avvertimento che un cambio di regime totale.

Conclusione: HappyHorse ha guadagnato il diritto di essere confrontato seriamente con Seedance, ma non ha guadagnato il diritto di essere scritto come il vincitore definitivo di ogni categoria che conta.

7. Cosa Cambia per i Creatori, i Piccoli Team e il Mercato

La vera storia qui è il potere di prezzo.

Per molto tempo, i prodotti video closed-source potevano contare su un argomento semplice: i modelli aperti erano interessanti, ma non abbastanza buoni da spedire lavori rivolti ai clienti. 36Kr dice che quel gap è esattamente dove i giocatori chiusi hanno costruito gran parte del loro potere di prezzo, ed è per questo che questo momento conta. Se un modello aperto o quasi aperto può avvicinarsi abbastanza alla qualità "consegnabile" nei test ciechi valutati dagli utenti, il mercato inizia a fare una domanda diversa: per cosa stiamo pagando il premio ora?

Questo non riscrive istantaneamente lo stack. I team si preoccupano ancora di disponibilità, supporto, uptime, moderazione, documentazione e output prevedibile. I prodotti chiusi vincono ancora su molti di questi. Ma è qui che la storia diventa interessante. 36Kr ha inquadrato l'apparizione di HappyHorse come un vero segnale di potere di prezzo open-vs.-closed, specialmente nei ritratti, umani digitali e scenari di ancoraggio virtuale dove l'economia di self-hosting potrebbe cambiare rapidamente una volta che la qualità supera la soglia da "utilizzabile" a "consegnabile."

Questo è il motivo più profondo per non liquidare questo come una curiosità. Anche se HappyHorse stesso rimane parzialmente irrisolto per un po', il segnale di mercato è già fuori.

Conclusione: HappyHorse è importante perché mette pressione sulla storia che i modelli chiusi sono l'unico percorso credibile verso la qualità video spedibile.

8. Come Valutare HappyHorse nella Vita Reale Invece di Guardare Solo l'Hype

Se vuoi davvero giudicare cosa significa questo momento, non iniziare con argomenti astratti su chi l'ha costruito. Inizia con i compiti.

Usa un ritratto. Usa uno script di testa parlante. Usa un'immagine di prodotto. Usa una breve descrizione di scena. Poi confronta gli output sulle cose che contano quando un clip deve lasciare la cartella di test:

- Coerenza dello scatto — il clip sembra un battito unico o una sequenza di ipotesi disconnesse?

- Stabilità del viso — identità ed espressione reggono dall'inizio alla fine?

- Adattamento audio-immagine — se è coinvolto il discorso, il clip sembra risolto o cucito?

- Affidabilità del riavvio — se hai bisogno di tre versioni utilizzabili, ne ottieni tre o un fortunato caso isolato?

Ecco perché non aspetterei che ogni voce su HappyHorse venga risolta prima di costruire la tua baseline. Se HappyHorse alla fine diventa completamente pubblico e riproducibile, quella baseline diventerà ancora più preziosa. Se non lo fa, hai comunque imparato qualcosa di utile: che tipo di qualità del clip il tuo flusso di lavoro ha effettivamente bisogno.

Carica un'immagine di riferimento e esegui il tuo test fianco a fianco

Conclusione: La risposta giusta al ciclo di hype di HappyHorse non è credere o non credere. È confronto controllato.

9. FAQ

Cos'è HappyHorse-1.0?

HappyHorse-1.0 è un modello video AI pseudonimo che Artificial Analysis afferma stia raggiungendo il #1 in testo-a-video e immagine-a-video senza audio, e il #2 nelle categorie con audio. Il sito ufficiale lo descrive come un Transformer unificato da 15 miliardi che genera congiuntamente video e audio sincronizzato da prompt di testo o immagine.

HappyHorse-1.0 è open source?

Viene presentato in questo modo sul sito ufficiale, che afferma che il modello, il checkpoint distillato, il modulo di super-risoluzione e il codice di inferenza sono rilasciati apertamente con diritti di uso commerciale. Ma il repository GitHub collegato attualmente restituisce 404, e l'account Hugging Face collegato non ha modelli pubblici ancora. Quindi la formulazione più sicura oggi è: open source dichiarato, non ancora completamente verificabile pubblicamente.

HappyHorse è migliore di Seedance 2.0?

Dipende da cosa significa "migliore." Il caso pubblico più forte oggi è che HappyHorse sta già attirando attenzione nelle arene di preferenza cieca degli utenti. Questo non è lo stesso che dimostrare che è più facile da accedere, più facile da riprodurre o la scelta di produzione migliore per ogni team al momento.

Puoi usare HappyHorse-1.0 oggi?

Puoi studiare le dichiarazioni pubbliche oggi. Puoi parlare del segnale di classifica oggi. Ciò che è ancora poco chiaro è se una terza parte può accedere e riprodurre indipendentemente il rilascio completo come descritto sul sito ufficiale senza incontrare link mancanti o artefatti mancanti.

Chi dovrebbe prestare maggiore attenzione a HappyHorse al momento?

I team che lavorano su ritratti, umani digitali, presentatori virtuali, video di testa parlante e clip brevi guidati da immagini dovrebbero seguirlo da vicino. È lì che la combinazione attuale di segnale di classifica e dichiarazioni di funzionalità ufficiali sembra più rilevante dal punto di vista commerciale.

10. La Conclusione su HappyHorse-1.0

HappyHorse-1.0 non è interessante perché è arrivato con una storia di prodotto raffinata. È interessante perché è arrivato senza una e si è comunque fatto strada al centro della conversazione sui video AI. Artificial Analysis gli ha già dato un segnale di classifica che le persone non possono ignorare. Il sito ufficiale gli ha dato un'identità ambiziosa. Il percorso di rilascio pubblico non ha ancora raggiunto questo livello. Questa tensione è la storia.

Il mio giudizio è semplice. Tratta HappyHorse come un serio segnale di mercato, non come un modello completamente definito. Se il tuo lavoro dipende da video brevi centrati sulle persone, questo è uno dei pochi nuovi modelli che vale la pena seguire da vicino. Se hai bisogno di un rilascio completamente trasparente, completamente documentato e completamente riproducibile oggi, le prove pubbliche non sono ancora lì.

E questo è abbastanza. Più che abbastanza, in realtà. Perché una volta che un modello può vincere la preferenza degli utenti prima di ottenere chiarezza perfetta, ogni laboratorio video chiuso deve iniziare a prendere seriamente la minaccia.