HappyHorse-1.0: Por qué este nuevo modelo de video de IA está recibiendo tanta atención

- 1. Resumen Rápido Antes de Profundizar

- 2. ¿Qué es exactamente HappyHorse-1.0?

- 3. ¿Por qué ascendió tan rápido?

- 4. Donde parece más fuerte ahora mismo

- 5. La afirmación de código abierto: lo que podemos verificar, lo que no podemos

- 6. HappyHorse vs. Seedance 2.0: Dónde la ventaja es real y dónde no lo es

- 7. Lo que esto cambia para creadores, pequeños equipos y el mercado

- 8. Cómo evaluar HappyHorse en la vida real en lugar de solo observar el bombo

- 9. Preguntas Frecuentes

- 10. La Conclusión sobre HappyHorse-1.0

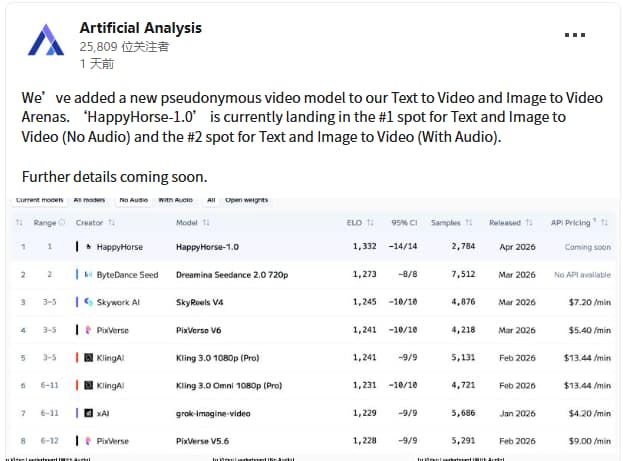

HappyHorse-1.0 importa por una razón principal: no ingresó a la conversación sobre videos de IA a través de un evento de lanzamiento, una demostración de producto o un hilo del fundador. Ingresó apareciendo en Artificial Analysis como un nuevo modelo de video seudónimo que ya lideraba las clasificaciones de texto a video sin audio e imagen a video, mientras ocupaba el segundo lugar en las categorías con audio habilitado. Eso no es normal. Es por eso que la gente está prestando atención.

La parte más difícil es esta: la historia pública aún está incompleta. El sitio oficial de Happy Horse describe un Transformer unificado de 15B que genera conjuntamente video y audio sincronizado, admite siete idiomas de sincronización labial y puede producir clips de 5 a 8 segundos en 1080p. El mismo sitio también dice que el modelo, el punto de control destilado, el módulo de superresolución y el código de inferencia se publican abiertamente con derechos de uso comercial. Pero el repositorio de GitHub vinculado desde ese sitio actualmente devuelve un 404, y la cuenta vinculada de Hugging Face muestra 0 modelos públicos. Así que esto no es una revisión de implementación práctica. Es una pregunta más clara: ¿qué es HappyHorse-1.0, por qué ascendió tan rápido y qué podemos verificar realmente ahora?

1. Resumen Rápido Antes de Profundizar

| Señal | Lo que parece ser cierto ahora | Por qué importa |

|---|---|---|

| Identidad | HappyHorse-1.0 ha sido presentado por Artificial Analysis como un modelo seudónimo | El modelo ya está influyendo en las clasificaciones antes de que se resuelva su historia de propiedad |

| Estado en el ranking | Está ocupando el puesto #1 en texto a video sin audio e imagen a video, y el #2 en las categorías con audio habilitado | Esto es una señal de preferencia fuerte, no solo una afirmación de hoja de especificaciones |

| Posicionamiento oficial | El sitio oficial lo enmarca como un Transformer unificado de 15B para generación conjunta de video + audio | La propuesta es mucho más grande que "otro modelo de texto a video" |

| Verificabilidad pública | El sitio afirma una publicación abierta y derechos de uso comercial, pero el repositorio de GitHub vinculado devuelve un 404 y Hugging Face no tiene modelos públicos aún | Esta es la mayor brecha de confianza en la historia |

| Mejor lectura actual | Señal fuerte, prueba incompleta | Vale la pena prestarle seria atención, pero no con certeza ciega |

Una fuente está llevando la mayor parte del peso de "esto es real" en este momento: Artificial Analysis describió HappyHorse-1.0 como un nuevo modelo seudónimo y dijo que estaba ocupando el primer lugar en texto a video sin audio e imagen a video, mientras ocupaba el segundo lugar en las categorías con audio habilitado. El sitio oficial está llevando la mayor parte del peso de "esto es lo que el modelo afirma ser". Esas no son la misma cosa. Manténgalas separadas y la historia será mucho más fácil de leer.

Conclusión: HappyHorse-1.0 ya tiene el tipo de señal de clasificación que obliga a prestarle atención, pero aún no tiene el tipo de rastro de publicación pública que genera confianza automática.

2. ¿Qué es exactamente HappyHorse-1.0?

La respuesta corta es que HappyHorse-1.0 está siendo presentado como un sistema de video multimodal unificado, no solo como un generador de video silencioso con audio añadido después. El sitio oficial dice que es un Transformer de 15 mil millones de parámetros que produce conjuntamente video y audio sincronizado a partir de indicaciones de texto o imagen, admite siete idiomas de sincronización labial, utiliza una arquitectura de autoatención de 40 capas y apunta a clips de 5 a 8 segundos en 1080p. Esa es la definición del producto que se está presentando al público.

También puedes obtener una idea más clara de cómo se está posicionando Happy Horse 1.0 a partir de clips de ejemplo actuales como el siguiente, que se inclina hacia el tipo de salida corta, pulida y orientada al rendimiento que ahora está dando forma a la conversación en torno al modelo.

Esa descripción importa porque cambia lo que la gente piensa que está viendo. Si la propuesta fuera simplemente "un mejor modelo de difusión de video", esto sería una historia de clasificaciones. En cambio, la propuesta se acerca más a: un modelo, un paso, una corriente de salida donde el diálogo, el sonido ambiental y la sincronización labial se resuelven juntos. Esa es una afirmación mucho más ambiciosa. También explica por qué la discusión pasó tan rápidamente de "buen resultado en el ranking" a "¿esto cambia el equilibrio entre sistemas abiertos y cerrados?"

No escribiría esto como una "revisión probada" convencional todavía. La información pública es suficiente para explicar lo que HappyHorse dice que es. No es suficiente para tratar cada afirmación de implementación como un hecho establecido. Esa distinción es la diferencia entre un artículo útil y una publicación exagerada.

Conclusión: HappyHorse-1.0 debe entenderse primero como un sistema de generación de audio y video unificado reclamado, y solo en segundo lugar como una nueva entrada en el ranking.

3. ¿Por qué ascendió tan rápido?

La respuesta no es "porque a la gente le encantan los parámetros". Artificial Analysis es útil aquí precisamente porque su clasificación se basa en la preferencia ciega del usuario, no en una tarjeta de puntuación de arquitectura estilo laboratorio. La cobertura de 36Kr hizo el mismo punto: la clasificación se construye a partir de pruebas ciegas de usuarios reales, lo que hace que la reacción sea más difícil de descartar como un truco de marketing o una laguna en el benchmark.

Mi lectura es que HappyHorse se está beneficiando de algo más humano que una novedad técnica. Cuando las personas votan sobre clips cortos, no están evaluando tarjetas de modelo. Están reaccionando a si un resultado se siente visualizable, coherente y terminado. Si un modelo hace que los clips de 5 a 8 segundos se sientan menos como movimiento cosido y más como un solo ritmo dirigido, eso tiende a ganar atención rápidamente. El posicionamiento oficial en torno a la generación conjunta de audio y video apunta exactamente en esa dirección, incluso si la prueba pública más amplia aún está poniéndose al día.

Esto también explica por qué la historia se difundió tan rápidamente. Los modelos anónimos generalmente no obtienen el beneficio de la duda. Obtienen sospechas. HappyHorse también obtuvo sospechas. Pero obtuvo atención de todos modos, porque el resultado del ranking llegó primero. Las personas tuvieron que explicar una señal que ya estaba frente a ellos.

Conclusión: HappyHorse ascendió rápidamente porque la señal de clasificación llegó antes que la historia de fondo, y las victorias de preferencia ciega son difíciles de descartar.

4. Donde parece más fuerte ahora mismo

La forma más débil de escribir sobre HappyHorse es llamarlo "el mejor modelo de video, punto". Eso no le dice nada al lector. La mejor pregunta es dónde parece más probable que establezca una ventaja primero. Basado en el posicionamiento oficial y la forma en que se está discutiendo la historia, la respuesta más plausible no es "todo". Es video corto centrado en personas: tomas de retrato, formatos de cabeza parlante, clips liderados por imágenes, contenido de humanos digitales y escenas cortas donde el habla sincronizada y el tiempo facial importan más que la física espectacular.

Eso no significa que no pueda desempeñarse en otros lugares. Significa que el caso más fuerte actual es más estrecho. El propio sitio oficial se inclina hacia el diálogo sincronizado, el sonido ambiental, Foley, la sincronización labial multilingüe y los clips sociales listos en 1080p. 36Kr también enmarcó la oportunidad en términos verticales, señalando retratos, humanos digitales y anclas virtuales como los tipos de casos de uso donde un modelo abierto que alcance un umbral "entregable" realmente cambiaría la estructura de costos.

El clip a continuación encaja bastante bien con esa lectura más estrecha: de formato corto, orientado al rendimiento y construido en torno a la visualización en lugar del espectáculo por sí solo.

Esa es una forma más útil de pensar en ello. No como un ganador universal mágico. Como un modelo que puede haber encontrado una cuña comercialmente muy relevante.

Conclusión: La lectura más fuerte actual no es "HappyHorse resuelve el video". Es "HappyHorse puede ser especialmente significativo donde las caras, las voces y la entrega de formato corto importan más".

5. La afirmación de código abierto: lo que podemos verificar, lo que no podemos

Esta es la parte que la mayoría de los artículos aún difuminan.

Lo que se puede verificar es simple. El sitio oficial de Happy Horse dice que el proyecto es de código abierto, incluye derechos de uso comercial y publica el modelo base, el modelo destilado, el módulo de superresolución y el código de inferencia. Incluso proporciona comandos de muestra para clonar un repositorio de GitHub y cargar un modelo preentrenado desde Hugging Face. Esas afirmaciones están claramente en el sitio.

Lo que no se puede aceptar sin más es si esas afirmaciones de publicación pública ya están respaldadas por artefactos accesibles y verificables. El repositorio de GitHub vinculado desde el sitio actualmente devuelve 404 No Encontrado. La cuenta vinculada de Hugging Face muestra 0 modelos y "Ninguno público aún". Eso no prueba que la publicación no sucederá. Significa que "totalmente de código abierto y verificable públicamente hoy" es una frase demasiado fuerte en este momento.

Esa brecha importa más de lo que la gente piensa. En video de IA, "abierto" puede significar al menos tres cosas diferentes:

- una afirmación pública en una página de marketing

- un artefacto descargable con términos

- una publicación reproducible que terceros realmente puedan ejecutar

HappyHorse aún puede llegar al tercer nivel. Hoy, la evidencia pública está mucho más cerca del primero que del tercero. Es por eso que el tono editorial correcto no es incredulidad. Es moderación.

Conclusión: La historia de código abierto de HappyHorse es una afirmación seria, pero la verificabilidad pública aún no ha alcanzado el lenguaje que se usa en torno a ella.

6. HappyHorse vs. Seedance 2.0: Dónde la ventaja es real y dónde no lo es

Lo más limpio que se puede decir es esto: si tu estándar es preferencia ciega del usuario en las categorías sin audio, HappyHorse ya ha hecho la entrada más fuerte posible. Esa parte es lo suficientemente real como para importar. 36Kr enmarcó explícitamente el momento como HappyHorse superando a Seedance 2.0 en Artificial Analysis y convirtiendo las clasificaciones en una señal genuina en lugar de otra narrativa especulativa de lanzamiento.

La parte que debería escribirse con más cuidado es todo lo que viene después. "Superar a Seedance" puede significar algunas cosas muy diferentes. Puede significar que los usuarios prefirieron un conjunto de clips en una arena ciega. Puede significar que el modelo es más fácil de acceder. Puede significar que el modelo es más reproducible. Puede significar que el modelo es una mejor opción comercial hoy. Esas no son intercambiables. Y ahora mismo, HappyHorse solo tiene una ventaja clara en el primer sentido.

Eso sigue siendo un gran problema. Pero no es lo mismo que decir que el mercado ha cambiado. Incluso el marco más optimista de 36Kr se detiene antes de eso y dice que HappyHorse no sacudirá a Seedance o Kling a corto plazo. Eso parece el nivel correcto de precaución. Esto parece más un disparo de advertencia que un cambio de régimen total.

Conclusión: HappyHorse ha ganado el derecho de ser comparado seriamente con Seedance, pero no ha ganado el derecho de ser escrito como el ganador establecido en todas las categorías que importan.

7. Lo que esto cambia para creadores, pequeños equipos y el mercado

La verdadera historia aquí es el poder de fijación de precios.

Durante mucho tiempo, los productos de video de código cerrado podían confiar en un argumento simple: los modelos abiertos eran interesantes, pero no lo suficientemente buenos para entregar trabajos orientados al cliente. 36Kr dice que esa brecha es exactamente donde los jugadores cerrados construyeron gran parte de su poder de fijación de precios, y por eso este momento importa. Si un modelo abierto o casi abierto puede acercarse lo suficiente a la calidad "entregable" en pruebas ciegas calificadas por humanos, el mercado comienza a hacer una pregunta diferente: ¿exactamente por qué estamos pagando la prima ahora?

Eso no reescribe instantáneamente la pila. Los equipos todavía se preocupan por la disponibilidad, el soporte, el tiempo de actividad, la moderación, la documentación y la salida predecible. Los productos cerrados todavía ganan en muchos de esos aspectos. Pero aquí es donde la historia se pone interesante. 36Kr enmarcó la aparición de HappyHorse como una señal real de poder de fijación de precios entre abierto y cerrado, especialmente en escenarios de retratos, humanos digitales y anclas virtuales donde la economía de autoalojamiento podría cambiar rápidamente una vez que la calidad cruce el umbral de "utilizable" a "entregable".

Esa es la razón más profunda para no descartar esto como una curiosidad. Incluso si HappyHorse en sí mismo permanece parcialmente sin resolver por un tiempo, la señal del mercado ya está fuera.

Conclusión: HappyHorse importa porque presiona la narrativa de que los modelos cerrados son la única ruta creíble hacia la calidad de video que se puede entregar.

8. Cómo evaluar HappyHorse en la vida real en lugar de solo observar el bombo

Si realmente quieres juzgar lo que significa este momento, no comiences con argumentos abstractos sobre quién lo construyó. Comienza con tareas.

Usa un retrato. Usa un guion de cabeza parlante. Usa una imagen de producto. Usa una descripción de escena corta. Luego compara las salidas en las cosas que importan cuando un clip necesita salir de la carpeta de pruebas:

- Coherencia del plano — ¿el clip se siente como un solo ritmo o como una secuencia de conjeturas desconectadas?

- Estabilidad facial — ¿la identidad y la expresión se mantienen de principio a fin?

- Ajuste audio-imagen — si hay discurso involucrado, ¿el clip parece resuelto o cosido?

- Fiabilidad de re-ejecución — si necesitas tres versiones utilizables, ¿obtienes tres o un caso atípico afortunado?

Por eso no esperaría a que se resuelva cada rumor en torno a HappyHorse antes de construir tu propia línea base. Si HappyHorse eventualmente se vuelve completamente público y reproducible, esa línea base será aún más valiosa. Si no lo hace, aún aprendiste algo útil: qué tipo de calidad de clip necesita realmente tu flujo de trabajo.

Sube una imagen de referencia y realiza tu propia prueba comparativa lado a lado

Conclusión: La respuesta correcta al ciclo de bombo de HappyHorse no es creer o no creer. Es una comparación controlada.

9. Preguntas Frecuentes

¿Qué es HappyHorse-1.0?

HappyHorse-1.0 es un modelo de video de IA seudónimo que Artificial Analysis dice que está ocupando el puesto #1 en texto a video sin audio e imagen a video, y el #2 en las categorías con audio habilitado. El sitio oficial lo describe como un Transformer unificado de 15B que genera conjuntamente video y audio sincronizado a partir de indicaciones de texto o imagen.

¿Es HappyHorse-1.0 de código abierto?

Se está presentando de esa manera en el sitio oficial, que dice que el modelo, el punto de control destilado, el módulo de superresolución y el código de inferencia se publican abiertamente con derechos de uso comercial. Pero el repositorio de GitHub vinculado actualmente devuelve 404, y la cuenta vinculada de Hugging Face no tiene modelos públicos aún. Por lo tanto, la redacción más segura hoy es: afirmado como de código abierto, pero aún no completamente verificable públicamente.

¿Es HappyHorse mejor que Seedance 2.0?

Depende de lo que signifique "mejor". El caso público más fuerte hoy es que HappyHorse ya está ganando atención en arenas de preferencia ciega del usuario. Eso no es lo mismo que probar que es más fácil de acceder, más fácil de reproducir o la mejor opción de producción para cada equipo en este momento.

¿Puedes usar HappyHorse-1.0 hoy?

Puedes estudiar las afirmaciones públicas hoy. Puedes hablar sobre la señal de clasificación hoy. Lo que aún no está claro es si un tercero puede acceder y reproducir de forma independiente la publicación completa como se describe en el sitio oficial sin encontrar enlaces o artefactos faltantes.

¿Quién debería prestar más atención a HappyHorse ahora mismo?

Los equipos que trabajan en retratos, humanos digitales, presentadores virtuales, video de cabeza parlante y clips cortos liderados por imágenes deberían observarlo de cerca. Ahí es donde la combinación actual de señal de clasificación y afirmaciones de características oficiales parece más comercialmente relevante.

10. La Conclusión sobre HappyHorse-1.0

HappyHorse-1.0 no es interesante porque llegó con una historia de producto pulida. Es interesante porque llegó sin una y aún así se abrió camino hacia el centro de la conversación sobre videos de IA. Artificial Analysis ya le ha dado una señal de clasificación que la gente no puede ignorar. El sitio oficial le ha dado una identidad ambiciosa. El rastro de publicación pública aún no ha alcanzado eso. Esa tensión es la historia.

Mi juicio es simple. Trata a HappyHorse como una señal de mercado seria, no como un patrón de hechos completamente resuelto. Si tu trabajo depende de videos cortos centrados en personas, este es uno de los pocos modelos nuevos que vale la pena seguir de cerca. Si necesitas una publicación completamente transparente, completamente documentada y completamente reproducible hoy, la evidencia pública aún no está ahí.

Y eso es suficiente. Más que suficiente, en realidad. Porque una vez que un modelo puede ganar la preferencia del usuario antes de ganar claridad perfecta, cada laboratorio de video cerrado tiene que empezar a tomar la amenaza en serio.