Wan 2.2 AI 视频生成器

Wan 2.2 主要升级

原生 1080p 高清分辨率

以原生 1080p 生成清晰锐利的视频,让作品在细节、画面干净度和整体质感上更适合正式发布、客户展示以及后期剪辑。对于希望在额外修饰前就获得更成熟画面效果的创作者来说,这是非常实用的选择。

- 为主流平台提供清晰的高清细节

- 画面足够干净,便于剪辑与导出

- 适合打造更专业的视觉成片

少样本 LoRA 个性化

仅需 10–20 张图片即可建立自定义视觉风格,并通过灵活、易用的 LoRA 控制进行微调或风格融合。这让个性化创作更高效,尤其适合想保留特定视觉风格、又不想投入过长或过于复杂训练流程的用户。

对于想要探索定制化视觉输出的创作者来说,Wan 2.2 spicy 让风格适配变得更实用、更容易上手。

体积特效与光效增强

通过 AI 生成火焰、粒子、辉光和灯光效果,为画面增加更多层次感、氛围感和视觉真实度。这些效果能让原本平面的镜头更丰富、更立体,同时减少手动合成或传统特效制作的工作量。

- 快速增强画面氛围与视觉冲击力

- 用体积效果提升场景纵深感

- 减少手动操作也能获得更沉浸的光影表现

Wan 2.2 Animate

使用参考视频引导动作,并将动作迁移到新角色上,实现更高效的动画制作流程。Wan 2.2 Animate 专为更易管理的动作迁移而设计,可在多帧之间保持更好的视觉一致性,并减少后期需要修正的明显错误。

- 使用参考素材驱动角色动作

- 更稳定地保持比例、光线与场景连续性

- 减少动作类动画测试中的后期清理时间

最终效果仍会受到参考素材和提示词质量影响,但这一工作流能让动画测试更快展开,也更容易后续优化。

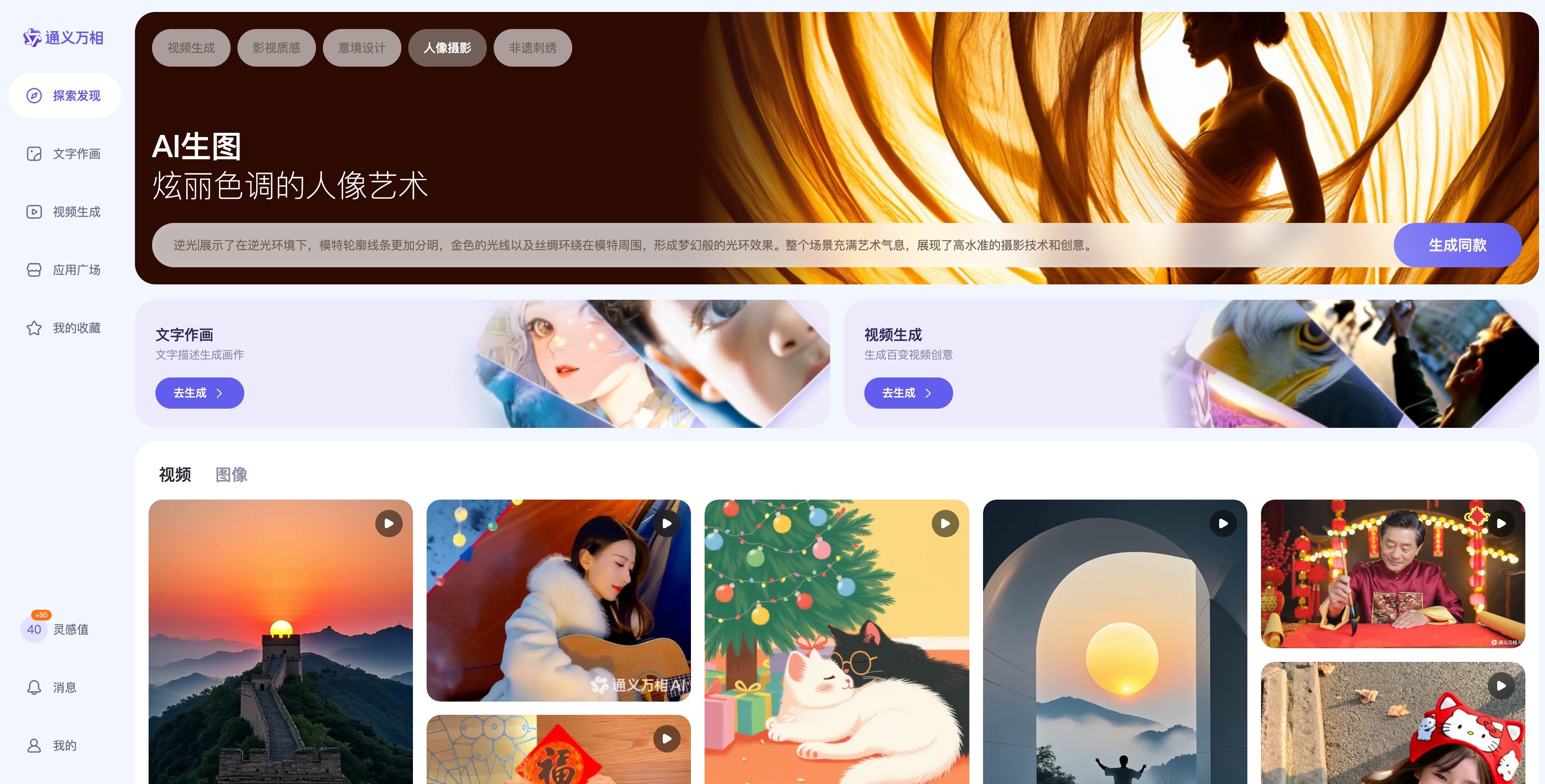

如何使用 Wan 2.2?

输入提示词或上传图片

从详细的文本提示词或参考图片开始。Wan 2.2 支持文生视频和图生视频,甚至可以混合输入。

调整质量与控制

选择 480p/720p/1080p,开启 LoRA 或镜头控制,在渲染前预览风格混合效果。

生成并下载

点击生成。你的高清视频通常会在 2 分钟内准备就绪——可立即下载或继续编辑。

为什么创作者选择 Wan 2.2

如何写出更好的 Wan 2.2 提示词

先用清晰的提示词公式开始

建议使用一个简单结构:主体 + 场景 + 动作。这样更容易控制提示词,也能帮助 Wan 2.2 更快理解核心画面。示例:'一位穿白色连衣裙的年轻女性,在日落时分有风的原野上,慢慢转身并看向镜头。'

先描述主体

在加入额外细节之前,先让主体足够清晰。说明它是谁或是什么,再补充几个明显特征。示例:'一个银色机器人,面部光滑,眼睛发出蓝色光芒。'

场景保持简洁,但要有画面感

加入简短的场景描述,让模型快速理解环境。重点写地点、时间和氛围。示例:'夜晚安静的城市街道,地面潮湿,映着霓虹灯反光。'

用动作词提升动态表现

动作是视频提示词的关键部分,所以尽量使用直接的动作词,比如走路、转身、奔跑、抬手或微笑。示例:'他向前走,抬起手,轻轻一笑。'

需要时加入镜头运动

如果你想要更有电影感的结果,可以写出镜头如何移动。简单的镜头描述就能让成片更有设计感。示例:'缓慢推近镜头' 或 '镜头从左向右平移。'

用光线和色彩设定氛围

简短的光线和色彩描述,可以快速改变视频的视觉气质。当你想要更柔和、更浓郁或更有戏剧性的效果时,这一点尤其有用。示例:'柔和的金色光线,暖色调,轻柔阴影。'

用镜头景别优化构图

通过描述取景方式,来控制画面呈现。像特写、中景、远景这样的词,可以直接影响最终构图。示例:'她的面部特写,头发在风中轻轻飘动。'

图生视频时,把重点放在动作上

在图生视频里,角色和场景通常已经由图片决定。你的提示词更应该强调动作和镜头行为,而不是把所有内容重新描述一遍。示例:'她慢慢转头,眨了眨眼,镜头轻轻推近。'

分层搭建提示词

先写基础动作,再一层层加入:动作、镜头、光线和风格。这样提示词更清晰,也更方便后续调整。示例:'一个男孩骑着自行车行驶在乡间小路上,中景,温暖的傍晚光线,镜头轻微跟随。'

提示词保持自然、易读

不需要堆太多关键词。清晰、自然的描述,往往比冗长杂乱的关键词串更有效。示例:'一只黑猫坐在雨天午后的窗边,望着落下的雨。'

每次只改一个部分来优化

如果结果已经接近,但还不够准确,每次只调整提示词中的一个部分,比如动作、构图或光线。这样更容易看出是哪一项影响了输出。示例:在其余内容不变的情况下,把 '远景' 改成 '特写'。

常见问题

什么是 Wan 2.2?

与 WanX 2.1 相比有哪些新特性?

Wan 2.2 可以免费使用吗?

支持哪些输入形式?

我可以个性化风格吗?

支持多语言提示词吗?

本地推理需要什么硬件?

如何更安全、更合规地使用 Wan 2.2?

为什么 Wan 2.2 的结果有时会失败?

为什么会出现动作不自然或画面不稳定?

如何提高生成成功率?

如果输出结果和我的想法不一致,我该怎么办?

所有生成结果都能直接用于正式制作吗?

Twitter 嵌入

立即用 Wan 2.2 创作

在 GoEnhance AI 体验下一代 AI 视频生成。