Revue Wan 2.1 2026 : Je l'ai testé et il est vraiment utilisable

- 1. Ce que je pense que Wan 2.1 réussit (et pourquoi c'est important)

- 2. Revue Wan 2.1 : ce qu'est réellement Wan 2.1

- 3. Ligne de modèles et structure (la partie qui vous fait gagner des heures)

- 4. Fonctionnalités clés qui changent vraiment les résultats

- 4.1 Génération multimodale (T2V et I2V)

- 4.2 Sortie haute résolution (avec attentes réalistes)

- 4.3 Efficace sur matériel grand public

- 4.4 Choix architecturaux qui favorisent la cohérence vidéo

- 4.5 Contrôle fin du prompt (comment j'écris vraiment mes prompts)

- 4.6 Support de synchronisation sonore (à considérer comme un bonus, pas une garantie)

- 4.7 Avantage open-source (la fonctionnalité cachée)

- 5. Prise en main (ce que je recommande, étape par étape)

- 6. Performance et benchmarks (ce que les chiffres signifient vraiment)

- 7. Cas d'usage réels (où Wan 2.1 excelle)

- 8. Défis et limites (ce que j'aimerais que plus de revues admettent)

- 9. Wan 2.1 vs alternatives (comment je fais une comparaison équitable)

- 10. Avantages et inconvénients (mon résumé honnête)

- 11. FAQ (les questions que je vois chaque semaine)

- 12. Conclusion : Wan 2.1 est « la vidéo open-source que vous pouvez vraiment utiliser »

L'avis sur Wan 2.1 se résume simplement : c'est l'un des premiers générateurs vidéo open-source qui semble « pratique » plutôt que « seulement impressionnant en démonstration », surtout si vous tenez à exécuter localement et à itérer rapidement. J'écris ceci du point de vue de quelqu'un qui construit des workflows vidéo répétables — pas seulement des clips cinématiques ponctuels — donc je me concentrerai sur la structure, les vraies fonctionnalités, et ce qui change réellement vos résultats quotidiens.

1. Ce que je pense que Wan 2.1 réussit (et pourquoi c'est important)

Wan 2.1 mérite votre attention car il transforme la génération vidéo open-source en un workflow que vous pouvez vraiment exécuter, ajuster, et relancer sans vous sentir perdu.

Voici la version courte de pourquoi cela compte pour moi :

- Contrôle local : je peux maintenir des expériences cohérentes (même style de prompt, même logique de réglages) et éviter les « sautes d'humeur du cloud ».

- Ligne claire de modèles : il y a une piste légère et une piste qualité, et la nomenclature a du sens dans l'ensemble.

- Une vraie boucle de production : générer → choisir un gagnant → itérer avec des changements contrôlés.

Si vous avez essayé d'anciens stacks vidéo open-source, vous connaissez le mode d'échec fréquent : vous passez 80 % de votre temps à lutter contre la configuration, la mémoire, et le mouvement instable. Wan 2.1 ne résout pas magiquement la génération vidéo, mais rend la boucle moins fragile.

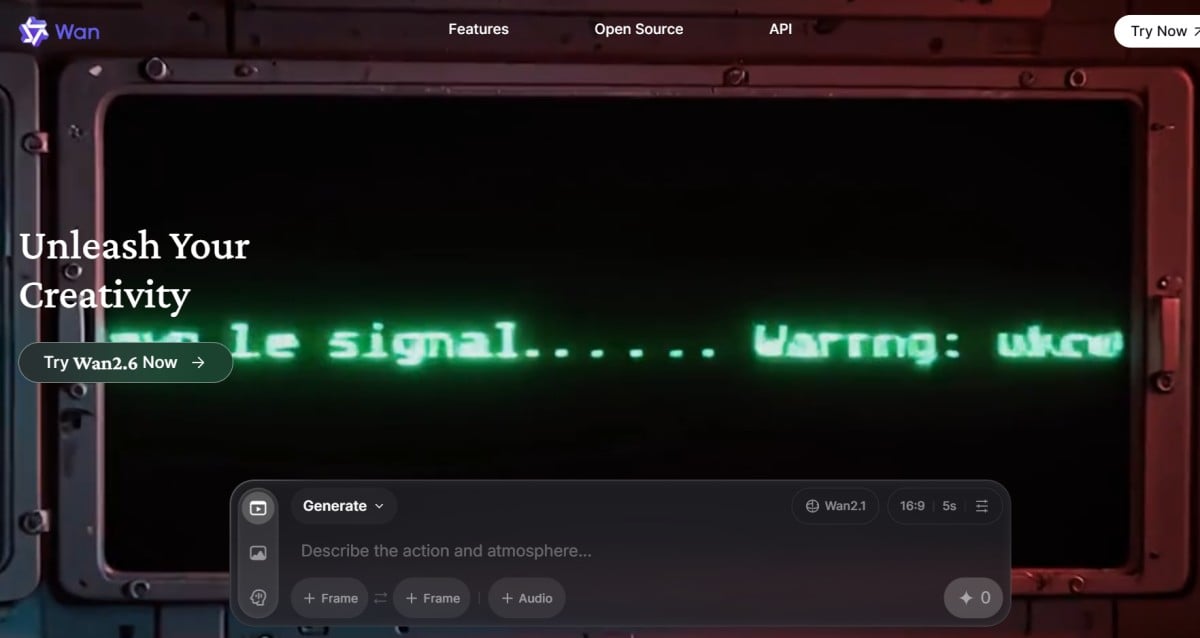

2. Revue Wan 2.1 : ce qu'est réellement Wan 2.1

Wan 2.1 en une phrase : c'est une famille de modèles open-source Text-to-Video et Image-to-Video conçue pour fonctionner sur des GPU grand public, avec une option légère pour un accès plus large et une autre plus conséquente pour une meilleure qualité.

Le dépôt officiel présente Wan 2.1 comme « exécuter la génération Text-to-Video » avec deux tailles principales de modèles T2V (1.3B et 14B) et deux résolutions cibles (480p et 720p). Le modèle 1.3B est positionné comme l'option pour « presque n'importe quel GPU grand public », tandis que la ligne 14B est la voie axée qualité. (Vous verrez aussi des variantes I2V dans les hubs de modèles et workflows communautaires.)

Un modèle mental rapide qui reste vrai en pratique :

- 1.3B = plus facile à exécuter, expérimentations rapides, idéal pour tester des idées de prompts.

- 14B = plus lourd, meilleur détail/cohérence, mieux pour les sorties « quasi finales ».

- 480p vs 720p = stabilité et vitesse contre clarté et détail.

Si vous parcourez les pages de la famille Wan, il est aussi utile de considérer Wan 2.1 comme le « set génération fondation », puis de jeter un œil à Wan 2.2 et Wan 2.6 plus tard pour voir l'évolution de la gamme.

3. Ligne de modèles et structure (la partie qui vous fait gagner des heures)

La structure de Wan 2.1 est étonnamment facile à comprendre pour un projet vidéo open-source.

À un niveau élevé, vous rencontrerez deux pistes pratiques :

- Text-to-Video (T2V)

- T2V-1.3B (généralement en 480p)

- T2V-14B (configurations 480p et 720p)

- Image-to-Video (I2V)

- Les variantes 14B I2V apparaissent souvent dans les workflows communautaires et hubs de modèles en 480p et 720p.

J'aime cette organisation car elle soutient une « échelle de production » claire :

- Phase brouillon (pas cher, rapide) : 1.3B en 480p pour valider l'idée.

- Phase upgrade (contrôle qualité) : 14B en 720p pour finaliser le mouvement et le détail.

- Phase packaging (distribution) : recadrage/extension/édition dans votre pipeline habituel.

Cette échelle est plus importante qu'on ne le pense : la façon la plus rapide de perdre du temps est de forcer la « qualité finale » dès la première génération.

4. Fonctionnalités clés qui changent vraiment les résultats

Wan 2.1 se distingue car ses fonctionnalités correspondent à ce que font les créateurs et constructeurs de façon répétée : contrôler le mouvement, rester cohérent, et ne pas exploser vos exigences matérielles.

Voici les fonctionnalités qui comptent le plus dans mon workflow, et ce qu'elles signifient concrètement.

4.1 Génération multimodale (T2V et I2V)

La gamme multimodale de Wan 2.1 est utile car elle offre deux styles de contrôle différents : création guidée par prompt et création guidée par référence.

- Text-to-Video est idéal quand vous explorez des concepts et directions narratives.

- Image-to-Video est idéal quand vous avez déjà un look (personnage/produit) et que vous avez besoin de mouvement.

En pratique, je considère I2V comme le mode « cohérence de marque ». Si vous venez d'un workflow image vers vidéo, la famille I2V de Wan 2.1 vous semblera familière : vous commencez d'une image forte et concentrez votre prompt sur le mouvement et la caméra.

4.2 Sortie haute résolution (avec attentes réalistes)

Wan 2.1 est performant sur les workflows 480p/720p, et il est le plus fiable lorsque vous acceptez cette résolution par défaut.

Certaines revues évoquent la capacité 1080p via certaines configurations 14B ou des chemins de suréchantillonnage, mais le principe pratique que j'applique est simple : commencez stable, puis suréchantillonnez, pas l'inverse. Démarrer en haute résolution et lutter contre l'instabilité, c'est payer « deux fois » en temps et en douleur GPU.

4.3 Efficace sur matériel grand public

Wan 2.1 marque des points car il est conçu pour fonctionner sans centre de données.

Le modèle léger 1.3B est spécifiquement positionné pour une large compatibilité GPU, et plusieurs guides présentent le stack comme « compatible GPU grand public » avec des choix précis (fp16/fp8) qui échangent qualité contre faisabilité. Si vous avez essayé d'exécuter d'autres modèles vidéo ouverts et rencontré des limitations VRAM instantanées, vous apprécierez que Wan 2.1 offre une véritable « porte d'entrée », pas juste un slogan marketing.

4.4 Choix architecturaux qui favorisent la cohérence vidéo

L'architecture de Wan 2.1 se manifeste par moins de « collapsus aléatoires » lorsque le mouvement commence.

Je ne dis pas que c'est parfait — le vidéo open-source reste le vidéo open-source — mais l'histoire de conception (VAE pour latents vidéo + backbone transformer pour diffusion) correspond à ce que l'on voit dans les sorties : le mouvement est souvent plus lisible, et les scènes ont moins tendance à fondre dès que la caméra bouge.

4.5 Contrôle fin du prompt (comment j'écris vraiment mes prompts)

Wan 2.1 réagit mieux lorsque vous écrivez les prompts comme un réalisateur, pas comme un poète.

Voici la structure de prompt que je réutilise :

- Ancre de sujet : qui/quoi ne doit pas changer

- Action : une idée principale de mouvement (pas cinq)

- Caméra : un comportement de caméra (statique / poussée lente / panoramique)

- Style : un niveau de style (cinématique, anime, documentaire, etc.)

- Contraintes : « pas de distorsion », « pas de membres supplémentaires », « arrière-plan stable », etc.

Un format d'exemple rapide (pas de sort magique — juste un template stable) :

- Sujet : « un petit robot chef »

- Action : « remue la soupe, vapeur montant »

- Caméra : « poussée lente »

- Style : « éclairage chaud de cuisine, aspect film »

- Contraintes : « garder le personnage cohérent, pas de scintillement, mains stables »

La raison pour laquelle cela fonctionne est ennuyeuse mais réelle : le modèle a moins d'opportunités de se contredire.

4.6 Support de synchronisation sonore (à considérer comme un bonus, pas une garantie)

L'angle synchronisation sonore de Wan 2.1 est excitant car la vidéo open-source tente rarement de parler d'alignement audio.

Cela dit, je considère la synchronisation sonore comme une « assistance », pas un remplacement du montage. Si votre projet demande une synchronisation labiale serrée ou des cuts au rythme parfait, vous voudrez toujours une étape post. Mais comme point de départ créatif — surtout pour des clips courts — la génération intégrée consciente du son est un pas significatif.

4.7 Avantage open-source (la fonctionnalité cachée)

Wan 2.1 est open-source : ça change ce que vous pouvez construire autour.

Pour les constructeurs et équipes, poids ouverts + inférence exécutable signifie :

- pipelines répétables,

- enregistrement des réglages quasi déterministe,

- capacité d'intégrer dans vos propres outils,

- et workflows communautaires qui s'améliorent vite.

Si vous publiez des expériences, documenter vos réglages devient partie intégrante de votre histoire « EEAT » : vous ne dites pas juste que c'est bon — vous montrez comment vous avez obtenu le résultat.

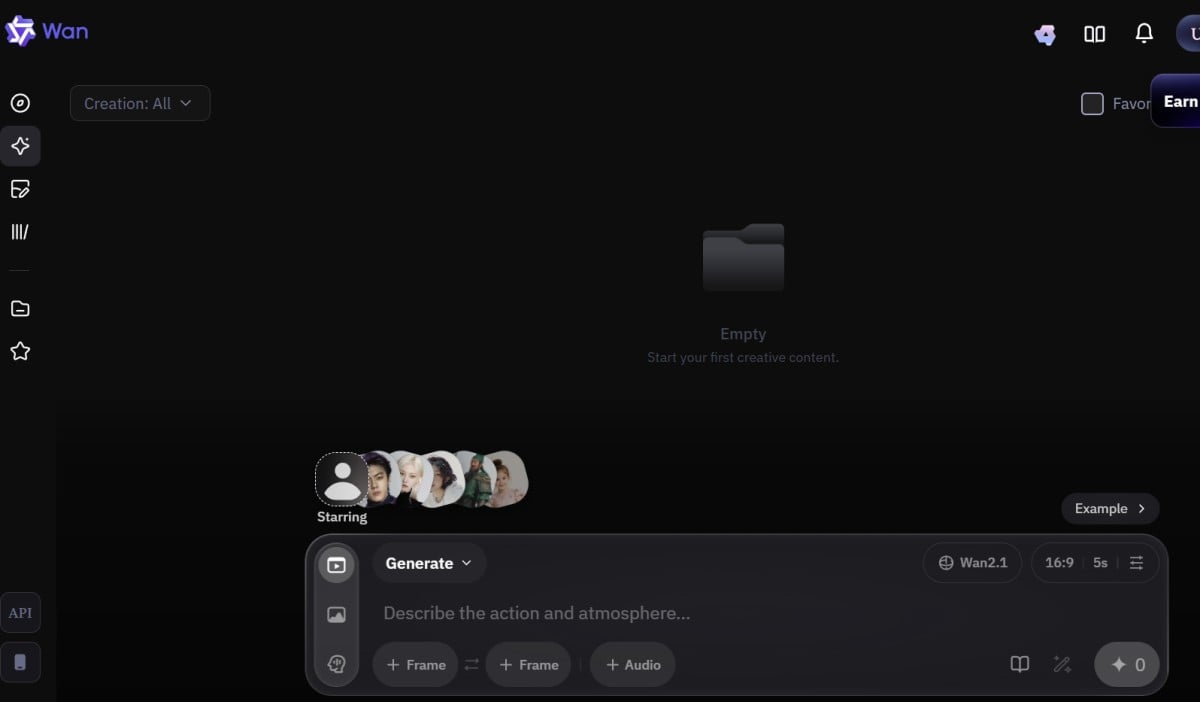

5. Prise en main (ce que je recommande, étape par étape)

Wan 2.1 est plus simple quand vous choisissez un chemin et vous y tenez une journée au lieu de sauter entre cinq installations.

Voici les deux voies pratiques que je vois la plupart des gens réussir à suivre :

5.1 Voie A : Workflow script/dépôt officiel

Cette voie est la meilleure si vous voulez de la reproductibilité et moins de variables d'interface.

- Clonez le dépôt officiel et suivez la configuration de l'environnement.

- Commencez avec T2V-1.3B @ 480p pour valider que tout fonctionne.

- Sauvegardez les configs comme vous sauvegarderiez du code : gardez un preset « éprouvé ».

- Only then passez à 14B / 720p.

À titre de référence (externe, nofollow) :

5.2 Voie B : Utilisation des workflows ComfyUI pour itérer plus vite

Cette voie est la meilleure si vous voulez vitesse, contrôle visuel, et variations faciles.

- Chargez un workflow communautaire éprouvé (ne commencez pas de zéro).

- Validez avec une génération courte.

- Construisez vos propres « boutons de variation » (seed, blocs prompt, bloc caméra, bloc mouvement).

À titre de référence (externe, nofollow) :

5.3 Ma checklist "ne perdez pas votre journée"

Wan 2.1 est plus fluide quand vous prenez quelques bonnes décisions disciplinées dès le départ.

- Utilisez d'abord des prompts courts, puis ajoutez des détails une fois le mouvement stable.

- Gardez une idée de mouvement par clip.

- Préférez les brouillons en 480p, puis passez à l'upgrade.

- Enregistrez seed + prompt + résolution + steps comme pour une expérience.

6. Performance et benchmarks (ce que les chiffres signifient vraiment)

L'histoire des performances de Wan 2.1 est bonne pour de l'open-source, mais lisez les benchmarks comme des « signaux de planification », pas comme des promesses.

Un exemple de runtime couramment cité : sur un RTX 3090 (24GB VRAM), Wan 2.1 peut générer environ 15 secondes de vidéo par minute de traitement. C'est un point de référence utile pour la planification et le budget, mais la vitesse réelle dépend beaucoup de la précision, des étapes, de la résolution et des charges du workflow.

Voici comment je traduis ces benchmarks en décisions :

- Si j'explore des idées : optimiser pour les itérations (résolution plus faible, moins d'étapes).

- Si je peaufine : optimiser la clarté (résolution plus élevée, plus d'étapes, meilleures contraintes du prompt).

- Si j'ai besoin de beaucoup de sorties : lots de variations avec petits changements contrôlés.

Tableau de planification rapide (pratique, pas scientifique)

| Objectif | Modèle | Résolution | Pourquoi ce combo fonctionne |

|---|---|---|---|

| Tester 10 concepts rapidement | 1.3B | 480p | brouillons moins chers, échecs rapides |

| Construire un pack de style constant | 14B | 720p | meilleur détail et cohérence |

| Figurer le mouvement, ensuite suréchantillonner | 14B | 480p → 720p | stabilité d'abord, qualité ensuite |

| Prototyper un personnage à partir d'une image | I2V 14B | 480p | la référence garde l'identité plus stable |

7. Cas d'usage réels (où Wan 2.1 excelle)

Wan 2.1 est au meilleur lorsqu'on le traite comme un générateur de blocs de construction, pas une machine à film complet.

Voici les cas d'usage où j'ai vu les modèles vidéo open-source (y compris Wan 2.1) apporter une vraie valeur :

-

Génération de contenu créatif (format court)

- clips punchy de 5–10 secondes pour reels/shorts

- moments de mouvement en boucle (cycles de marche, réactions, actions simples)

-

Prototypes marketing

- publicités concepts avant production complète

- brouillons produit-en-scène (notamment via I2V)

-

Storyboard et prévisualisation

- « qualité baseline du mouvement pour validation du rythme »

- tests de mouvement de caméra avant tournage/animation final

-

Exploration de style

- un concept, plusieurs esthétiques

- tests A/B contrôlés avec mouvement constant

Si vous voulez un simple « lieu pour comprendre toute la famille », la page d'aperçu Wan AI est un hub interne utile — puis branchez-vous sur les pages des versions spécifiques en ciblant.

8. Défis et limites (ce que j'aimerais que plus de revues admettent)

Wan 2.1 est puissant, mais la vidéo open-source demande encore patience et discipline.

Voici les limites que je planifie :

-

La stabilité sur clips longs reste difficile

Même les modèles forts peuvent dériver avec le temps ; prévoyez d'assembler des clips courts plutôt que forcer de longs. -

Le sur-écriture de prompts nuit plus qu'elle n'aide

Trop d'adjectifs de style et d'actions superposées nuisent souvent à la cohérence du mouvement. -

Les contraintes matérielles sont réelles

Les modèles 14B peuvent être gourmands ; la meilleure solution est un pipeline brouillon → upgrade, pas de la force brute. -

Artefacts et scintillements occasionnels

Vous verrez encore des scintillements, des mains qui morphent, ou un fond qui vacille ; prévoyez une étape post (dénoyautage, stabilisation, montage). -

Variance dans les workflows communautaires

Deux « workflows Wan 2.1 » peuvent se comporter très différemment selon les nœuds, planificateurs, et paramètres par défaut — enregistrez vos réglages.

9. Wan 2.1 vs alternatives (comment je fais une comparaison équitable)

Wan 2.1 est le meilleur concurrent quand vous le comparez à d'autres options open et à des outils cloud non personnalisables.

Je compare selon quatre critères :

- Faisabilité locale (est-ce que je peux vraiment l'exécuter ?)

- Cohérence du mouvement (ça tient la route ?)

- Contrôle (prompt + réglages sont-ils prévisibles ?)

- Écosystème workflow (y a-t-il des guides/workflows stables ?)

Tableau comparatif (centré créateur)

| Modèle / Option | Force | Faiblesse | Idéal pour |

|---|---|---|---|

| Wan 2.1 | pipeline open exécutable + bonne cohérence | nécessite encore des réglages | constructeurs + boucles production répétables |

| Modèles cloud propriétaires | rapidité + sorties polies | moins de contrôle/visibilité | prises marketing ponctuelles |

| Autres stacks vidéo open | expérimentation flexible | friction à l'installation | recherche + workflows niches |

Si vous suivez la lignée Wan précisément, comparer Wan 2.1 à Wan 2.2 vous aide à comprendre les améliorations de la génération plus récente (notamment sur le focus I2V), tandis que Wan 2.6 est généralement là où vous regardez les « nouveaux boutons » après avoir appris les bases.

10. Avantages et inconvénients (mon résumé honnête)

Wan 2.1 est un choix open-source solide si vous voulez contrôle et répétabilité plus que perfection instantanée.

Avantages

- Échelle claire de modèles (brouillons 1.3B → qualité 14B)

- Positionnement local-friendly (surtout 1.3B)

- Cohérence de mouvement solide pour sa catégorie

- Écosystème ouvert : workflows qui progressent vite

Inconvénients

- Encore plus lent et manuel que les outils cloud

- La haute qualité demande du matériel gourmand

- Les clips longs dérivent ; mieux vaut petits clips + assemblage

- Demande discipline dans le prompting et les réglages

11. FAQ (les questions que je vois chaque semaine)

Wan 2.1 répond à la plupart des questions « est-ce utilisable ? » par : oui, si vous le traitez comme un pipeline.

Q : Dois-je commencer par 14B pour les meilleurs résultats ?

Non — commencez par 1.3B pour verrouiller votre workflow, puis montez en gamme une fois que vos réglages sont stables.

Q : Le 720p est-il toujours mieux que le 480p ?

Non, si votre mouvement est instable. Je préfère un brouillon 480p stable à un clip 720p tremblant.

Q : Puis-je l'utiliser pour du travail professionnel ?

Oui pour des prototypes, conceptions, et contenus courts, mais attendez-vous à un workflow post pour le polish.

Q : Quelle est la manière la plus rapide d'améliorer la qualité de sortie ?

Choisissez une idée de mouvement, simplifiez le prompt, et itérez avec changements contrôlés (seed/steps/résolution) au lieu de tout réécrire.

Pour référence officielle (externe, nofollow) :

12. Conclusion : Wan 2.1 est « la vidéo open-source que vous pouvez vraiment utiliser »

L'avis sur Wan 2.1 se termine là où il a commencé : ce n'est pas un modèle qui supprime magiquement tous les problèmes de génération vidéo, mais c'est un des premiers stacks open-source qui donne l'impression qu'on peut construire un workflow répétable autour. Si vous l'abordez avec une échelle disciplinée — brouillon rapide, upgrade ensuite, et prompt comme direction — Wan 2.1 devient moins un projet scientifique et plus un outil pratique que vous utiliserez chaque semaine.