Seedance 2.0

Seedance 2.0 wurde entwickelt, damit KI-Video weniger wie eine zusammengesetzte Demo und mehr wie eine fertige Szene wirkt. Erstelle Clips mit stimmigerem Tempo, konsistenterer Bewegung und besserer Performance, damit Stimme, Timing und Handlung auf dem Bildschirm zusammenpassen, statt auseinanderzudriften.

Terms of Use and Privacy Policy

Sieh dir an, was du mit Seedance 2.0 erstellen kannst

Erkunden Sie die Generierungsfunktionen von Seedance 2.0

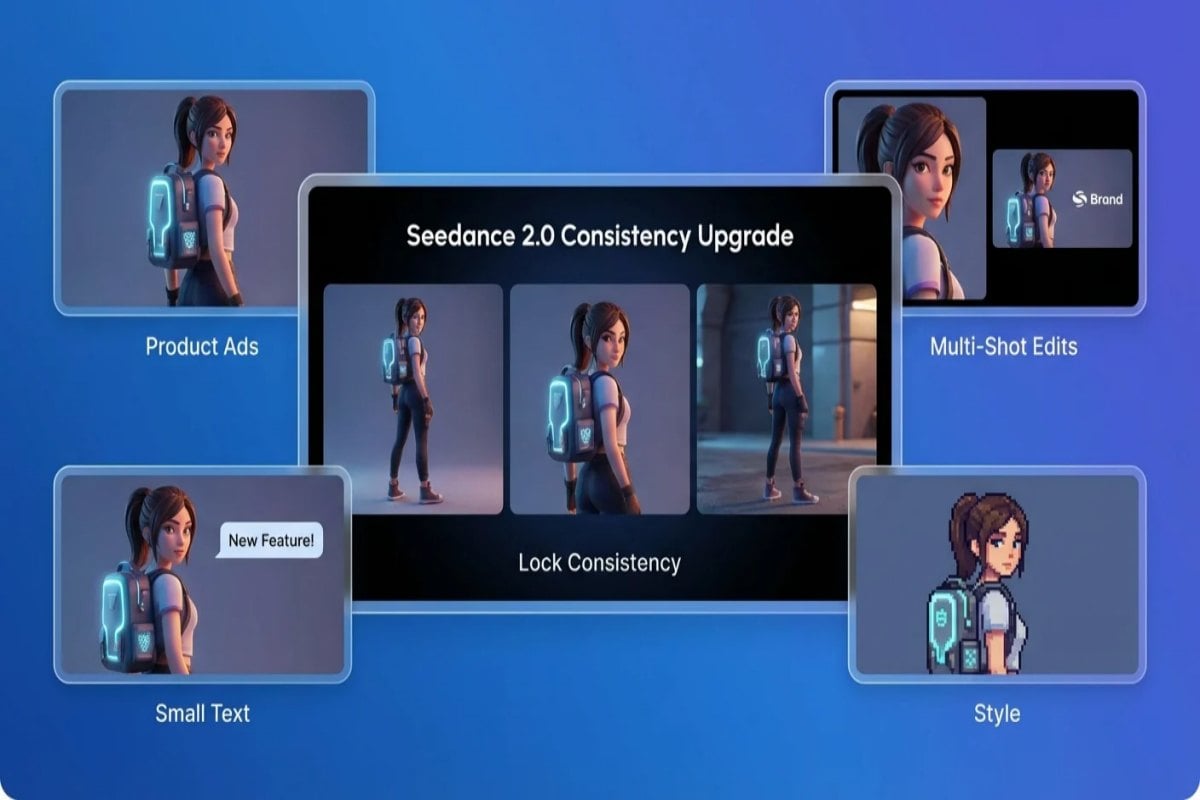

Konsistenz, die bleibt: Gesichter, Produkte, Kleinsttext und Stil

Die frustrierendsten Probleme bei der Videogenerierung haben selten mit „Schönheit“ zu tun, sondern mit Drift: Ein Gesicht verändert sich, Produktdetails verschwinden, winziger Text wird matschig, Szenen springen oder der Stil kippt mitten in der Sequenz. Seedance 2.0 ist darauf ausgelegt, solche „Anker“ zuverlässiger zu halten – von Gesichtszügen und Outfit bis hin zu Materialwirkung, Logos und Typografie – damit Multi-Shot-Workflows stabiler und wirklich nutzbar werden.

Ideal für Produktanzeigen, charaktergetriebene Shorts, Multi-Shot-Edits, textlastige Szenen und überall dort, wo Kontinuität zählt.

Echter wirkende Stimmen, besseres Audio

Seedance 2.0 zielt nicht nur auf bessere Frames – sondern auf glaubwürdigeren Sound. Stimmen treffen die gewünschte Figur besser, mit natürlicherem Sprechfluss und mehr emotionaler Dynamik. Musik und Atmosphäre sitzen im Raum, ohne diesen offensichtlichen „Template“-Vibe. Das Ergebnis: Audio unterstützt die Performance, statt abzulenken.

Für Talking-Head-Clips, Dialogszenen, Voice-over, Comedy-Banter und musikgetriebene Edits, bei denen Timing und Ton die Story tragen.

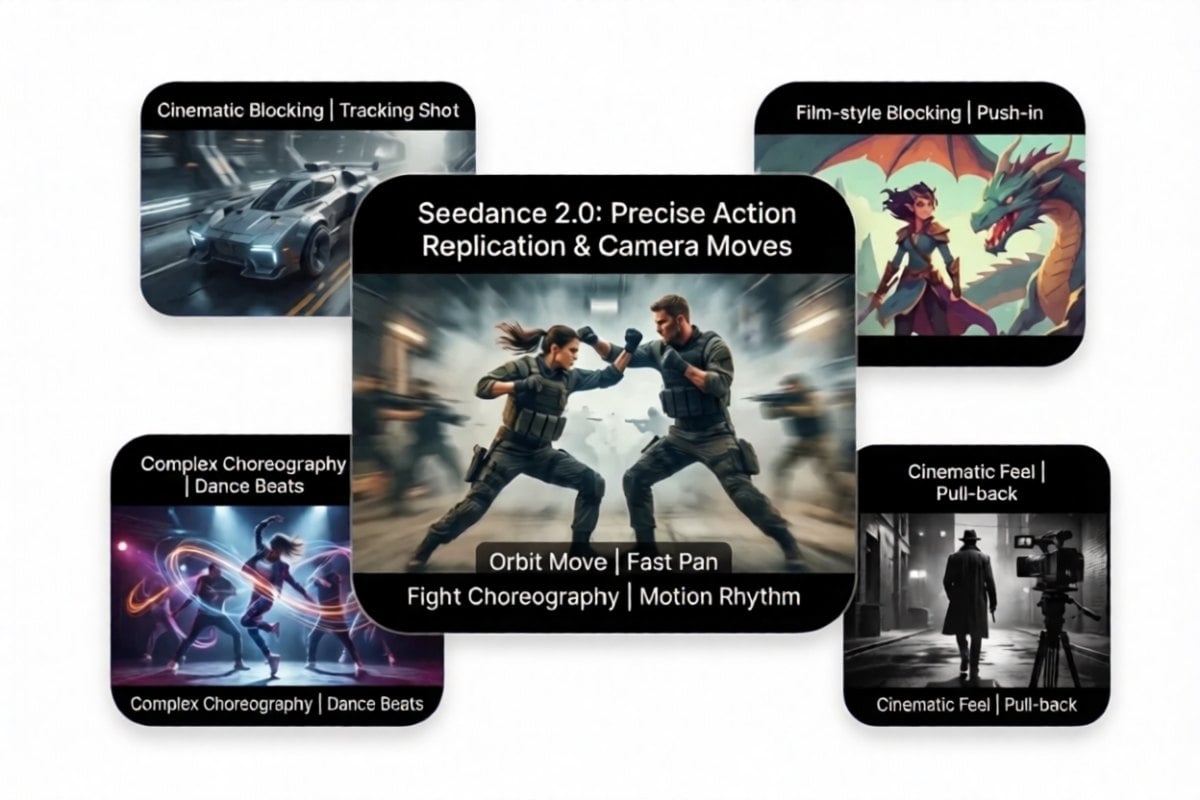

Präzise Kamera + Action: Filmisches Blocking wird praktisch

Früher bedeutete filmisches Blocking, Kamera-Sprache oder komplexe Choreografie nachzubauen: endlose Prompt-Wände – oder aufgeben. Mit Seedance 2.0 übernimmt ein einzelner Referenzclip die Hauptarbeit: Bewegungsrhythmus, Kamerafahrten und Action-Takt bleiben näher an der Vorlage. Sag einfach, was übernommen werden soll und was sich ändern darf – und die Shots wirken „geführt“ statt „zufällig“.

Perfekt für Tracking Shots, Push-ins/Pull-backs, Orbit-Moves, schnelle Pans, Fight-Choreo, Dance-Beats und jede Szene, in der du ein bestimmtes Kino-Feeling reproduzieren willst.

Audio-Video-Synchronisation, die im echten Dialog standhält

Erstellen Sie Videos, bei denen das Timing absichtlich wirkt: Dialogtempo, Mikropausen und Bewegungen auf dem Bildschirm bleiben im Einklang, sodass Szenen nicht in das bekannte „KI-Dub"-Gefühl abgleiten. Seedance 2.0 konzentriert sich darauf, die Performance lesbar zu halten – Mundbewegungen, Gesichtsspannung und kleine Gesten passen zur Darbietung, anstatt mitten in der Aufnahme abzuweichen.

Verwenden Sie es für Kameraansprachen, Erklärvideos, Charaktermonologe und jede Szene, bei der Glaubwürdigkeit aus Rhythmus und Timing entsteht – nicht nur aus schönen Bildern.

Filmische Bewegungen, sauberere Schnitte, weniger „KI-Merkwürdigkeiten"

Seedance 2.0 wurde für Kreative entwickelt, die weniger Takes, weniger Nachbearbeitungen und mehr „auf Anhieb brauchbare" Aufnahmen wünschen – besonders bei mehrteiligen Szenen mit filmischen Beats.

Wenn Sie die Seedance-Reihe vergleichen möchten, können Sie unseren KI-Videogenerator ausprobieren und erkunden, wie Seedance 2.0 sich zu Seedance 1.5 Pro, Seedance Pro und Seedance Lite verhält – damit Sie die richtige Balance aus Qualität, Geschwindigkeit und Kontrolle für Ihren Workflow finden.

Wichtige Features von Seedance 2.0

- Glaubwürdigere Performance

- Präzise Kamera + Action-Replikation

- Kreativ-Templates + komplexe Effekte, die sauber kopieren

- Mehr Kreativität + Story-Completion

- Konsistenz, die nicht wegrutscht

- Erweitern & weiterführen ohne harten Reset

- Natürlichere Bewegung + Audio, das echter wirkt

- Seedance 2.0 vs Seedance 1.5 Pro

Glaubwürdigere Performance

| Prompt | Generiertes Video |

|---|---|

Ein filmischer Close-up eines Presenters in einem weich ausgeleuchteten Studio. Die Kamera fährt langsam nach vorn, während er/sie eine kurze, emotionale Zeile spricht. Die Mikro-Expressionen ändern sich natürlich im Takt, und die Mundbewegung bleibt über den gesamten Take hinweg konsistent. |

Präzise Kamera + Action-Replikation

| Prompt | Referenzvideo | Generiertes Video |

|---|---|---|

Nutze **@Image 1** als Hauptmotiv (die weibliche Celebrity). Folge **@Video 1** für den Kamerastil mit rhythmischen Push-ins, Pull-backs, Pans und Moves. Die Performance der Celebrity soll außerdem den Tanzaktionen der Frau in **@Video 1** folgen — für eine energetische, lebendige Bühnenshow. |

Kreativ-Templates + komplexe Effekte, die sauber kopieren

| Prompt | Referenzbild | Referenzvideo | Generiertes Video |

|---|---|---|---|

Schwarz-weiß im Ink-Wash-Stil. Nutze die Figur aus @Image 1 als Hauptmotiv und folge @Video 1 für Effekte und Bewegungen, um eine Ink-Painting-Tai-Chi-Kung-fu-Sequenz zu performen. |  |

Mehr Kreativität + Story-Completion

| Prompt | Referenzbild | Referenzvideo | Generiertes Video |

|---|---|---|---|

Ein filmischer Close-up eines Presenters in einem weich ausgeleuchteten Studio. Die Kamera fährt langsam nach vorn, während er/sie eine kurze, emotionale Zeile spricht. Die Mikro-Expressionen ändern sich natürlich im Takt, und die Mundbewegung bleibt über den gesamten Take hinweg konsistent. |  |

Konsistenz, die nicht wegrutscht

| Prompt | Referenzvideo | Generiertes Video |

|---|---|---|

Ersetze die Frau in **@Video 1** durch eine traditionelle chinesische Opernfigur, *huadan*. Setze die Szene auf eine elegante, reich verzierte Bühne. Folge @Video 1 für Kamerabewegung und Transitions und matche die Aktionen der Performerin möglichst nah. Ziel: eine raffinierte, theatrale Ästhetik mit starkem visuellen Impact. |

Erweitern & weiterführen ohne harten Reset

| Prompt | Generiertes Video |

|---|---|

Erweitere @Video 1 um 15 Sekunden: 0–5s, Licht und Schatten wandern durch Jalousien und gleiten langsam über einen Holztisch und die Oberfläche einer Tasse, während Äste draußen sanft schwingen; 6–10s, eine einzelne Kaffeebohne fällt von oben ins Bild und die Kamera fährt darauf zu, bis das Bild zu Schwarz ausblendet; 11–15s, englischer Text erscheint allmählich in drei Zeilen. |

Natürlichere Bewegung + Audio, das echter wirkt

Seedance 2.0 vs Seedance 1.5 Pro

| Merkmal | Seedance 2.0 | Seedance 1.5 Pro |

|---|---|---|

| Was man zuerst merkt | Reife Basis mit starkem Sync und solider Stabilität in Alltags-Dialogen. | Mehr filmischer Rhythmus und Performance-Nuance für dialoglastige Szenen. |

| Prompt-Interpretation | Zuverlässig bei klaren Prompts, schnelle Iteration. | Konsequenter bei Kamerasprache und Shot-Intent. |

| Motion-Qualität | Verlässlich für allgemeine Szenen. | Sauberere Motion-Arcs und weniger merkwürdige Micro-Jitters in Close-ups. |

| Performance-Konsistenz | Gute Identitätsstabilität in kurzen Clips. | Stabilere Gesichtsdetails und weniger Expression-Drift im Shot. |

| Beste Use Cases | Am besten für: schnelle Social-Drafts, einfache Erklärvideos. | Am besten für: cineastische Promos, skriptbasiertes Talk-to-Camera, Story-Beats. |

| Einordnung | Früher veröffentlichte Generation | Seedance 2.0 Generation |

Seedance 2.0 Parameter

Weitere aktuelle Videomodelle

Funktionen des Seedance 2.0 Videomodells

Audio-Video-Kohärenz an erster Stelle

Stabilere Frames & weniger Artefakte

Bessere Kontrolle filmischer Prompts

Flexible Formate für echte Arbeit

Ausdrucksstärkere Schauspielkunst

Schnellere Iterationsschleife

Diskussion auf Twitter

Das solltest du wissen

Was ist Seedance 2.0?

Warum unterscheidet sich Seedance 2.0 von anderen KI-Video-Tools?

Warum ist Audio-Visual-Alignment bei KI-Video so wichtig?

Wie promte ich Seedance 2.0 für cineastische Ergebnisse?

Was sind die besten Use Cases für Seedance 2.0?

Seedance 2.0 vs Seedance 1.5 Pro: Welche sollte ich wählen?

Wie kann ich Artefakte reduzieren und die Konsistenz in meinem Video verbessern?

Bis zu welcher Länge kann Seedance 2.0 ein Video generieren?

Welche Inputs kann ich mit Seedance 2.0 verwenden (Text, Bild, Video, Audio)?

Wie nutze ich Referenzvideos, ohne das Ergebnis zu überbeschränken?

Wie halte ich Character Consistency über mehrere Shots hinweg?

Wie bekomme ich sauberere Camera Moves (Push-in, Pan, Orbit) und vermeide Jitter?

Kann Seedance 2.0 komplexe Transitions oder templateartige Edits nachbilden?

Wie kann ich einem Clip mehr Sekunden hinzufügen, ohne die Kontinuität zu brechen?

Kann ich ein bestehendes Video bearbeiten, statt von Grund auf neu zu generieren?

Wie vermeide ich Text-Probleme wie verschwommene Schilder oder unlesbare Labels?

Wie sollte ich mit sensiblen oder eingeschränkten Real-Person-Face-Inputs umgehen?

Was ist ein guter Workflow für Produktionsteams (Konsistenz + Geschwindigkeit)?

Probieren Sie Seedance 2.0 jetzt aus

Verwandeln Sie Prompts oder Bilder in filmische Clips mit klareren Bewegungen, stabileren Szenen und natürlicherer Performance.

Jetzt starten