Recensione del generatore video InVideo AI: la mia esperienza pratica dopo 3 settimane di test

- 1. A chi è destinata questa recensione

- 2. Cosa rende InVideo AI diverso dagli altri strumenti video AI

- 3. Testare il generatore da testo a video: cosa hanno effettivamente prodotto i prompt

- 4. Il flusso di lavoro da immagine a video: dove InVideo guadagna effettivamente il suo prezzo

- 5. InVideo AI vs. Runway Gen-2, Kaiber e D-ID: un confronto diretto

- 6. Modifica e perfezionamento: quanto controllo hai effettivamente?

- 7. Analisi dei prezzi: cosa ottieni effettivamente a ciascun livello

- 8. Progetti reali per cui ho usato questo (e i risultati effettivi)

- 9. Suggerimenti che hanno effettivamente cambiato i miei risultati

- 10. Conclusione: la mia opinione onesta dopo tre settimane

1. A chi è destinata questa recensione

Se sei un creatore di contenuti, venditore di e-commerce o marketer che ha bisogno di produrre rapidamente video brevi—senza toccare Premiere o After Effects—InVideo AI merita una seria considerazione. Ho trascorso tre settimane mettendolo alla prova: generando demo di prodotti, clip social e pezzi di narrazione culturale, poi confrontando i risultati con Runway Gen-2, Kaiber e D-ID. Ecco cosa ho effettivamente trovato, incluso dove mi ha messo in difficoltà.

2. Cosa rende InVideo AI diverso dagli altri strumenti video AI

Il vero vantaggio di InVideo AI non è la qualità visiva grezza—è la velocità dell'intero flusso di lavoro dall'idea all'esportazione. La maggior parte degli strumenti video AI ti consegna una clip e ti lascia a capire il resto. InVideo avvolge generazione, modifica e modelli in un unico ciclo, il che conta molto quando stai testando cinque varianti di annunci con una scadenza.

Tre cose a cui sono tornato durante i test:

- Generazione da testo a video che gestisce prompt di scena ragionevolmente complessi senza costante assistenza

- Animazione da immagine a video che produce clip di movimento utilizzabili in meno di 10 minuti

- Libreria di modelli che ti permette di inserire filmati generati dall'AI in layout pre-brandizzati invece di costruire da zero

Nessuna di queste è una novità nel settore. Ma avere tutti e tre in un'unica interfaccia, senza una curva di apprendimento ripida, è più raro di quanto si pensi. Secondo MIT Technology Review, l'attuale ondata di strumenti video generativi è ancora frammentata—la maggior parte eccelle in un livello dello stack, non nell'intero pipeline.

3. Testare il generatore da testo a video: cosa hanno effettivamente prodotto i prompt

Prompt specifici e strutturati mi hanno dato bozze di qualità broadcast; quelli vaghi hanno sprecato crediti. Questa è la cosa più importante che ho imparato eseguendo circa 40 tentativi di generazione in tre settimane.

Ho testato tre tipi di progetti reali:

-

Demo di prodotto e-commerce — Prompt: "Bottiglia di skincare rotante a 360 gradi su sfondo bianco, illuminazione da studio morbida, zoom lento." Risultato: pulito, utilizzabile al primo tentativo. Ho usatostrumenti AI da testo a video per pre-ottimizzare il mio flusso di lavoro, il che ha aiutato a ridurre le incoerenze di generazione nell'esportazione finale.

-

Clip teaser Instagram/TikTok — Tagli di 6 secondi per un marchio alimentare. Il movimento era leggermente drammatico al primo passaggio—più simile a un trailer di blockbuster che a un post di prodotto. Ci sono volute due revisioni del prompt per ridurlo.

-

Pezzo di narrazione culturale — Animato un prodotto tessile tradizionale con movimento cinematografico. Qui ho incontrato il più grande ostacolo: l'AI ha interpretato erroneamente la texture del tessuto e ha generato distorsioni irrealistiche. Ho finito per sostituire quel segmento con una clip modello, che ha effettivamente salvato il video finale.

La conclusione: pianifica i tuoi prompt come scriveresti una lista di riprese, non come descriveresti un'atmosfera. Quel cambiamento da solo ha ridotto le mie generazioni fallite di oltre la metà.

4. Il flusso di lavoro da immagine a video: dove InVideo guadagna effettivamente il suo prezzo

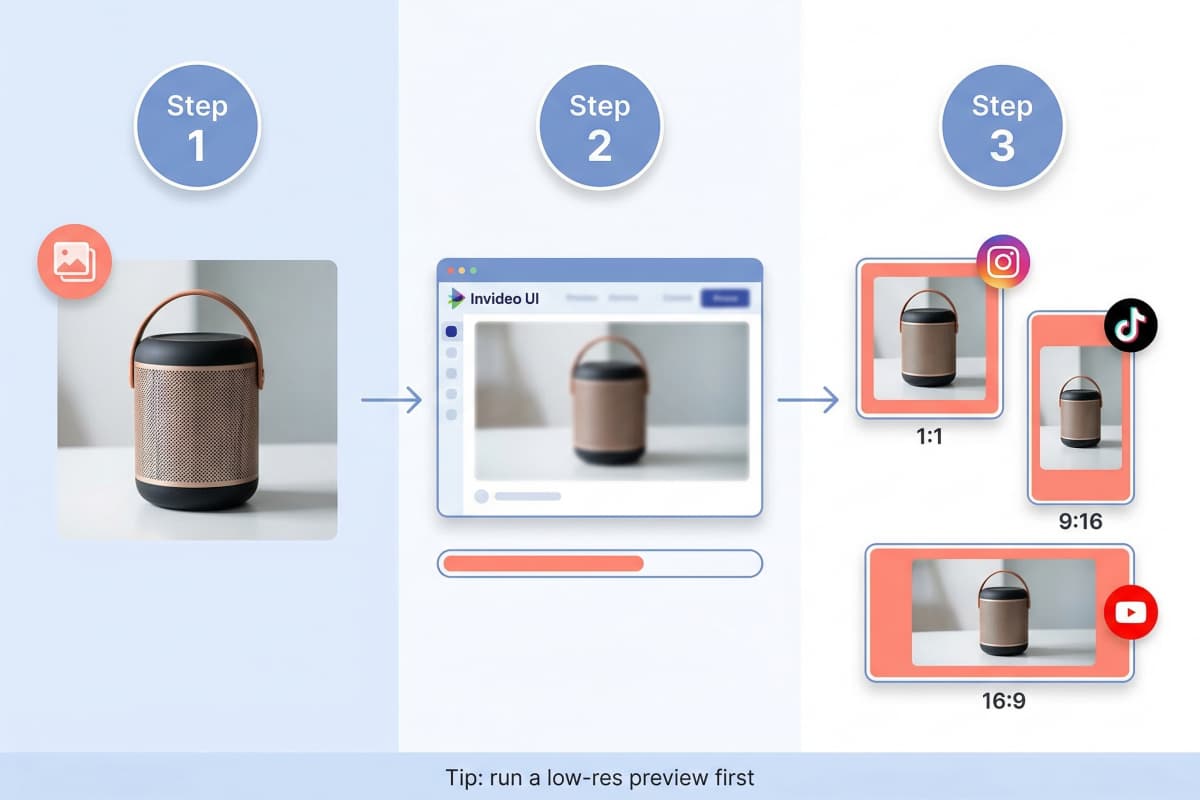

La funzione da immagine a video è la parte più affidabile della piattaforma—e quella per cui pagherei da sola. Per chiunque lavori con la fotografia di prodotto o asset di marca statici, questo flusso di lavoro sostituisce ciò che prima richiedeva ore in After Effects.

Il mio processo standard per un video di prodotto:

- Pre-potenziare l'immagine sorgente usando strumenti da immagine a video — questo passaggio ha fatto una differenza misurabile nella nitidezza dell'output, soprattutto per le esportazioni 4K

- Carica il file ad alta risoluzione su InVideo

- Seleziona lo stile di animazione — Ho scelto di default zoom sottile per contenuti di prodotto e parallax per immagini di stile di vita

- Esegui prima un'anteprima a bassa risoluzione (risparmia crediti e cattura errori AI evidenti in anticipo)

- Regola il tempo e la scala del movimento, quindi esporta a 1080p o 4K

| Passaggio | Cosa ho effettivamente fatto | Cosa farei diversamente |

|---|---|---|

| Immagine sorgente | Scattata su iPhone 14 Pro, 4K | Usa una fotocamera mirrorless per prodotti con texture pesanti |

| Stile di animazione | Zoom fluido per la maggior parte delle clip | Testa il parallax prima—ha funzionato meglio del previsto |

| Risoluzione anteprima | Sempre eseguita prima a bassa risoluzione | Nessun cambiamento qui—questo da solo mi ha risparmiato ~20% della mia spesa di crediti |

| Esportazione | 1080p per social, 4K per consegne ai clienti | — |

Una limitazione onesta: se la tua immagine sorgente ha uno sfondo occupato, gli artefatti di movimento diventano disordinati. Gli sfondi solidi o sfocati funzionano significativamente meglio.

5. InVideo AI vs. Runway Gen-2, Kaiber e D-ID: un confronto diretto

InVideo vince per velocità di flusso di lavoro e flessibilità dei modelli; perde per qualità del movimento cinematografico. Dopo aver eseguito prompt comparabili su tutte e quattro le piattaforme, ecco come si confrontano effettivamente per il lavoro che faccio:

| Caratteristica | InVideo AI | Runway Gen-2 | Kaiber | D-ID Creative Reality Studio |

|---|---|---|---|---|

| Input principale | Testo e immagine | Video / testo | Immagine e testo | Immagine e video |

| Velocità di generazione | Molto veloce (5–10 min) | Moderata (15–25 min) | Veloce | Moderata |

| Libreria di modelli | ✅ Libreria completa | Limitata | ❌ | ❌ |

| Controllo del movimento | Base ma coerente | Avanzato | Buon controllo stilizzato | Limitato |

| Dove eccelle effettivamente | Volume sociale e e-commerce | Design del movimento cinematografico | Clip d'arte stilizzate | Video di teste parlanti AI |

| Dove cade corto | Movimento organico complesso | Curva di apprendimento ripida | Nessun supporto per modelli | Uso limitato |

Per il mio flusso di lavoro—contenuti social e e-commerce ad alto volume—InVideo è lo strumento giusto. Se stessi producendo un cortometraggio o un video di marca ad alta produzione, sceglierei Runway. La copertura AI di Forbes sugli strumenti video generativi fa un punto simile: le piattaforme divergono nettamente a seconda che la velocità o la qualità siano il vincolo principale.

6. Modifica e perfezionamento: quanto controllo hai effettivamente?

L'editor di InVideo ti dà abbastanza controllo per contenuti social di livello professionale, ma raggiunge un limite su regolazioni creative complesse. L'editing in linguaggio naturale—dove scrivi qualcosa come "rendi la transizione più lenta" e aggiorna la clip—funziona meglio di quanto mi aspettassi per cambiamenti di base. Si sgretola su richieste sfumate come "applica solo questo alla terza scena."

Cosa ha funzionato bene nelle mie modifiche:

- Sostituire segmenti generati dall'AI con clip modello quando la generazione non ha centrato il bersaglio

- Regolare il tempo della musica e il ritmo della scena tramite comandi testuali

- Cambiare font, colori e animazioni di testo senza toccare una timeline

Cosa ha richiesto soluzioni alternative:

- Controllo del movimento fine su fotogrammi specifici ha ancora bisogno di intervento manuale

- L'editor in linguaggio naturale occasionalmente reinterpretava le mie istruzioni e cambiava cose che non avevo chiesto di toccare

Il mio processo di editing effettivo è diventato: generare → anteprima a bassa risoluzione → correggere i uno o due segmenti che ne hanno bisogno → esportazione finale. Quel ciclo si è svolto in circa 25–35 minuti per una clip di 30 secondi, che è abbastanza veloce per il volume che stavo producendo.

7. Analisi dei prezzi: cosa ottieni effettivamente a ciascun livello

Il livello gratuito è utile solo per la valutazione—se stai producendo contenuti a qualsiasi volume reale, avrai bisogno di un piano a pagamento entro la prima settimana. Ecco cosa ho trovato dopo aver esaminato i numeri sul mio utilizzo effettivo:

- Livello gratuito: ~10 minuti di generazione totale, esportazioni con filigrana. Buono per testare se lo strumento si adatta al tuo flusso di lavoro, non molto altro.

- Livello a pagamento iniziale (~$70): 2 minuti di video generato dall'AI. Per contesto, una clip di 30 secondi ad alta qualità utilizza circa 0.5–1 minuto di tempo di generazione, quindi questo copre una piccola campagna.

- Livello a pagamento medio (~$130): 16 minuti di video AI. Qui inizia ad avere senso per la produzione di contenuti costante.

- Qualità di esportazione: 1080p incluso nei piani a pagamento; 4K richiede un livello di abbonamento superiore.

Per contesto sui costi effettivi del marketing video rispetto agli strumenti di produzione fai-da-te, le statistiche di marketing di HubSpot analizzano i costi medi di produzione video per canale—i prezzi di InVideo sembrano competitivi anche rispetto alle tariffe freelance di fascia media.

Una cosa che vorrei segnalare: i crediti vanno più veloce di quanto ti aspetti quando stai iterando. Eseguire anteprime a bassa risoluzione prima di impegnarsi in un'esportazione completa è l'abitudine migliore per gestire la tua quota mensile.

8. Progetti reali per cui ho usato questo (e i risultati effettivi)

InVideo ha fornito il valore più misurabile su contenuti ad alto volume e formato breve—non su video eroi raffinati. Ecco cosa ho effettivamente prodotto e cosa è successo:

- Loop di prodotto e-commerce (3–6 secondi): Generato 12 varianti per un singolo prodotto in un pomeriggio. Tre di loro sono andati direttamente in annunci a pagamento senza ulteriori modifiche. In precedenza ci sarebbero voluti due giorni di lavoro manuale.

- Reels di Instagram per un cliente alimentare: Usato il flusso di lavoro da immagine a video su fotografia alimentare esistente. Il cliente ha approvato al primo esame—qualcosa che non accade spesso.

- Creativi di test A/B per una campagna di marketing: Creato 8 varianti dello stesso concetto in meno di due ore. La variante vincente ha superato il controllo con un margine di cui il cliente era soddisfatto.

- Pezzo di narrazione culturale: Questo l'ho menzionato prima—l'AI ha avuto difficoltà con la texture del tessuto. Il video finale ha utilizzato un mix di clip AI e modelli. Risultato onesto: accettabile, non straordinario.

Il blog di produzione video di Adobe ha un framework utile per pensare a quando gli strumenti assistiti da AI si adattano a una pipeline di produzione rispetto a quando non lo fanno—vale la pena leggerlo se stai decidendo quanto del tuo flusso di lavoro affidare alla generazione AI.

9. Suggerimenti che hanno effettivamente cambiato i miei risultati

I maggiori guadagni sono venuti dal cambiare input e processo, non dal passare più tempo all'interno dell'editor. Queste sono le regolazioni che hanno mosso l'ago per me specificamente:

- Scrivi prompt come liste di riprese — includi soggetto, movimento, illuminazione e angolo della fotocamera. Le parole di atmosfera da sole non funzionano.

- Pre-processa le immagini prima di caricarle — Ho usato GoEnhance AI per la nitidezza e l'upscaling, che ha migliorato visibilmente la qualità dell'esportazione 4K.

- Esegui sempre un'anteprima a bassa risoluzione — richiede 90 secondi, potenzialmente risparmia 10 minuti di credito di generazione.

- Non combattere l'AI sul movimento organico — se continua a sbagliare tessuto o capelli, sostituisci quel segmento con una clip modello e vai avanti.

- Tieni un file di swipe dei prompt che hanno funzionato — alla seconda settimana, avevo un set di 8–10 strutture di prompt che potevo adattare per quasi qualsiasi brief.

10. Conclusione: la mia opinione onesta dopo tre settimane

InVideo AI è lo strumento giusto se la velocità e il volume contano più per te della perfezione cinematografica—e per la maggior parte dei contenuti social e e-commerce, lo fanno.

Dopo tre settimane e circa 40 tentativi di generazione su diversi tipi di progetti, la mia opinione onesta è questa: non sostituirà un designer di movimento esperto per lavori ad alta produzione. Ma per la realtà quotidiana della produzione di contenuti—clip di prodotto, annunci social, varianti di marketing—risparmia davvero ore, e la qualità supera la soglia per la maggior parte delle piattaforme.

Il flusso di lavoro che consiglierei: pre-potenziare le immagini sorgenti, scrivere strutture di prompt strette, usare anteprime a bassa risoluzione in modo aggressivo e non cercare di usare la generazione AI per ogni segmento. Quella combinazione ha prodotto costantemente contenuti che potevo effettivamente spedire.

Se stai valutando se gli strumenti video AI si adattano al tuo flusso di lavoro di produzione, inizia da lì.