Revue du générateur vidéo InVideo AI : Mon expérience pratique après 3 semaines de test

- 1. À qui s'adresse cet avis

- 2. Ce qui rend InVideo AI différent des autres outils vidéo AI

- 3. Tester le générateur de texte à vidéo : ce que les invites ont réellement produit

- 4. Le flux de travail image à vidéo : là où InVideo vaut vraiment son prix

- 5. InVideo AI vs. Runway Gen-2, Kaiber et D-ID : une comparaison directe

- 6. Édition et ajustement : quel contrôle avez-vous réellement ?

- 7. Répartition des prix : ce que vous obtenez réellement à chaque niveau

- 8. Projets réels pour lesquels je l'ai utilisé (et les résultats réels)

- 9. Conseils qui ont réellement changé mes résultats

- 10. Conclusion : Mon avis honnête après trois semaines

1. À qui s'adresse cet avis

Si vous êtes créateur de contenu, vendeur en ligne ou marketeur qui doit produire rapidement de courtes vidéos—sans toucher à Premiere ou After Effects—InVideo AI mérite un examen sérieux. J'ai passé trois semaines à le tester : générer des démos de produits, des clips sociaux et des pièces de narration culturelle, puis comparer les résultats avec Runway Gen-2, Kaiber et D-ID. Voici ce que j'ai réellement trouvé, y compris là où cela m'a posé problème.

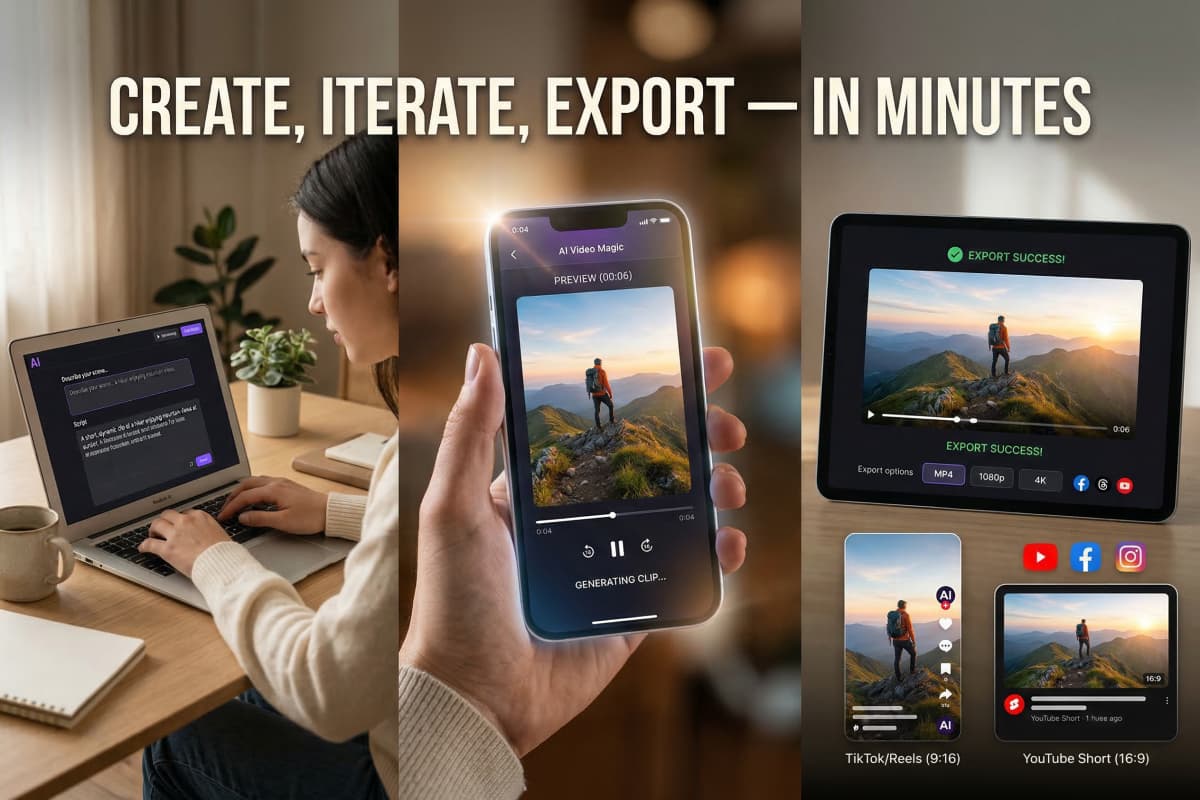

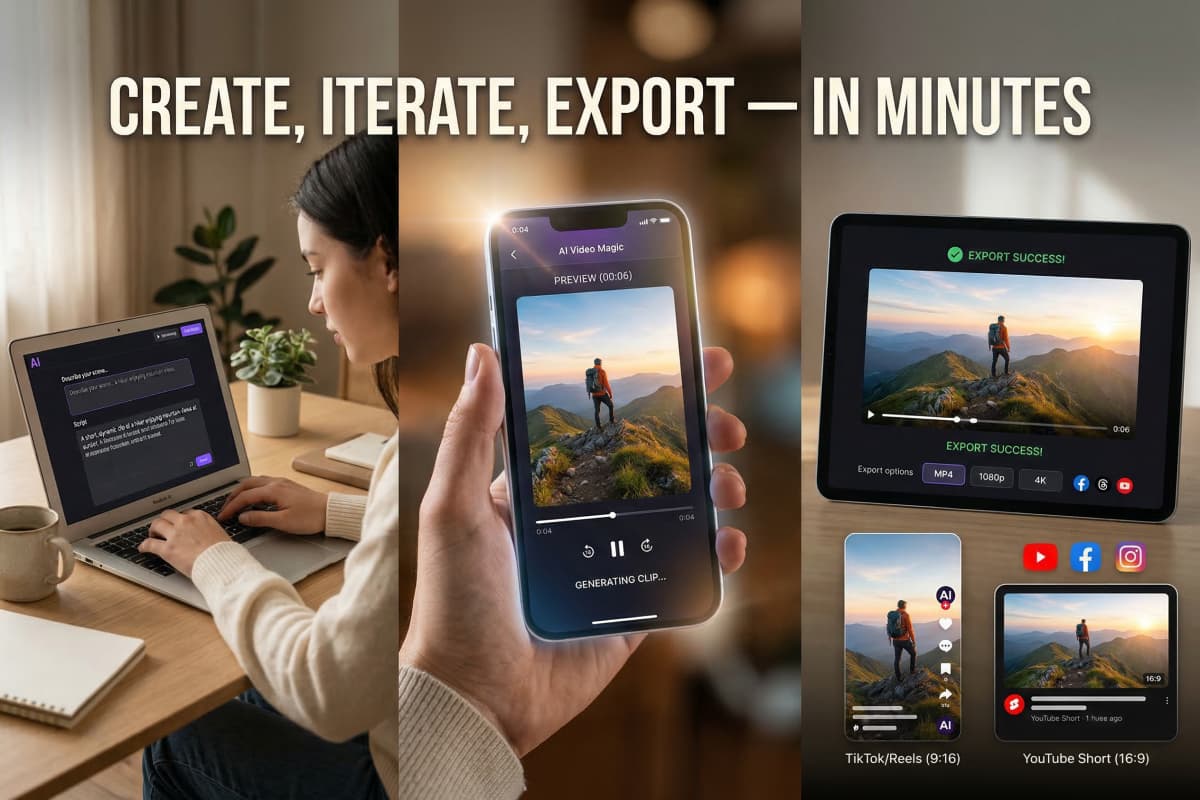

2. Ce qui rend InVideo AI différent des autres outils vidéo AI

Le véritable avantage d'InVideo AI n'est pas la qualité visuelle brute—c'est la rapidité du flux de travail complet de l'idée à l'exportation. La plupart des outils vidéo AI vous fournissent un clip et vous laissent vous débrouiller pour le reste. InVideo intègre génération, édition et modèles en une seule boucle, ce qui est crucial lorsque vous testez cinq variantes d'annonce sous pression.

Trois choses auxquelles je suis revenu sans cesse pendant les tests :

- Génération de texte à vidéo qui gère des invites de scène raisonnablement complexes sans assistance constante

- Animation d'image à vidéo qui produit des clips en mouvement utilisables en moins de 10 minutes

- Bibliothèque de modèles qui vous permet d'insérer des séquences générées par AI dans des mises en page pré-marquées au lieu de construire à partir de zéro

Aucun de ceux-ci n'est une première dans l'industrie. Mais avoir les trois dans une interface, sans courbe d'apprentissage abrupte, est plus rare que vous ne le pensez. Selon MIT Technology Review, la vague actuelle d'outils vidéo génératifs est encore fragmentée—la plupart excellent à un niveau de la pile, pas à l'ensemble du pipeline.

3. Tester le générateur de texte à vidéo : ce que les invites ont réellement produit

Des invites spécifiques et structurées m'ont donné des brouillons de qualité diffusion ; les vagues ont gaspillé des crédits. C'est la chose la plus importante que j'ai apprise en effectuant environ 40 tentatives de génération sur trois semaines.

J'ai testé trois types de projets réels :

-

Démonstration de produit e-commerce — Invite : "Flacon de soin de la peau rotatif à 360 degrés sur fond blanc, éclairage de studio doux, zoom arrière lent." Résultat : propre, utilisable dès le premier essai. J'ai utiliséles outils AI de texte à vidéo pour pré-optimiser mon flux de travail, ce qui a aidé à réduire les incohérences de génération dans l'exportation finale.

-

Clip teaser Instagram/TikTok — Coupes de 6 secondes pour une marque alimentaire. Le mouvement était légèrement exagéré au premier passage—plus une bande-annonce de blockbuster qu'un post produit. Il a fallu deux révisions d'invite pour le réduire.

-

Pièce de narration culturelle — Animation d'un produit textile traditionnel avec un mouvement cinématographique. C'est là que j'ai rencontré le plus gros obstacle : l'AI a mal interprété la texture du tissu et a généré une déformation irréaliste. J'ai fini par remplacer ce segment par un clip de modèle, ce qui a en fait sauvé la vidéo finale.

La conclusion : planifiez vos invites comme vous écririez une liste de plans, pas comme vous décririez une ambiance. Ce changement à lui seul a réduit mes générations échouées de plus de moitié.

4. Le flux de travail image à vidéo : là où InVideo vaut vraiment son prix

La fonctionnalité image à vidéo est la partie la plus fiable de la plateforme—et celle pour laquelle je paierais seule. Pour quiconque travaille avec la photographie de produit ou des actifs de marque statiques, ce flux de travail remplace ce qui prenait auparavant des heures dans After Effects.

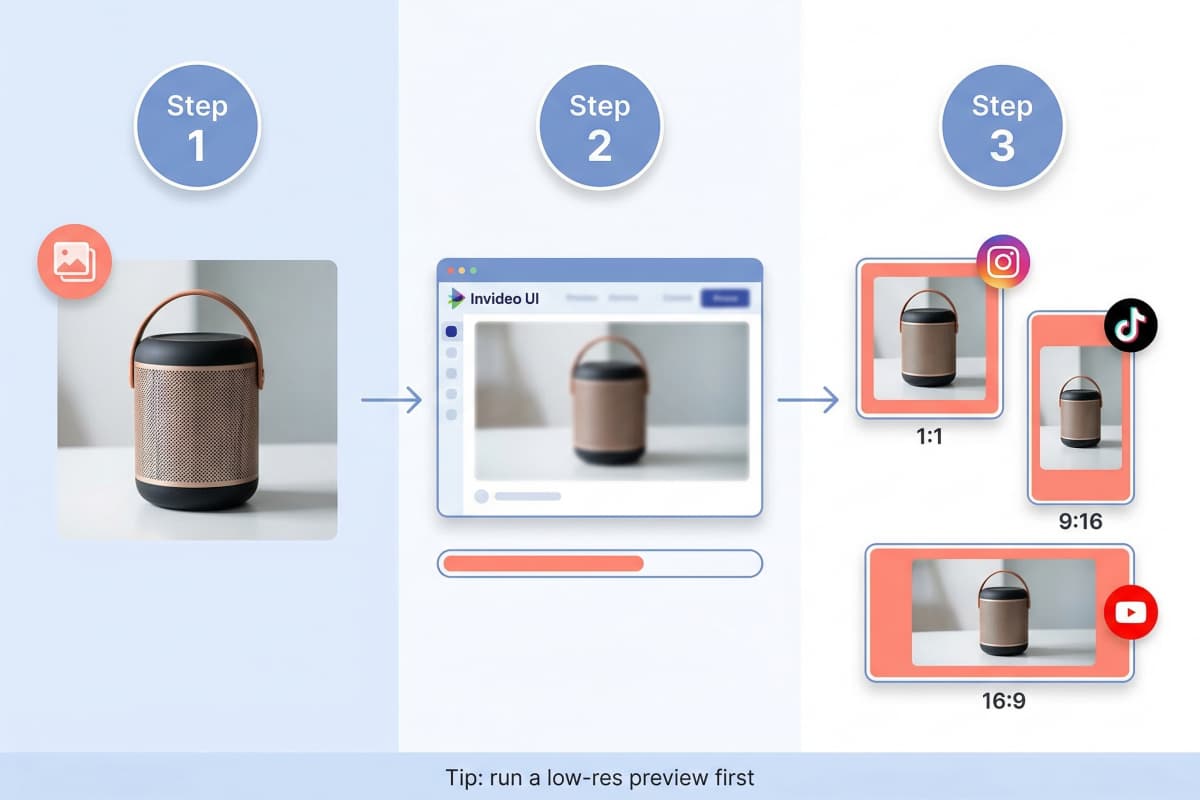

Mon processus standard pour une vidéo de produit :

- Pré-améliorer l'image source en utilisant les outils de générateur d'image à vidéo — cette étape a fait une différence mesurable dans la netteté de la sortie, surtout pour les exportations 4K

- Télécharger le fichier haute résolution sur InVideo

- Sélectionner le style d'animation — J'ai opté par défaut pour un zoom subtil pour le contenu produit et le parallaxe pour les images de style de vie

- Exécuter d'abord un aperçu basse résolution (économise des crédits et détecte les erreurs AI évidentes tôt)

- Ajuster le timing et l'échelle du mouvement, puis exporter en 1080p ou 4K

| Étape | Ce que j'ai réellement fait | Ce que je ferais différemment |

|---|---|---|

| Image source | Prise avec iPhone 14 Pro, 4K | Utiliser un appareil photo sans miroir pour les produits à texture lourde |

| Style d'animation | Zoom fluide pour la plupart des clips | Tester le parallaxe plus tôt—il a mieux performé que prévu |

| Résolution d'aperçu | Toujours exécuté en basse résolution d'abord | Pas de changements ici—cela seul m'a économisé ~20% de mes crédits |

| Exportation | 1080p pour les réseaux sociaux, 4K pour les livrables clients | — |

Une limitation honnête : si votre image source a un arrière-plan chargé, les artefacts de mouvement deviennent désordonnés. Les arrière-plans solides ou flous fonctionnent nettement mieux.

5. InVideo AI vs. Runway Gen-2, Kaiber et D-ID : une comparaison directe

InVideo gagne en vitesse de flux de travail et en flexibilité de modèle ; il perd en qualité de mouvement cinématographique. Après avoir exécuté des invites comparables sur les quatre plateformes, voici comment elles se comparent réellement pour le travail que je fais :

| Fonctionnalité | InVideo AI | Runway Gen-2 | Kaiber | D-ID Creative Reality Studio |

|---|---|---|---|---|

| Entrée principale | Texte & image | Vidéo / texte | Image & texte | Image & vidéo |

| Vitesse de génération | Très rapide (5–10 min) | Modérée (15–25 min) | Rapide | Modérée |

| Bibliothèque de modèles | ✅ Bibliothèque complète | Limitée | ❌ | ❌ |

| Contrôle du mouvement | Basique mais cohérent | Avancé | Bon contrôle stylisé | Limité |

| Là où il excelle réellement | Volume social & e-commerce | Conception de mouvement cinématographique | Clips d'art stylisés | Vidéos de tête parlante AI |

| Là où il est insuffisant | Mouvement organique complexe | Courbe d'apprentissage abrupte | Pas de support de modèle | Cas d'utilisation étroit |

Pour mon flux de travail—contenu social et e-commerce à haut volume—InVideo est l'outil approprié. Si je produisais un court métrage ou une vidéo de marque à haute production, je choisirais Runway. La couverture Forbes AI des outils vidéo génératifs fait un point similaire : les plateformes divergent fortement selon que la vitesse ou la qualité est la contrainte principale.

6. Édition et ajustement : quel contrôle avez-vous réellement ?

L'éditeur d'InVideo vous donne suffisamment de contrôle pour un contenu social de qualité professionnelle, mais atteint une limite sur les ajustements créatifs complexes. L'édition en langage naturel—où vous tapez quelque chose comme "rendre la transition plus lente" et il met à jour le clip—fonctionne mieux que je ne l'attendais pour les changements basiques. Elle s'effondre sur des demandes nuancées comme "appliquer cela uniquement à la troisième scène."

Ce qui a bien fonctionné dans mes éditions :

- Remplacer les segments générés par AI par des clips de modèle lorsque la génération a raté sa cible

- Ajuster le timing de la musique et le rythme des scènes via des commandes textuelles

- Changer les polices, les couleurs et les animations de texte sans toucher à une chronologie

Ce qui nécessitait des solutions de contournement :

- Le contrôle fin du mouvement sur des cadres spécifiques nécessitait encore une intervention manuelle

- L'éditeur en langage naturel réinterprétait parfois mes instructions et modifiait des choses que je n'avais pas demandé de toucher

Mon processus d'édition réel est devenu : générer → aperçu basse résolution → corriger les un ou deux segments qui en ont besoin → exportation finale. Cette boucle s'exécutait en environ 25–35 minutes pour un clip de 30 secondes, ce qui est suffisamment rapide pour le volume que je produisais.

7. Répartition des prix : ce que vous obtenez réellement à chaque niveau

Le niveau gratuit n'est utile que pour l'évaluation—si vous produisez du contenu à un volume réel, vous aurez besoin d'un plan payant dès la première semaine. Voici ce que j'ai trouvé après avoir analysé les chiffres sur mon utilisation réelle :

- Niveau gratuit : ~10 minutes de génération totale, exportations filigranées. Bon pour tester si l'outil s'adapte à votre flux de travail, pas beaucoup plus.

- Niveau payant d'entrée (~70€) : 2 minutes de vidéo générée par AI. Pour contexte, un clip de 30 secondes en haute qualité utilise environ 0,5–1 minute de temps de génération, donc cela couvre une petite campagne.

- Niveau payant intermédiaire (~130€) : 16 minutes de vidéo AI. C'est là que cela commence à avoir du sens pour une production de contenu cohérente.

- Qualité d'exportation : 1080p inclus sur les plans payants ; 4K nécessite un abonnement de niveau supérieur.

Pour le contexte sur ce que coûte réellement le marketing vidéo par rapport aux outils de production DIY, les statistiques marketing de HubSpot décomposent les coûts moyens de production vidéo par canal—les prix d'InVideo semblent compétitifs même par rapport aux tarifs freelance de milieu de gamme.

Une chose que je signalerais : les crédits s'épuisent plus vite que vous ne le pensez lorsque vous itérez. Exécuter des aperçus basse résolution avant de s'engager dans une exportation complète est la meilleure habitude pour gérer votre allocation mensuelle.

8. Projets réels pour lesquels je l'ai utilisé (et les résultats réels)

InVideo a livré la valeur la plus mesurable sur du contenu à court format et à haut volume—pas sur des vidéos héroïques polies. Voici ce que j'ai réellement produit et ce qui s'est passé :

- Boucles de produits e-commerce (3–6 secondes) : Généré 12 variantes pour un seul produit en un après-midi. Trois d'entre elles sont passées directement dans des publicités payantes sans autre édition. Auparavant, cela aurait pris deux jours de travail manuel.

- Reels Instagram pour un client alimentaire : Utilisé le flux de travail image à vidéo sur la photographie alimentaire existante. Le client a approuvé dès la première révision—ce qui n'arrive pas souvent.

- Créatifs de test A/B pour une campagne marketing : Créé 8 variantes du même concept en moins de deux heures. La variante gagnante a surperformé le contrôle par une marge qui a satisfait le client.

- Pièce de narration culturelle : Celle-ci que j'ai mentionnée plus tôt—l'AI a eu du mal avec la texture du tissu. La vidéo finale a utilisé un mélange de clips AI et de modèles. Résultat honnête : acceptable, pas remarquable.

Le blog de production vidéo Adobe propose un cadre utile pour réfléchir à quand les outils assistés par AI s'intègrent dans un pipeline de production par rapport à quand ils ne le font pas—à lire si vous décidez combien de votre flux de travail confier à la génération AI.

9. Conseils qui ont réellement changé mes résultats

Les plus grands gains sont venus de la modification des entrées et du processus, pas de passer plus de temps dans l'éditeur. Voici les ajustements qui ont fait la différence pour moi spécifiquement :

- Écrire des invites comme des listes de plans — inclure le sujet, le mouvement, l'éclairage et l'angle de la caméra. Les mots d'ambiance seuls ne fonctionnent pas.

- Pré-traiter les images avant de les télécharger — J'ai utilisé GoEnhance AI pour le renforcement et la mise à l'échelle, ce qui a nettement amélioré la qualité d'exportation 4K.

- Toujours exécuter un aperçu basse résolution — prend 90 secondes, peut potentiellement économiser 10 minutes de crédit de génération.

- Ne pas lutter contre l'AI sur le mouvement organique — si elle continue à mal interpréter le tissu ou les cheveux, remplacer ce segment par un clip de modèle et passer à autre chose.

- Garder un fichier de balayage des invites qui ont fonctionné — à la deuxième semaine, j'avais un ensemble de 8–10 structures d'invite que je pouvais adapter pour presque n'importe quel brief.

10. Conclusion : Mon avis honnête après trois semaines

InVideo AI est l'outil approprié si la vitesse et le volume comptent plus pour vous que la perfection cinématographique—et pour la plupart des contenus sociaux et e-commerce, c'est le cas.

Après trois semaines et environ 40 tentatives de génération sur plusieurs types de projets, mon avis honnête est le suivant : il ne remplacera pas un designer de mouvement qualifié pour un travail de haute production. Mais pour la réalité quotidienne de la production de contenu—clips de produits, publicités sociales, variantes marketing—il économise réellement des heures, et la qualité atteint le seuil pour la plupart des plateformes.

Le flux de travail que je recommanderais : pré-améliorer les images sources, écrire des structures d'invite serrées, utiliser agressivement les aperçus basse résolution, et ne pas essayer d'utiliser la génération AI pour chaque segment. Cette combinaison a systématiquement produit du contenu que je pouvais réellement livrer.

Si vous évaluez si les outils vidéo AI s'intègrent dans votre flux de production, commencez par là.