Ich habe Higgsfield AI getestet – Filmische Steuerung, nicht für jeden

- 1. Higgsfield AI Bewertungen in einem Satz: Für wen es ist (und wer es überspringen sollte)

- 2. Higgsfield AI Bewertungen: Die Plattformstruktur (Was man tatsächlich klickt, in menschlichen Worten)

- 3. Modelle: Warum Modelauswahl nicht optional ist

- 4. Kamerasprache: Cinema Studio und „Regie führen" ändern tatsächlich Ergebnisse

- 5. Bewegungssteuerung: Großartig, wenn man ihre Grenzen kennt

- 6. Charakter- und sprechende Avatare: Überraschend praktisch für Langform

- 7. Visuelle Effekte und Mixed Media: Der schnellste Weg zu etwas Teilbarem

- 8. Preise und Vertrauenssignale: Was ich prüfe, bevor ich Credits ausgebe

- 9. Mein „Ship It"-Workflow (Der Teil, den die meisten Higgsfield Bewertungen nicht erläutern)

- 10. Higgsfield AI Bewertungen: Was ich nicht mochte (und die Lösungen, die ich tatsächlich nutzte)

- 11. Mehr Power beim KI-Generator? Probieren Sie GoEnhance AI!

- 12. Fazit: Mein abschließendes Higgsfield AI Bewertungsurteil (und wem ich es empfehle)

Higgsfield AI Bewertungen spalten die Nutzer meist in zwei Lager: diejenigen, die die „Regisseur-artigen" Steuerungen lieben, und diejenigen, die am Kreditsystem oder an der Lernkurve scheitern. Nachdem ich es so benutzt habe, wie ich ein echtes Produktionstool verwenden würde (nicht nur ein „Prompt tippen → beten"-Spielzeug), ist mein Fazit einfach: Higgsfield ist am stärksten, wenn Sie es als Workflow-Zentrale behandeln – Modelle + Kamerasprache + wiederholbare Voreinstellungen – und nicht als einzelnen Zauberknopf. Higgsfield AI Video

Ich schreibe diesen Higgsfield AI Bewertungspost genauso, wie ich jede Erstellungsplattform teste: Ich starte mit dem schnellsten Weg zu einem brauchbaren Clip, teste dann intensiv die Controls, die behaupten, es „filmisch" zu machen, und überprüfe schließlich, ob die Plattform mir tatsächlich hilft, Inhalte schneller zu liefern (oder mir nur mehr Regler gibt). Außerdem habe ich ein kurzes Notizprotokoll geführt, um ehrlich bleiben zu können, was sich großartig angefühlt hat und was unordentlich war.

1. Higgsfield AI Bewertungen in einem Satz: Für wen es ist (und wer es überspringen sollte)

Wenn Sie einen Ort wollen, um mehrere Top-Video-Modelle zu testen und Shots mit Kamera-/Bewegungs-Tools zu steuern, lohnt sich Higgsfield; wenn Sie günstige, unbegrenzte Experimente ohne Reibung möchten, werden Sie genervt sein. Videos erstellen mit Kling, Veo, Sora & mehr

Hier ist das mentale Modell, das bei mir alles zum Klicken brachte: Higgsfield verkauft nicht „ein Modell, um sie alle zu beherrschen." Es bietet einen produktionähnlichen Workspace, in dem man einen Workflow wählt, ihn mit einem Modell kombiniert und die Bewegung steuert – eher wie ein Shot als „einen Clip generieren".

Wo ich es wirklich gut fand

- Zwischen mehreren führenden Video-Modellen wechseln ohne die Plattform zu verlassen.

- Eine strukturierte „schnell Inhalte machen" Denkweise, die öffentlich als Umwandlung grober Absicht in einen klareren Plan vor der Generierung beschrieben wurde.

Wann ich es überspringen würde

- Wenn Sie kreditbasierte kreative Tools hassen (Sie spüren jede Wiederholung).

- Wenn Sie hauptsächlich statische Bilder wollen und nur gelegentlich einen kurzen Clip.

- Wenn Sie ein einzelnes „bestes Antwort"-Modell wollen und sich nicht für Output-Vergleich interessieren.

2. Higgsfield AI Bewertungen: Die Plattformstruktur (Was man tatsächlich klickt, in menschlichen Worten)

Higgsfields Struktur ist seine Geheimwaffe: Es trennt „Workflow wählen" von „Modell wählen", womit verhindert wird, dass ein Tool alles erledigen soll.

Die meisten Tools werfen Sie einfach in ein Prompt-Feld. Higgsfield bewegt Sie in Bahnen – Videoerstellung, filmische Steuerung, Bewegungssteuerung, Effekte und charakterorientierte Workflows – damit Sie einfach anfangen und Kontrolle erst bei Bedarf hinzufügen können.

Die „Hub"-Idee (Warum das Layout wichtig ist)

Für mich löste das Layout ein echtes Problem: Ich musste nicht fünf verschiedene Websites neu lernen, nur um Outputs zu vergleichen. Wenn ein Prompt zu 80 % passte, die Bewegung aber seltsam war, konnte ich die gleiche Idee bei einem anderen Modell versuchen und die Shot-Logik behalten.

Hier eine kurze Karte, wie ich es nutzte:

| Was ich machen wollte | Wo ich gestartet habe | Was ich änderte, wenn es nicht passte | Warum es half |

|---|---|---|---|

| Produkt-artiger kurzer Clip | Multi-Modell Video-Workflow | Straffere Kamerabewegung + einfachere Szene | Weniger „zufällige" Ergebnisse AI Video |

| Charakter-Clip mit lesbarer Bewegung | Bewegungssteuerung | Bewegungskomplexität reduziert | Weniger Flimmer + Drift Bewegungssteuerung |

| Stilgetriebener Social Post | Mixed Media / Effekte | Voreinstellung gewählt statt Prompt umgeschrieben | Schneller zu „benutzbar" Mixed Media |

3. Modelle: Warum Modelauswahl nicht optional ist

Higgsfield ist am wertvollsten, wenn Sie Modelle wie Motoren behandeln, die Sie je nach Shot tauschen, weil die Plattform für Wechsel und Vergleich gebaut ist.

Auf Higgsfields AI Video-Seite wird hervorgehoben, dass man Zugriff auf mehrere Videomodelle in einem Workspace hat, mit der Möglichkeit zu wechseln und Ergebnisse zu vergleichen. Das ist wichtig, weil reale Outputs variieren: Ein Modell trifft die Bewegung genau, driftet aber bei Gesichtern, ein anderes bewahrt Identität, sieht aber steif aus.

Meine praktische Regel:

- Wenn der Shot klare Bewegung braucht, starten Sie mit einem bewegungszuverlässigen Modell.

- Wenn der Shot hochwertigen Realismus verlangt, probieren Sie die photorealistischen Optionen.

- Wenn der Shot Multi-Shot / filmische Sequenzen erfordert, testen Sie die Model- + Workflow-Kombi, die dafür gebaut ist.

4. Kamerasprache: Cinema Studio und „Regie führen" ändern tatsächlich Ergebnisse

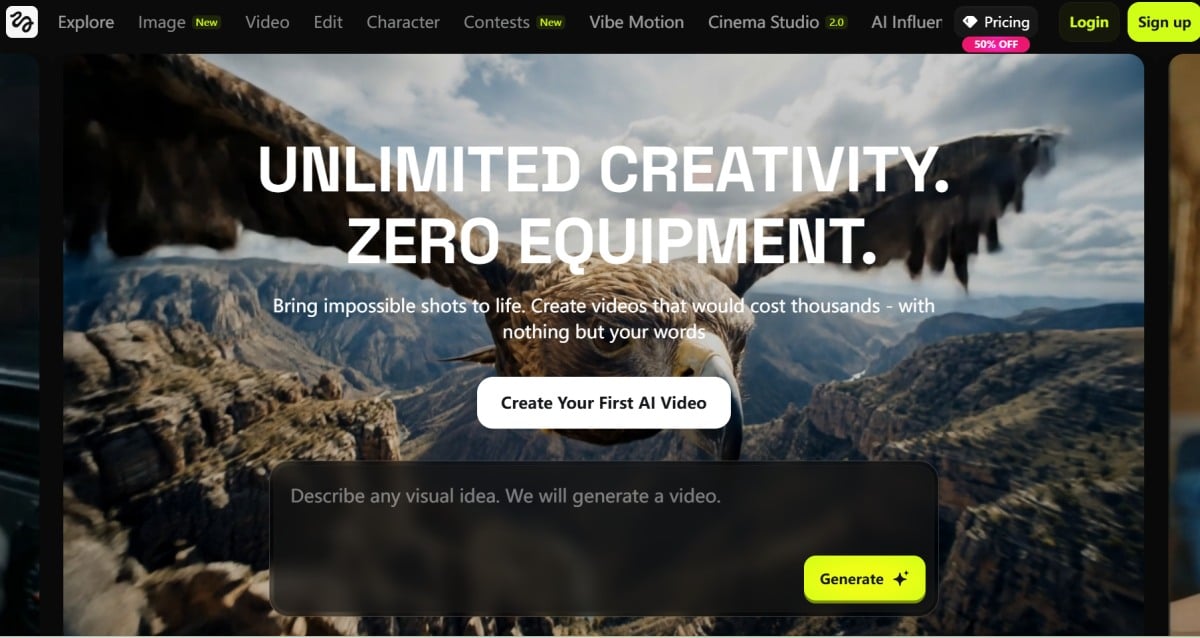

Die filmischen Tools sind wichtig, weil sie das Prompt-Glücksspiel verringern – Sie können Bewegung wie eine Aufnahme gestalten, statt darauf zu hoffen, dass das Modell Ihren Plan errät. Higgsfield Cinema Studio

An diesem Punkt fühlt sich Higgsfield weniger wie ein Spielzeug und mehr wie ein Workflow an. Sobald ich aufhörte, lange Prompts zu schreiben, und klarere Anweisungen gab, stieg die Trefferquote:

- Eine Kamerabewegung (nicht drei)

- Ein Motiv (kein Menschenauflauf)

- Eine Lichtstimmung (nicht „filmisch + neon + Sonnenuntergang + Noir" auf einmal)

Wenn Sie die „offizielle" Erklärung wollen, was Cinema Studio erreichen soll (über Marketing hinaus), ist deren Anleitung hilfreicher Kontext: Cinema Studio 2.0 Anleitung

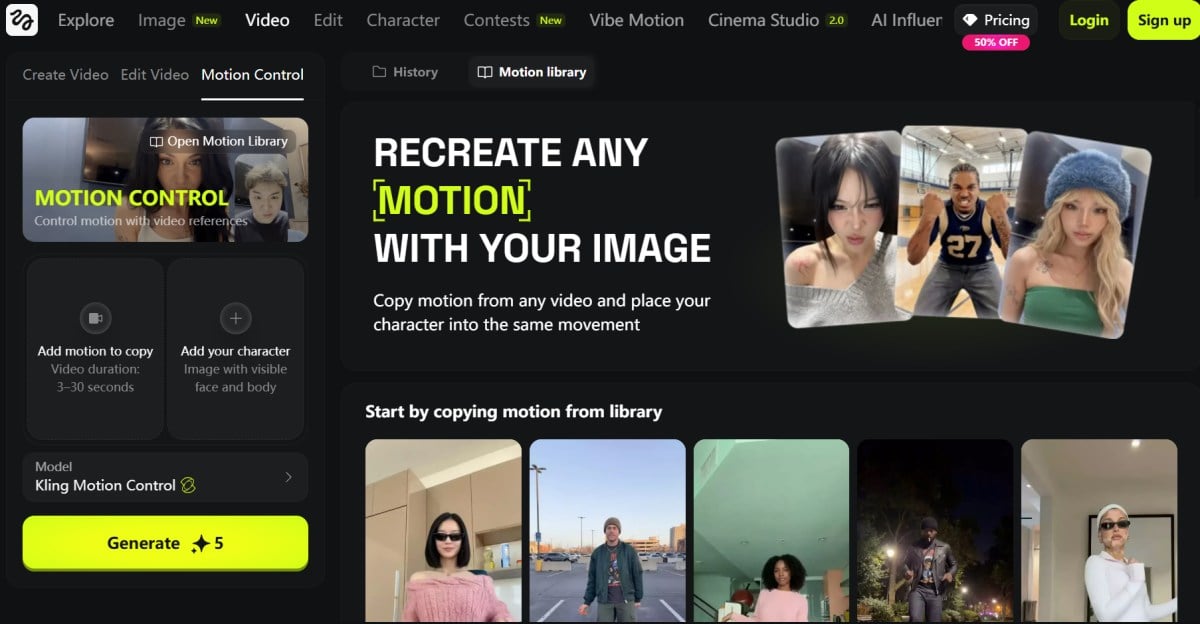

5. Bewegungssteuerung: Großartig, wenn man ihre Grenzen kennt

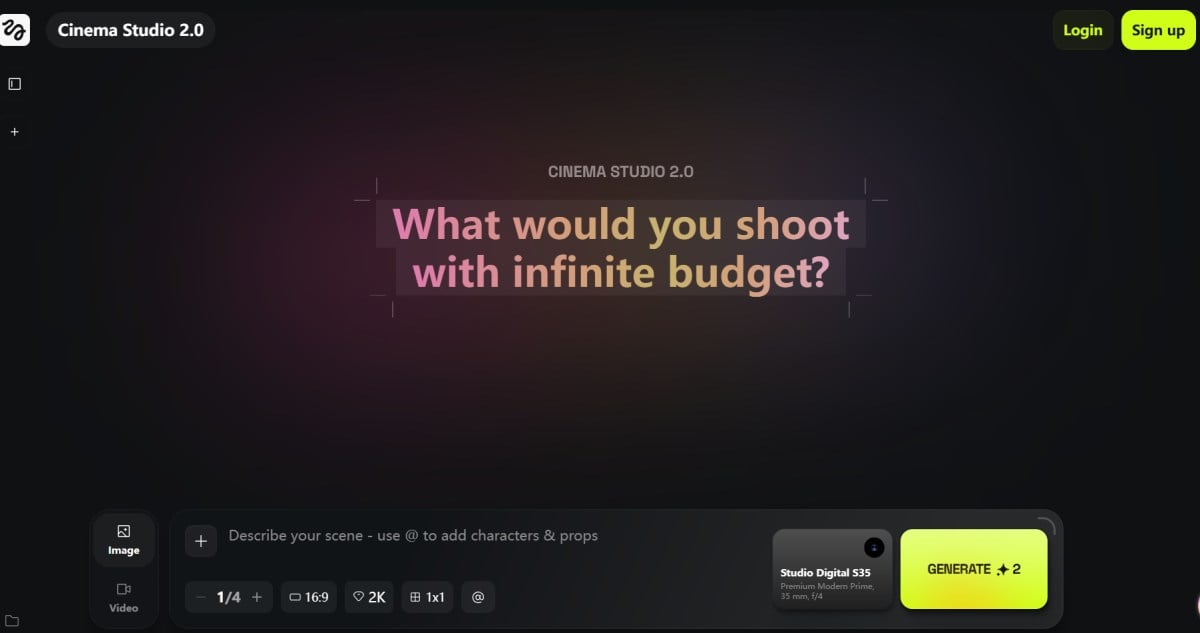

Bewegungssteuerung ist wirklich nützlich, um Aktionen zu choreografieren, bestraft aber unordentliche Eingaben und zu ambitionierte Bewegungen.

Auf Higgsfield wird Bewegungssteuerung als präzise Kontrolle von Charakteraktionen und -ausdrücken (mit Video-Referenzen) positioniert. In der Praxis behandelte ich es wie das Blocken einer Szene: Bewegungen lesbar halten, keine Mikro-Aktionen stapeln, und keine überfüllten Hintergründe.

Meine „Stabil halten"-Checkliste

- Nutzen Sie ein klares Motiv (besonders bei Gesichts-/Gestenarbeit).

- Vermeiden Sie schwere Verdeckungen (Hände vor Gesichtern, extreme Blickwinkel).

- Reduzieren Sie vor dem Stil hinzugeben die Aktionskomplexität.

6. Charakter- und sprechende Avatare: Überraschend praktisch für Langform

Wenn Sie sprechende Performances brauchen, kann Higgsfields Avatar-Workflow Zeit sparen – wenn Ihre Eingaben sauber und Erwartungen realistisch sind.

Hier wurde meine „Higgsfield Bewertungen"-Meinung praxisorientierter als ästhetisch: Avatar-Workflows sind nicht für einen perfekten Clip, sondern für wiederholbare Lieferung. Wenn ich saubere, frontale Bilder und guten Ton nutzte, wurde das Ergebnis zu einer nützlichen Pipeline für Erklärvideos, UGC-Style Werbung oder Mehrsprachenvarianten.

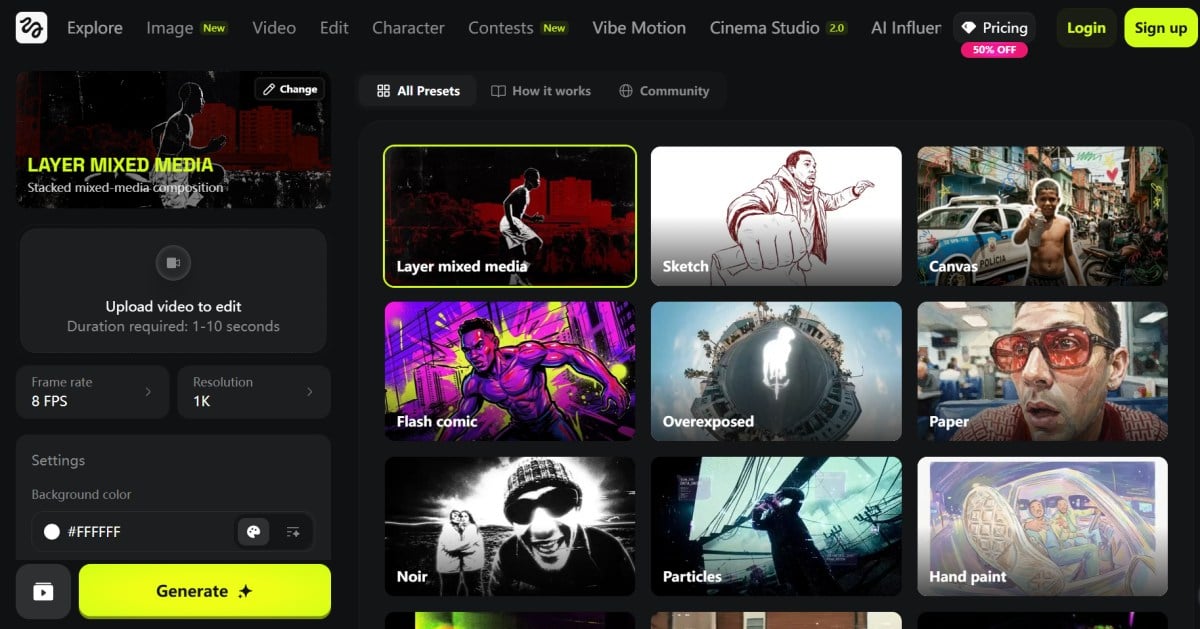

7. Visuelle Effekte und Mixed Media: Der schnellste Weg zu etwas Teilbarem

Higgsfields Effekte- und Mixed Media-Voreinstellungen sind der schnellste Weg zu „post-fertigen" Vibes, ohne den ganzen Tag Prompts neu schreiben zu müssen.

Wenn ich sofort Ergebnisse brauchte (kein perfekter Filmschuss), setzte ich auf Voreinstellungen. Das ist der ehrliche Wert: Sie bekommen eine Bibliothek, die einen guten Basisclip in etwas wandelbarem, stilisierten und absichtlich wirkendem verwandelt.

Zwei interessante Einstiegspunkte:

- Effekte-Bibliothek: Effekte Sammlung

- Mixed Media Bibliothek: Mixed Media

Ein einfacher Workflow, der für mich funktionierte:

- Erstelle einen einfachen, sauberen Clip.

- Wende einen Effekt- oder Mixed Media-Voreinstellung an.

- Exportiere, dann entscheide, ob er veröffentlichungsfähig ist oder einen zweiten Durchgang braucht.

8. Preise und Vertrauenssignale: Was ich prüfe, bevor ich Credits ausgebe

Higgsfield kann großartig sein, aber Sie sollten es wie ein Produktionsbudget-Tool behandeln – Tests planen, Credits verfolgen und externe Signale prüfen, bevor Sie skalieren.

Ich versuche nicht, Ihre Preissensitivität zu erraten, das ist persönlich. Stattdessen suche ich nach Mustern: Sind Nutzer überrascht von der Abrechnung? Fühlen sie sich vom Support gut betreut? Erwähnen sie Instabilität oder Wartezeiten?

Hier sind Referenzen, die ich kurz überfliegen würde (nicht als Gesetz, sondern als Musterfinder): Trustpilot: higgsfield.ai

9. Mein „Ship It"-Workflow (Der Teil, den die meisten Higgsfield Bewertungen nicht erläutern)

Der schnellste Weg, mit Higgsfield zu gewinnen, ist es wie ein Mini-Studio zu betreiben: eine Idee, drei kontrollierte Variationen, dann nehme den besten Take.

Hier der Loop, den ich nutze, wenn ich etwas Veröffentlichbares möchte:

- Skizziere den Shot in einfachem Deutsch (was passiert, wie die Kamera sich bewegt, welche Stimmung herrscht).

- Generiere drei Variationen mit kleinen, gezielten Unterschieden (Kamerabewegungsintensität, Hintergrundsimplicity, Bewegungskomplexität).

- Wähle den besten Take, dann erst dann wende Stil/Effekt an.

Wenn ich Inhalte baue, die online bleiben sollen, habe ich auch eine parallele Pipeline, die nicht von einem Tool abhängt. Wenn ich schnell ein sauberes webfreundliches Ergebnis brauche, nutze ich manchmal zuerst Bild-zu-Video und entscheide dann, ob ein „filmischer" Durchgang lohnt.

Und wenn ich organisiere, was geht live und was experimentell bleibt, mag ich eine stabile Heimatbasis – meine ist GoEnhance AI.

10. Higgsfield AI Bewertungen: Was ich nicht mochte (und die Lösungen, die ich tatsächlich nutzte)

Higgsfield ist mächtig, aber Druck durch Credits und Modell-übergreifende Inkonsistenz sind zwei Nachteile, die man einplanen muss – sonst kann die Erfahrung eher frustrierend als „filmisch" sein.

Ich hebe das hervor, weil es die Probleme sind, die ich immer wieder bei realem Creator-Testen traf: Mehrfache Iterationen, verschiedene Modelle und ein „ship it"-Deadline.

Die Hauptnachteile (einfach gesagt)

- Kreditbasierte Iterationen können Ihr Verhalten verändern. Ich habe mich dabei erwischt, wie ich zögerte, erneut zu generieren, obwohl ich wusste, dass ein zweiter Take wahrscheinlich besser wäre.

- Die Benutzeroberfläche ist reichhaltig, aber nicht sofort selbsterklärend. Viele Bahnen (Modelle, Cinema Studio, Motion Control, Effekte, Avatare), und die erste Stunde kann sich wie Cockpit-Lernen anfühlen.

- Gleicher Prompt, anderes Modell, andere Realität. Der Vorteil ist Wahl – der Nachteil ist, man muss eine Auswahlroutine aufbauen.

- Spitzenzeiten-Verlangsamung kann den Schwung zerstören. Wenn eine Generierung scheitert oder länger als erwartet wartet, können die Zeitkosten schlimmer sein als die Credit-Kosten.

- Komplexe Kamera + komplexe Aktion erhöht das Artefaktrisiko. Je mehr Bewegungen und Mikroaktionen Sie stapeln, desto leichter entstehen Flimmern, Texturkriechen, seltsame Hände oder Kantenflackern.

Meine „Symptom → Beste Lösung" Tabelle

| Symptom, das ich sah | Wahrscheinliche Ursache | Die beste Lösung, die ich nutzte |

|---|---|---|

| Sieht cool aus, aber Motiv driftet | Zu komplexe Bewegung | Reduzieren auf eine Aktion + eine Kamerabewegung |

| Tolle Bewegung, weiche Details | Modellpräferenz passt nicht | Modell wechseln und Richtung exakt halten |

| Identität fühlt sich „falsch" an | Schwache Eingangsreferenz | Verwenden Sie ein saubereres, frontales Referenzbild |

| Clip wirkt zufällig | Prompt versucht alles gleichzeitig | Umschreiben als Shot: Motiv + Aktion + Kamera + Licht |

| Zu viele Versuche | Unfokussiertes Testen | 3 Variationen batchen, dann stoppen und auswählen |

11. Mehr Power beim KI-Generator? Probieren Sie GoEnhance AI!

Wenn Sie eine schnellere, creator-freundlichere Plattform wollen, die flexibel genug für Alltagsproduktion ist (nicht nur „filmische Experimente"), ist GoEnhance AI das Zentrum meines Workflows.

Wie gesagt, Higgsfield AI fühlt sich an wie ein Regie-Schreibtisch – großartig, wenn Sie eine spezielle „Aufnahme" jagen und sorgfältig iterieren wollen. Aber bei vielfältigen, hochvolumigen Projekten (Social Clips, Marketingassets, schnelle Tests, verschiedene Stile) will ich etwas, das schnell, flexibel und einfach wiederholbar bleibt.

Deshalb ist meine bessere Empfehlung GoEnhance AI. Im Alltag fühlt es sich wie ein All-in-One-Kreativ-Workspace an, gebaut fürs Liefern, nicht nur fürs Experimentieren. Es ist auch mein Startpunkt, wenn ich einen KI Video Generator brauche, der mich nicht gegen die Benutzeroberfläche kämpfen lässt, um saubere Ergebnisse zu erhalten.

Das Praktische daran ist, dass es über „einmal generieren und hoffen" hinausgeht. Ich kann von Idee → Entwurf → veröffentlichungsfähige Ausgabe mit weniger Umwegen arbeiten, egal ob Bildzentriertes Konzept, kurzer Clip oder schnelle Variation.

Ein großer Zeit-Sparer ist Bild zu Video. Ich kann ein einzelnes Standbild (Produktfoto, Charakterbild, Key Visual, sogar Rohdesign) in einen kurzen animierten Clip verwandeln, der schon „präsentabel" für Web, Anzeigen oder Social ist. Beim Aufbau einer Content-Pipeline ist das oft der Unterschied zwischen Versand heute oder ständiger Feinabstimmung über eine Woche.

Wenn ich visuell von Null starte, kombiniere ich gern mit einer KI-Bildgenerator-Mentalität: zuerst ein sauberes Hero-Still generieren, dann das beste Bild animieren. So bleibt alles konsistent und Iterationen wirken gezielt statt zufällig.

Was GoEnhance AI für mich wirklich unterscheidet, ist die einfache Skalierung der Qualität bei Bedarf. Will ich hochwertige Outputs oder eine bestimmte „Modell-Persönlichkeit", kann ich gezielt Modellseiten nutzen statt zu raten:

- Für filmische, produktionelle Bewegungstests probiere ich Seedance 2.0.

- Wenn ich längere, erzählerisch freundliche Clips mit starkem Rhythmus will, teste ich Vidu Q3.

- Und wenn ich diesen klaren, kontrollierten Look suche, der auch bei näherer Betrachtung überzeugt, checke ich Kling O3.

Was GoEnhance AI besser für diverse Projekte macht:

- Workflow-zentrierte Erfahrung: Ich iteriere schnell, vergleiche Outputs und halte das Momentum ohne jede Sitzung schwer zu machen.

- Vielfalt bei Stilen: Wenn ich die Stimmung wechsle – sauber, filmisch, stilisiert, verspielt – muss ich nicht alles neu aufbauen.

- Veröffentlichungsfreundliche Ergebnisse: Die Ausgaben passen leichter zu Landingpages, Kurzform-Inhalten und Marketing-Pipelines.

Wenn Higgsfield mein Ort ist, um einen „Shot zu regie führen", ist GoEnhance AI mein Ort, um konsequent zu produzieren – und kreative Projekte voranzubringen, ohne sich in endlosen Wiederholungen zu verheddern.

12. Fazit: Mein abschließendes Higgsfield AI Bewertungsurteil (und wem ich es empfehle)

Mein abschließendes Higgsfield AI Urteil ist, dass es ein starker kreativer Workspace ist, wenn Sie Ihre Generierungen wie Shots planen, aber ein frustrierender Spielplatz, wenn Sie nur endlos wiederholen wollen. OpenAI Fallstudie

Wenn ich es in einem Satz zusammenfassen müsste: Behandeln Sie Higgsfield wie ein Studio, nicht wie einen Spielautomaten. Wählen Sie zuerst den Workflow, halten Sie Ihre Regieanweisungen einfach, tauschen Sie Modelle gezielt und Sie erhalten deutlich vorhersehbarere Ergebnisse.

Und für alle, die breitere Higgsfield Bewertungen suchen: Suchen Sie Tester, die ihre Iterationsmethode zeigen, nicht nur ausgewählte Outputs. Das zeigt Ihnen, ob das Tool zu Ihrer Geduld, Ihrem Budget und der Art „filmischer Kontrolle" passt, die Sie wirklich wollen.