Eu Avaliei o Higgsfield AI — Controle Cinematográfico, Não Para Todos

- 1. Avaliações do Higgsfield AI em uma frase: Para quem é (e quem deve evitar)

- 2. Avaliações do Higgsfield AI: A estrutura da plataforma (o que você realmente clica, em termos humanos)

- 3. Modelos: Por que a seleção do modelo não é opcional

- 4. Linguagem de câmera: Cinema Studio e "direção" realmente mudam os resultados

- 5. Controle de Movimento: ótimo quando você respeita os limites

- 6. Personagens e avatares falantes: surpreendentemente práticos para formatos longos

- 7. Efeitos Visuais e Mídia Mista: o caminho mais rápido para algo compartilhável

- 8. Preços e sinais de confiança: o que eu verifico antes de gastar créditos

- 9. Meu fluxo "envie já" (a parte que a maioria das avaliações do Higgsfield não explica)

- 10. Avaliações do Higgsfield AI: O que eu não gostei (e as correções que realmente usei)

- 11. Quer um gerador de IA mais poderoso? Experimente o GoEnhance AI!

- 12. Conclusão: Meu veredito final das avaliações do Higgsfield AI (e para quem eu recomendaria)

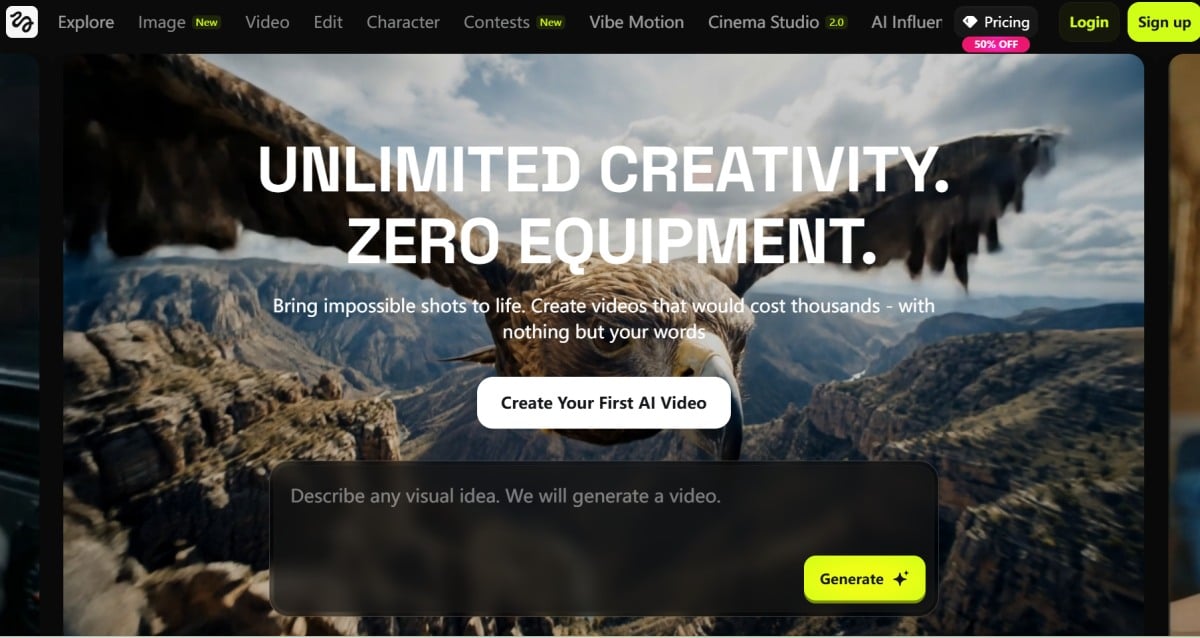

As avaliações do Higgsfield AI tendem a dividir as pessoas em dois grupos: aquelas que adoram os controles "no estilo diretor" e aquelas que se frustram com o sistema de créditos ou a curva de aprendizado. Depois de usá-lo como eu usaria uma ferramenta de produção real (não apenas um brinquedo de "digitar prompt → rezar"), minha conclusão é simples: Higgsfield é mais forte quando você o trata como um hub de fluxo de trabalho — modelos + linguagem de câmera + presets repetíveis — em vez de um único botão mágico. Vídeo AI Higgsfield

Estou escrevendo esta avaliação do Higgsfield AI da mesma forma que testo qualquer plataforma de criação: começo pelo caminho mais rápido para um clipe utilizável, depois testo a fundo os controles que prometem torná-lo "cinematográfico" e, finalmente, verifico se a plataforma realmente me ajuda a entregar conteúdo mais rápido (ou se apenas me dá mais botões para mexer). Também mantive um registro rápido de anotações para ser honesto sobre o que funcionou bem e o que ficou confuso.

1. Avaliações do Higgsfield AI em uma frase: Para quem é (e quem deve evitar)

Se você quer um lugar para testar vários dos principais modelos de vídeo e direcionar cenas com ferramentas de câmera/movimento, o Higgsfield vale seu tempo; se você quer experimentação barata e ilimitada sem atrito, vai se frustrar. Crie vídeos com Kling, Veo, Sora e mais

Aqui está o modelo mental que me fez entender tudo: Higgsfield não está oferecendo "um modelo para governá-los todos". Ele oferece um espaço de trabalho parecido com uma produção onde você escolhe um fluxo de trabalho, combina com um modelo e direciona o movimento — mais como fazer uma cena do que "gerar um clipe".

No que eu achei que ele é realmente bom

- Trocar entre vários modelos de vídeo líderes sem sair da plataforma.

- Uma mentalidade estruturada de "criar conteúdo rápido" que foi descrita publicamente como transformar uma intenção bruta em um plano mais claro antes da geração.

Quando eu pularia

- Se você odeia ferramentas criativas baseadas em créditos (você vai sentir cada reroll).

- Se você quer principalmente imagens estáticas e só ocasionalmente um clipe curto.

- Se você quer um único modelo "melhor resposta" e não se importa em comparar resultados.

2. Avaliações do Higgsfield AI: A estrutura da plataforma (o que você realmente clica, em termos humanos)

A estrutura do Higgsfield é sua arma secreta: ela separa "escolher um fluxo de trabalho" de "escolher um modelo", o que evita que você force uma ferramenta a fazer tudo.

A maioria das ferramentas te manda direto para uma caixa de prompt. Higgsfield guia você por faixas — geração de vídeo, controles cinematográficos, controle de movimento, efeitos e fluxos de trabalho focados em personagens — para que você possa começar simples e adicionar controle só quando precisar.

A ideia do "Hub" (Por que o layout importa)

Para mim, o layout resolveu uma dor real: não precisei reaprender cinco sites diferentes só para comparar resultados. Se um prompt parecia 80% correto mas o movimento estava estranho, eu podia testar a mesma ideia em outro modelo e manter a lógica da cena consistente.

Aqui está um rápido mapa de como usei:

| O que eu tentava fazer | Onde comecei | O que mudei quando não deu certo | Por que ajudou |

|---|---|---|---|

| Clipe curto estilo produto | Fluxo multimodelo de vídeo | Movimento de câmera mais fechado + cena mais simples | Menos resultados "aleatórios" Vídeo AI |

| Clipe de personagem com movimento legível | Controle de Movimento | Reduzi a complexidade do movimento | Menos cintilação + deriva Controle de Movimento |

| Post social com estilo definido | Mídia Mista / Efeitos | Escolhi um preset em vez de reescrever prompts | Mais rápido para ficar "utilizável" Mídia Mista |

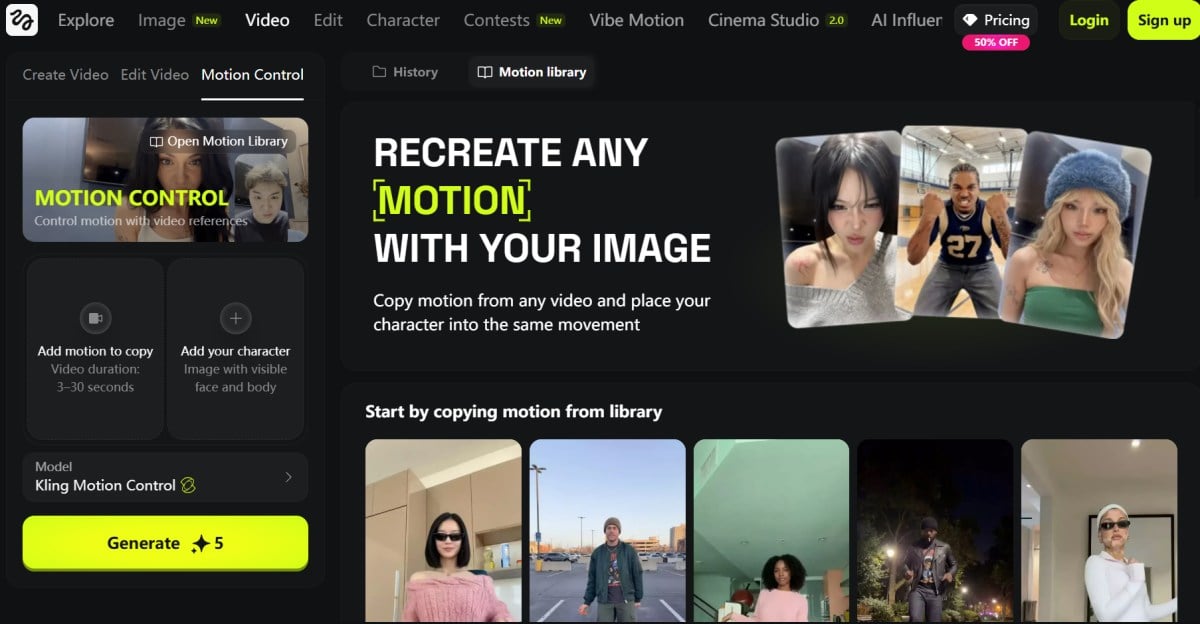

3. Modelos: Por que a seleção do modelo não é opcional

Higgsfield é mais valioso quando você trata os modelos como motores que troca conforme a cena, porque a plataforma é feita para alternar e comparar.

Na página de vídeo AI do Higgsfield, ele destaca o acesso a múltiplos modelos em um único espaço de trabalho, com a capacidade de trocar e comparar resultados. Isso importa porque as saídas reais variam: um modelo pode acertar o movimento mas falhar nos rostos, enquanto outro mantém a identidade mas fica rígido.

Minha regra prática:

- Se a cena precisa de forte legibilidade de movimento, comece com uma opção confiável para movimento.

- Se a cena precisa de realismo de alto nível, experimente as opções focadas em fotorrealismo.

- Se a cena precisa de sequência multi-take/cinematográfica, teste o combo modelo + fluxo de trabalho feito para isso.

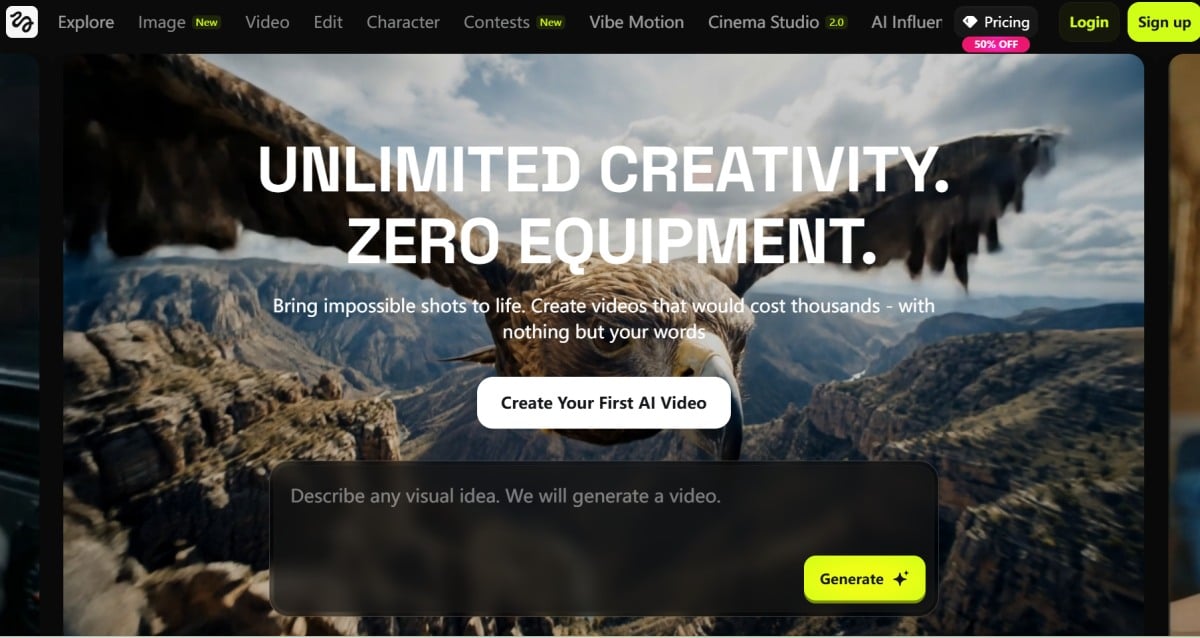

4. Linguagem de câmera: Cinema Studio e "direção" realmente mudam os resultados

As ferramentas cinematográficas importam porque reduzem a aposta no prompt — você pode moldar o movimento como uma cena em vez de esperar que o modelo adivinhe sua intenção. Cinema Studio Higgsfield

É aqui que o Higgsfield deixa de parecer um brinquedo e vira um fluxo de trabalho. Quando parei de escrever prompts longos e comecei a dar uma direção mais clara, minha taxa de acerto subiu:

- Um movimento de câmera (não três)

- Um sujeito (não uma multidão)

- Uma vibração de iluminação (não "cinematográfica + neon + pôr do sol + noir" tudo junto)

Se você quer a explicação "oficial" do que o Cinema Studio tenta alcançar (além do marketing), o guia deles é um contexto útil: Guia Cinema Studio 2.0

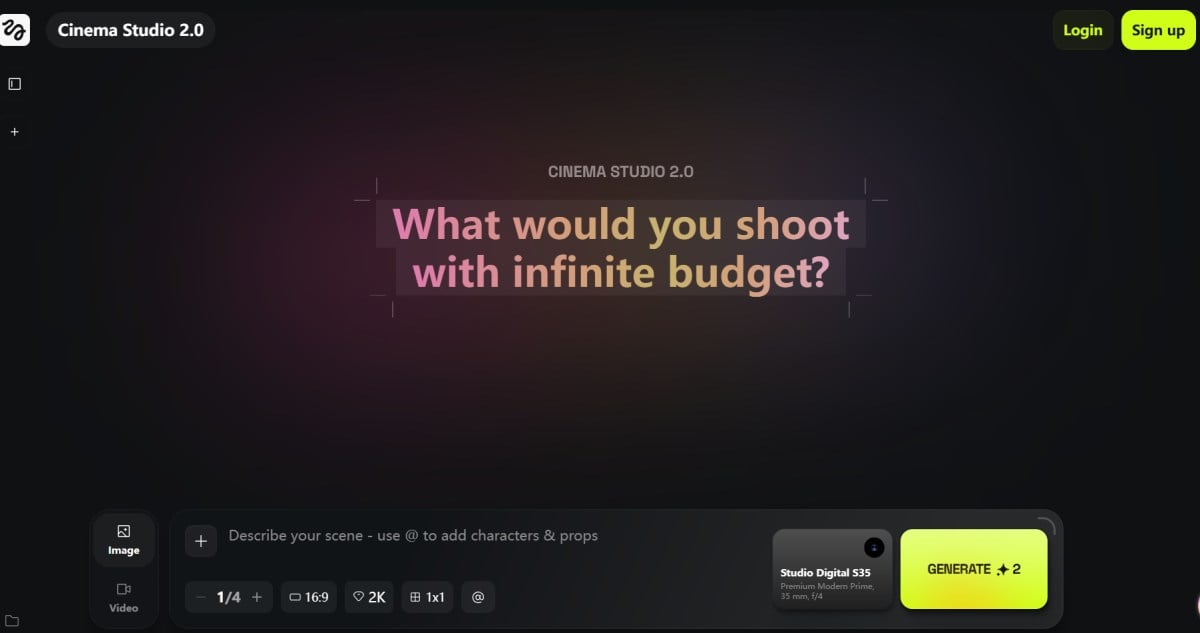

5. Controle de Movimento: ótimo quando você respeita os limites

O Controle de Movimento é realmente útil para coreografar ações, mas pune inputs confusos e movimentos ambiciosos demais.

No Higgsfield, o Controle de Movimento é posicionado como controle preciso das ações e expressões de personagens (com referências em vídeo). Na prática, tratei como bloquear uma cena: manter movimentos legíveis, não empilhar micro ações e evitar fundos poluídos.

Minha lista de "mantenha estável"

- Use um sujeito claro (especialmente para rosto/gestos).

- Evite oclusões pesadas (mãos cobrindo rostos, ângulos extremos).

- Reduza a complexidade da ação antes de adicionar estilo.

6. Personagens e avatares falantes: surpreendentemente práticos para formatos longos

Se você precisa de performance falada, o fluxo de trabalho de avatar do Higgsfield pode economizar tempo — quando seus inputs são claros e suas expectativas realistas.

Aqui minha opinião nas avaliações do Higgsfield ficou mais prática do que estética: fluxos de avatar não são sobre um clipe perfeito, são sobre entrega repetível. Quando usei imagens frontais limpas e áudio bom, a saída virou um pipeline útil para explicadores, anúncios estilo UGC ou variantes multilíngues.

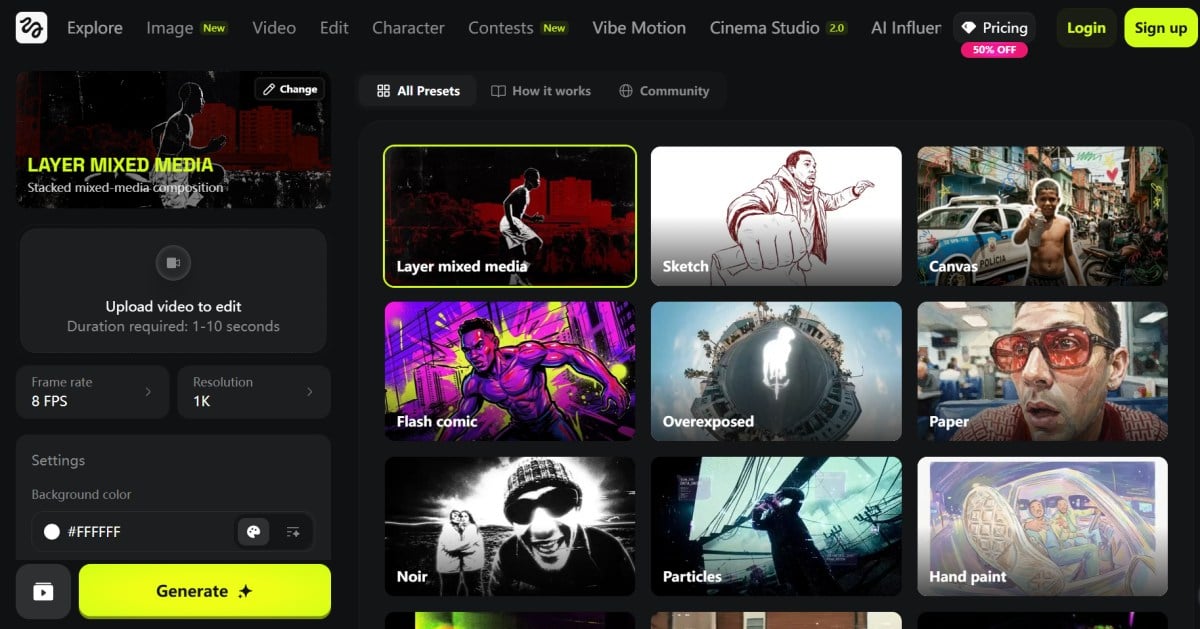

7. Efeitos Visuais e Mídia Mista: o caminho mais rápido para algo compartilhável

Os presets de Efeitos e Mídia Mista do Higgsfield são a forma mais rápida de ter uma vibe "pronta para publicação" sem reescrever prompts o dia todo.

Quando precisei de resultados imediatos (não uma cena perfeita de filme), me apoiei nos presets. Esse é o valor honesto: você tem uma biblioteca que transforma um clipe básico em algo que parece estilizado e intencional.

Dois pontos de entrada de recursos para adicionar aos favoritos:

- Biblioteca de Efeitos: Coleção de Efeitos

- Biblioteca de Mídia Mista: Mídia Mista

Um fluxo simples que funcionou para mim:

- Gere um clipe básico e limpo.

- Aplique um efeito ou preset de Mídia Mista.

- Exporte, depois decida se está publicável ou precisa de uma segunda rodada.

8. Preços e sinais de confiança: o que eu verifico antes de gastar créditos

Higgsfield pode ser ótimo, mas você deve tratá-lo como uma ferramenta orçamentária de produção — planeje testes, acompanhe créditos e cheque sinais externos antes de escalar.

Não tento "adivinhar" sua sensibilidade a preços, porque isso é pessoal. O que faço é buscar padrões: os usuários se surpreendem com a cobrança? Sentem que o suporte é responsivo? Comentam sobre instabilidade ou filas?

Aqui estão as referências que eu daria uma olhada (não como verdade absoluta, apenas para identificar padrões): Trustpilot: higgsfield.ai

9. Meu fluxo "envie já" (a parte que a maioria das avaliações do Higgsfield não explica)

A forma mais rápida de vencer com Higgsfield é usá-lo como um mini estúdio: uma ideia, três variantes controladas e depois escolha o melhor take.

Aqui está o ciclo que uso quando quero algo publicável:

- Esboce a cena em inglês simples (o que acontece, o que a câmera faz, qual o clima).

- Gere três variações com pequenas diferenças intencionais (intensidade do movimento de câmera, simplicidade do fundo, complexidade do movimento).

- Escolha o melhor take, só então aplique estilo/efeito.

Se estou criando conteúdo para um site, mantenho também um pipeline paralelo que não depende de uma única ferramenta. Quando preciso de um resultado limpo para web rapidamente, às vezes passo o conceito primeiro pelo imagem para vídeo, depois decido se merece um passe mais "cinematográfico".

E quando organizo o que vai para publicação vs. o que fica experimental, gosto de ter uma base estável — a minha é GoEnhance AI.

10. Avaliações do Higgsfield AI: O que eu não gostei (e as correções que realmente usei)

Higgsfield é poderoso, mas pressão de créditos e inconsistência entre modelos são os dois pontos que você precisa planejar para contornar — ou a experiência pode ser mais frustrante que "cinematográfica."

Desto isso porque foram os problemas que encontrei ao testar como um criador real: múltiplas iterações, múltiplos modelos e prazo de entrega.

Os principais pontos negativos (em linguagem simples)

- Iteração baseada em créditos pode mudar seu comportamento. Me peguei hesitando em rerollar mesmo sabendo que um segundo take provavelmente seria melhor.

- A interface é rica, mas não imediatamente óbvia. São muitas faixas (modelos, Cinema Studio, Controle de Movimento, Efeitos, avatares), a primeira hora pode parecer aprendizado em cockpit.

- Mesmo prompt, modelo diferente, realidade diferente. O lado bom é a escolha — o lado ruim é que você deve criar o hábito de selecionar.

- Lentidão em horários de pico pode quebrar a energia. Se uma geração falha ou fila demora mais que o esperado, o custo de tempo pode ser maior que o de créditos.

- Câmera complexa + ação complexa aumenta o risco de artefatos. Quanto mais você empilha movimentos e micro ações, mais fácil é causar cintilação, textura instável, mãos estranhas ou tremores de borda.

Minha tabela "Sintoma → Melhor correção"

| Sintoma que vi | Causa provável | A melhor correção que usei |

|---|---|---|

| Parece legal, mas o sujeito deriva | complexidade excessiva de movimento | reduza para uma ação + um movimento de câmera |

| Movimento ótimo, detalhes suaves | incompatibilidade de preferência do modelo | troque de modelo mantendo a direção idêntica |

| Identidade parece "errada" | referência de input fraca | use uma imagem frontal e mais limpa como referência |

| Clipe parece aleatório | o prompt tenta fazer tudo | reescreva como uma cena: sujeito + ação + câmera + iluminação |

| Tantas tentativas | testes sem foco | gere 3 variações por lote, pare e escolha |

11. Quer um gerador de IA mais poderoso? Experimente o GoEnhance AI!

Se você quer uma plataforma mais rápida, amigável para criadores e flexível para produção diária (não só "experimentos cinematográficos"), o GoEnhance AI é o que eu colocaria no centro do meu fluxo de trabalho.

Como disse, o Higgsfield AI pode parecer uma mesa de diretor — incrível quando você está buscando uma cena específica e disposto a iterar com cuidado. Mas quando trabalho em projetos mais variados e de alto volume (clips sociais, ativos de marketing, testes rápidos, estilos diferentes), quero algo que seja rápido, flexível e fácil de repetir.

Por isso minha sugestão melhor é o GoEnhance AI. No uso diário, ele parece um espaço criativo tudo-em-um feito para entregar, não só experimentar. Também é onde normalmente começo quando preciso de um gerador de vídeo AI que não me faça lutar com a interface só para ter um resultado limpo.

O que o torna mais prático é que vai além de "gerar uma vez e torcer". Posso mover da ideia → esboço → saída publicável com menos desvios, esteja fazendo um conceito focado em imagem, um clipe curto ou um lote rápido de variações.

Uma das maiores economias de tempo para mim é imagem para vídeo. Posso pegar uma única imagem estática (uma foto de produto, imagem de personagem, visual-chave, até um rascunho de design) e transformar em um clipe curto em movimento que já está "apresentável" para web, anúncios ou social. Quando construo um pipeline de conteúdo, isso frequentemente faz a diferença entre entregar hoje vs. ficar ajustando por uma semana.

E quando começo do zero visualmente, gosto de combiná-lo com uma mentalidade de gerador de imagem AI: gerar primeiro uma boa imagem hero, depois animar a melhor em movimento. Isso mantém tudo consistente e faz as iterações parecerem intencionais e não aleatórias.

O que realmente diferencia o GoEnhance AI para mim é como é fácil escalar a qualidade quando preciso. Se quero resultados de alto nível ou uma "personalidade de modelo" específica, posso usar páginas dedicadas de modelos em vez de adivinhar:

- Para testes cinematográficos no estilo produção, eu tento Seedance 2.0.

- Quando quero clipes mais longos e com ritmo forte para histórias, testo Vidu Q3.

- E se busco aquele visual nítido e controlado que resiste a um exame mais próximo, verifico Kling O3.

Aqui está o que faz o GoEnhance AI parecer mais adequado para projetos diversos:

- Experiência focada em fluxo de trabalho: posso iterar rápido, comparar saídas e manter o ritmo sem transformar toda tentativa em uma "sessão de produção" pesada.

- Versatilidade entre estilos: quando mudo de vibe — limpo, cinematográfico, estilizado, brincalhão — não sou obrigado a recomeçar tudo do zero.

- Resultados prontos para publicação: as saídas são mais fáceis de adaptar para landing pages, conteúdos curtos e pipelines de marketing.

Se Higgsfield é onde vou quando quero "dirigir uma cena", o GoEnhance AI é onde vou quando quero produzir consistentemente — e manter os projetos criativos em movimento sem ficar preso em rerolls infinitos.

12. Conclusão: Meu veredito final das avaliações do Higgsfield AI (e para quem eu recomendaria)

Meu veredito final sobre o Higgsfield AI é que ele é um workspace criativo forte quando você planeja suas gerações como cenas, mas um playground frustrante se você só quer rerolls sem fim. Estudo de Caso OpenAI

Se eu tivesse que resumir em uma linha: trate o Higgsfield como um estúdio, não uma máquina caça-níqueis. Escolha o fluxo de trabalho primeiro, mantenha sua direção simples, troque modelos com intenção e você terá resultados muito mais previsíveis.

E para quem está buscando avaliações mais amplas do Higgsfield: procure testadores que mostrem seu método de iteração, não só outputs selecionados. Isso mostra se a ferramenta combina com seu nível de paciência, tolerância orçamentária e o tipo de "controle cinematográfico" que você realmente quer.