Review de Higgsfield AI—Control Cinematográfico, No Para Todos

- 1. Reseñas de Higgsfield AI en una frase: Para quién es (y quién debería evitarlo)

- 2. Reseñas de Higgsfield AI: La estructura de la plataforma (Qué realmente haces clic, en términos humanos)

- 3. Modelos: Por qué la selección de modelo no es opcional

- 4. Lenguaje de cámara: Cinema Studio y "dirigir" realmente cambian resultados

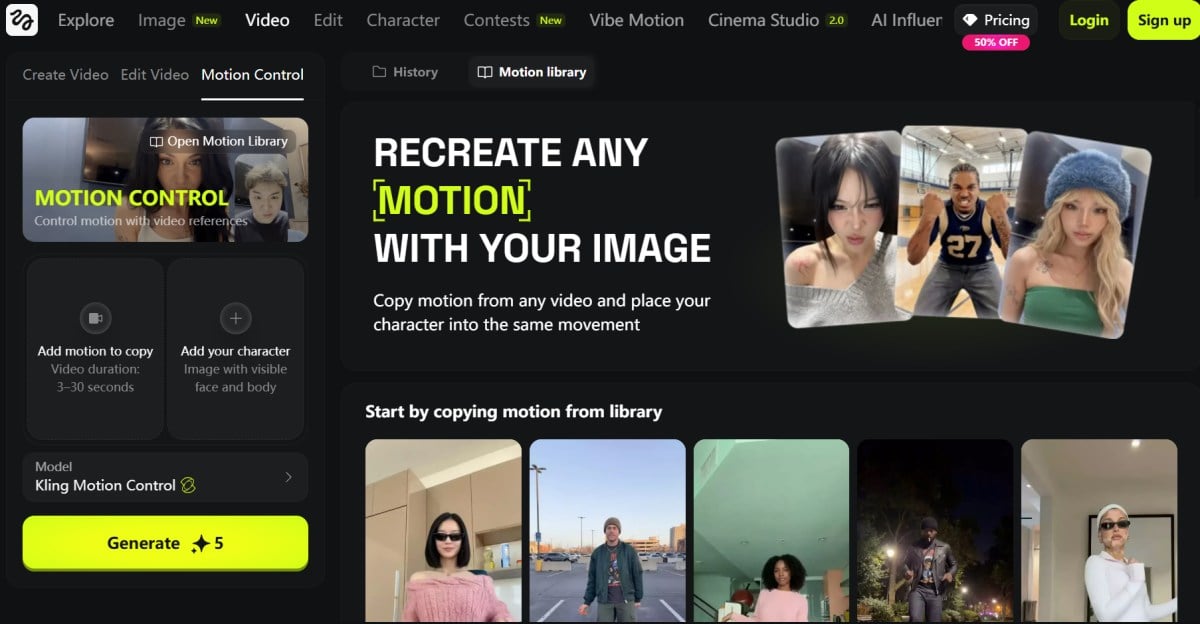

- 5. Control de movimiento: genial cuando respetas sus límites

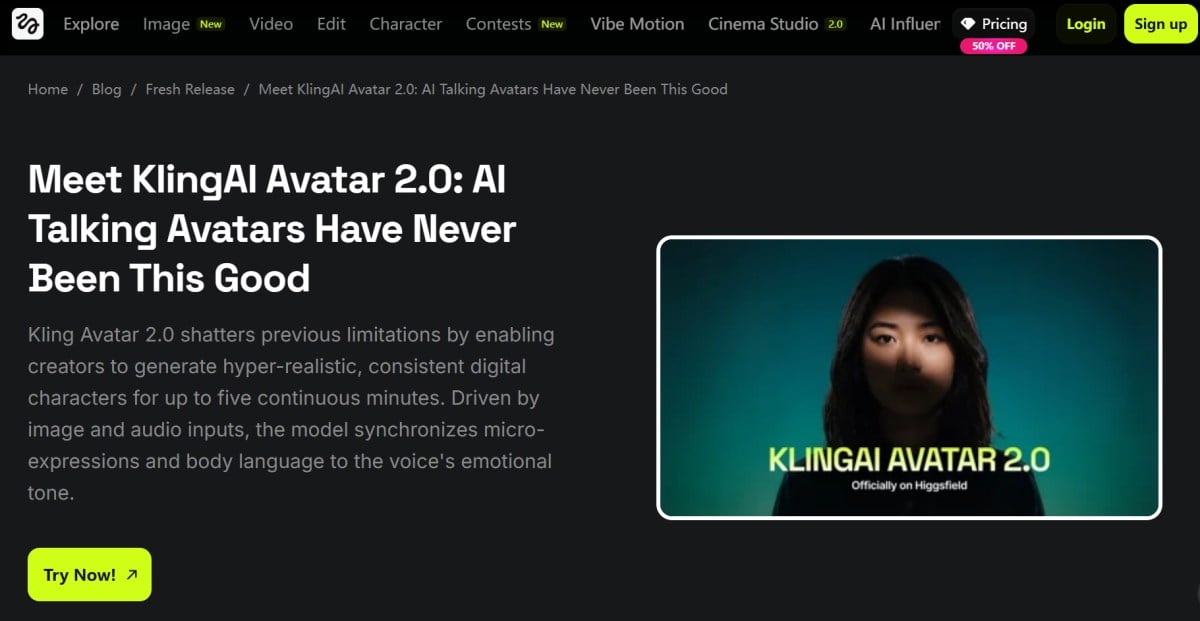

- 6. Personajes y avatares parlantes: sorprendentemente prácticos para formatos largos

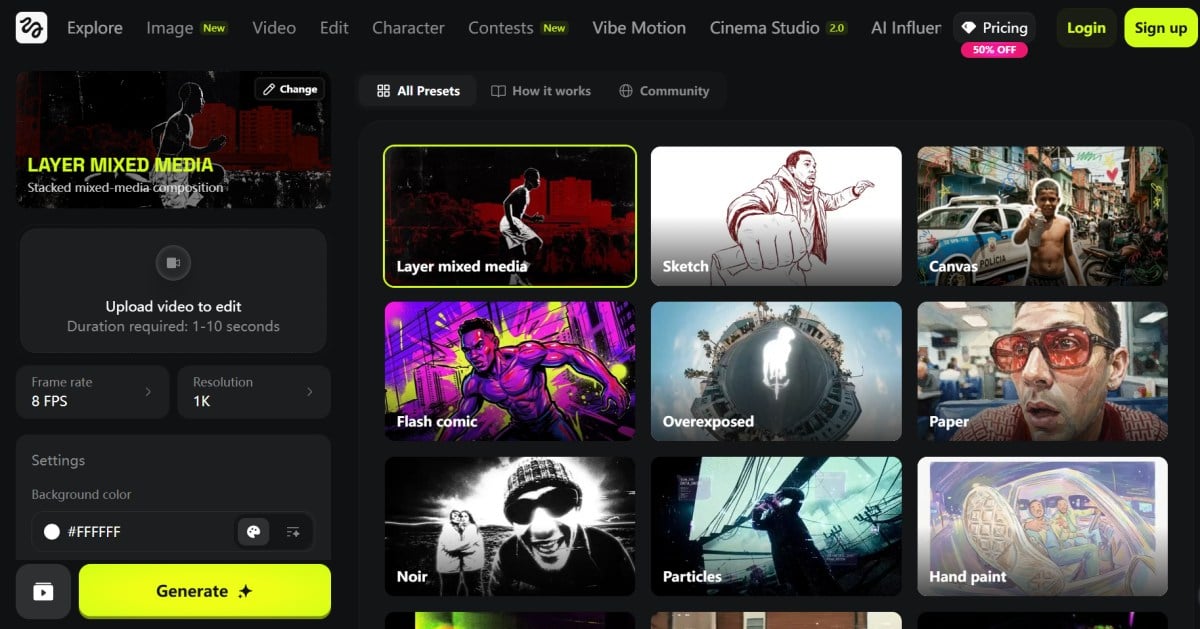

- 7. Efectos visuales y medios mixtos: el camino más rápido hacia algo compartible

- 8. Precios y señales de confianza: lo que verifico antes de gastar créditos

- 9. Mi flujo de trabajo "entrega" (la parte que la mayoría de reseñas de Higgsfield no explican)

- 10. Reseñas de Higgsfield AI: Lo que no me gustó (y las soluciones que realmente usé)

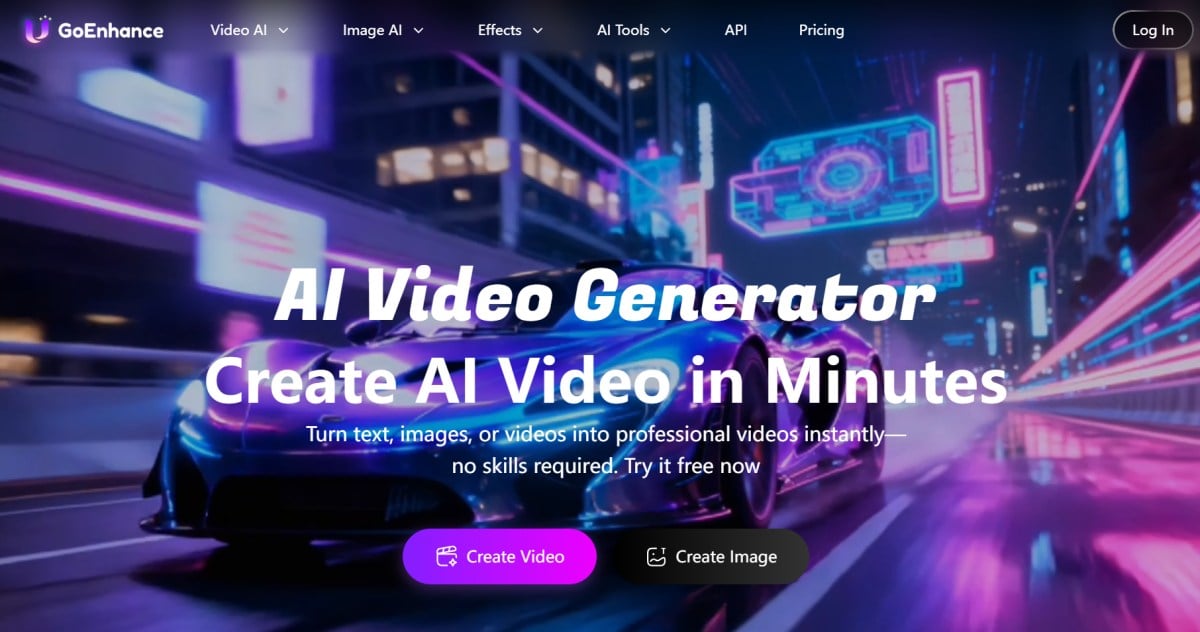

- 11. ¿Quieres un generador de IA más potente? ¡Prueba GoEnhance AI!

- 12. Conclusión: Mi veredicto final de reseñas de Higgsfield AI (y a quién se lo recomendaría)

Las reseñas de Higgsfield AI suelen dividir a las personas en dos grupos: quienes aman los controles "estilo director" y quienes se frustran con el sistema de créditos o la curva de aprendizaje. Después de usarlo como usaría una herramienta de producción real (no solo un juguete de "escribir prompt → rezar"), mi conclusión es simple: Higgsfield es más fuerte cuando lo tratas como un centro de flujo de trabajo—modelos + lenguaje de cámara + preajustes repetibles—en lugar de un botón mágico único. Higgsfield AI Video

Estoy escribiendo esta reseña de Higgsfield AI de la misma manera que pruebo cualquier plataforma creativa: comienzo con el camino más rápido hacia un clip utilizable, luego pongo a prueba los controles que prometen hacerla "cinematográfica", y finalmente verifico si la plataforma realmente ayuda a entregar contenido más rápido (o solo te da más perillas para girar). También mantuve un registro rápido de notas para ser honesto sobre qué se sentía genial y qué se sentía desordenado.

1. Reseñas de Higgsfield AI en una frase: Para quién es (y quién debería evitarlo)

Si quieres un solo lugar para probar múltiples modelos de vídeo líderes y dirigir planos con herramientas de cámara/movimiento, Higgsfield vale tu tiempo; si quieres experimentación barata e ilimitada sin fricción, te molestará. Crear vídeos con Kling, Veo, Sora y más

Aquí está el modelo mental que hizo que todo encajara para mí: Higgsfield no ofrece "un modelo para gobernarlos a todos". Ofrece un espacio de trabajo parecido a una producción donde eliges un flujo de trabajo, lo combinas con un modelo y diriges el movimiento—más parecido a hacer un plano que a "generar un clip".

Lo que encontré que realmente hace bien

- Cambiar entre múltiples modelos de vídeo líderes sin salir de la plataforma.

- Una mentalidad estructurada de "crear contenido rápido" que se ha descrito públicamente como convertir una intención burda en un plan más claro antes de la generación.

Cuándo lo evitaría

- Si odias las herramientas creativas basadas en créditos (sentirás cada reintento).

- Si principalmente quieres imágenes estáticas y solo ocasionalmente un clip corto.

- Si quieres un único modelo "mejor respuesta" y no te importa comparar resultados.

2. Reseñas de Higgsfield AI: La estructura de la plataforma (Qué realmente haces clic, en términos humanos)

La estructura de Higgsfield es su arma secreta: separa "elegir un flujo de trabajo" de "elegir un modelo," lo que te evita forzar una herramienta a hacer todo.

La mayoría de las herramientas te lanzan a una caja de prompt. Higgsfield te guía hacia carriles—generación de vídeo, controles cinematográficos, control de movimiento, efectos y flujos de trabajo dirigidos por personajes—para que puedas comenzar simple y luego añadir control solo cuando lo necesites.

La idea del "hub" (Por qué importa el diseño)

Para mí, el diseño resolvió un dolor real: no tuve que reaprender cinco sitios web diferentes solo para comparar resultados. Si un prompt parecía 80% correcto pero el movimiento era raro, podía probar la misma idea con otro modelo y mantener la lógica del plano consistente.

Aquí tienes un mapa rápido de cómo lo usé:

| Qué intentaba hacer | Dónde empecé | Qué cambié cuando falló | Por qué ayudó |

|---|---|---|---|

| Clip corto estilo producto | Flujo de trabajo multimodelo vídeo | Movimiento de cámara más ajustado + escena simple | Menos resultados "aleatorios" AI Video |

| Clip de personaje con movimiento legible | Control de Movimiento | Reduje la complejidad del movimiento | Menos brillo + deriva Control de Movimiento |

| Publicación social impulsada por estilo | Medios mixtos / Efectos | Elegí un preajuste en vez de reescribir prompts | Más rápido para "usable" Medios Mixtos |

3. Modelos: Por qué la selección de modelo no es opcional

Higgsfield es más valioso cuando tratas los modelos como motores que cambias según el plano, porque la plataforma está diseñada para cambiar y comparar.

En la página de vídeo AI de Higgsfield, destacan el acceso a múltiples modelos de vídeo en un solo espacio de trabajo, con la capacidad de cambiar y comparar resultados. Eso importa porque los resultados reales varían: un modelo puede clavar el movimiento pero fallar en las caras, otro mantiene la identidad pero se ve rígido.

Mi regla práctica:

- Si el plano necesita alta legibilidad de movimiento, comienza con una opción confiable en movimiento.

- Si el plano necesita realismo de alta gama, prueba las opciones centradas en fotorrealismo.

- Si el plano necesita secuenciación multi-plano / cinematográfica, prueba la combinación modelo + flujo de trabajo que está diseñada para eso.

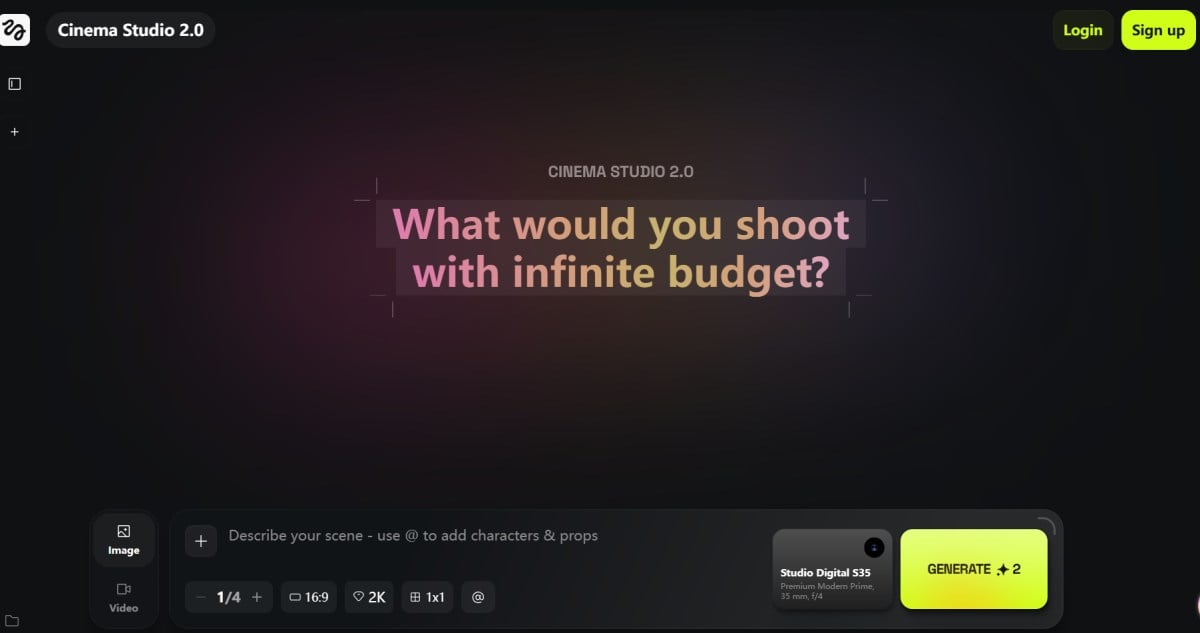

4. Lenguaje de cámara: Cinema Studio y "dirigir" realmente cambian resultados

Las herramientas cinematográficas importan porque reducen el azar del prompt—puedes moldear el movimiento como un plano en lugar de esperar que el modelo adivine tu intención. Higgsfield Cinema Studio

Este es el momento donde Higgsfield deja de sentirse como un juguete y se parece más a un flujo de trabajo. Cuando dejé de escribir prompts extensos y empecé a dar direcciones más claras, mi tasa de aciertos subió:

- Un movimiento de cámara (no tres)

- Un sujeto (no una multitud)

- Una ambientación de luz (no "cinematográfico + neón + atardecer + noir" todo junto)

Si quieres la explicación "oficial" de lo que Cinema Studio intenta lograr (más allá del marketing), su guía es un contexto útil: Guía Cinema Studio 2.0

5. Control de movimiento: genial cuando respetas sus límites

Control de Movimiento es realmente útil para coreografiar acciones, pero castiga entradas desordenadas y movimientos demasiado ambiciosos.

En Higgsfield, Control de Movimiento está posicionado como control preciso de acciones y expresiones de personajes (con referencias de vídeo). En la práctica, lo traté como bloquear una escena: mantener movimientos legibles, no apilar microacciones y evitar fondos desordenados.

Mi lista de verificación para "mantenerlo estable"

- Usar un sujeto claro (especialmente para trabajo facial/gestos).

- Evitar oclusiones fuertes (manos cubriendo caras, ángulos extremos).

- Reducir la complejidad de la acción antes de añadir estilo.

6. Personajes y avatares parlantes: sorprendentemente prácticos para formatos largos

Si necesitas actuación hablada, el flujo de trabajo de avatares de Higgsfield puede ahorrar tiempo—cuando tus entradas son limpias y tus expectativas realistas.

Aquí es donde mi opinión sobre "reseñas de Higgsfield" se volvió más práctica que estética: los flujos de trabajo con avatares no buscan un clip perfecto único, sino entregas repetibles. Cuando usé imágenes limpias, frontales y buen audio, la salida se volvió una canalización útil para explicadores, anuncios estilo UGC o variantes multi-idioma.

7. Efectos visuales y medios mixtos: el camino más rápido hacia algo compartible

Los preajustes de Efectos y Medios Mixtos de Higgsfield son la manera más rápida de conseguir una vibra "lista para publicar" sin reescribir prompts todo el día.

Cuando necesitaba resultados ya (no un plano perfecto de película), recurrí a los preajustes. Ese es el valor honesto: obtienes una biblioteca que puede convertir un clip base decente en algo que se lee como estilizado e intencional.

Dos puntos de entrada que vale la pena guardar como favoritos:

- Biblioteca de efectos: Colección de Efectos

- Biblioteca de medios mixtos: Medios Mixtos

Un flujo de trabajo simple que me funcionó:

- Generar un clip básico y limpio.

- Aplicar un efecto o preajuste de Medios Mixtos.

- Exportar, luego decidir si es publicable o necesita una segunda pasada.

8. Precios y señales de confianza: lo que verifico antes de gastar créditos

Higgsfield puede ser excelente, pero debes tratarlo como una herramienta de presupuesto de producción—planificar pruebas, rastrear créditos y verificar señales externas antes de escalar.

No intento "adivinar" tu sensibilidad al precio, porque eso es personal. En cambio, busco patrones: ¿los usuarios se sorprenden con la facturación? ¿Sienten que el soporte es responsivo? ¿Mencionan inestabilidad o tiempos de espera?

Aquí están las referencias que revisaría (no como palabra sagrada, solo como buscadores de patrones): Trustpilot: higgsfield.ai

9. Mi flujo de trabajo "entrega" (la parte que la mayoría de reseñas de Higgsfield no explican)

La manera más rápida de ganar con Higgsfield es manejarlo como un mini estudio: una idea, tres variaciones controladas, luego comprometerse con la mejor toma.

Aquí está el ciclo que uso cuando quiero algo publicable:

- Escribir el plano en inglés simple (qué pasa, qué hace la cámara, cuál es el ambiente).

- Generar tres variaciones con pequeñas diferencias intencionales (intensidad del movimiento de cámara, simplicidad del fondo, complejidad de movimiento).

- Elegir la mejor toma, y solo entonces aplicar un pase de estilo/efecto.

Si estoy creando contenido que necesita estar en un sitio, también mantengo una canalización paralela que no depende de una sola herramienta. Cuando necesito un resultado limpio y amigable para la web rápido, a veces paso el concepto primero por imagen a vídeo, luego decido si merece un pase más "cinematográfico".

Y cuando organizo lo que se publica vs. lo que queda experimental, me gusta tener una base estable—la mía es GoEnhance AI.

10. Reseñas de Higgsfield AI: Lo que no me gustó (y las soluciones que realmente usé)

Higgsfield es poderoso, pero la presión de créditos y la inconsistencia entre modelos son los dos inconvenientes que debes planear—o la experiencia puede sentirse más frustrante que "cinematográfica."

Los señalo porque son las cosas que seguí encontrando al probarlo como un creador real: múltiples iteraciones, múltiples modelos y una fecha límite de entrega.

Los principales inconvenientes (en lenguaje claro)

- La iteración basada en créditos puede cambiar tu comportamiento. Me encontré dudando en reintentar incluso cuando sabía que una segunda toma probablemente sería mejor.

- La interfaz es rica, pero no instantáneamente obvia. Hay muchos carriles (modelos, Cinema Studio, Control de Movimiento, Efectos, avatares), y la primera hora puede sentirse como aprender a pilotar.

- Mismo prompt, modelo diferente, realidad distinta. La ventaja es elección—la desventaja es que debes crear un hábito de selección.

- La lentitud en horas pico puede arruinar el impulso. Si una generación falla o la cola es más larga de lo esperado, el costo en tiempo puede doler más que el costo en créditos.

- Cámara compleja + acción compleja aumenta riesgo de artefactos. Cuanto más apiles movimientos y microacciones, más fácil es provocar brillo, textura errante, rarezas en manos o parpadeo de bordes.

Mi tabla de "Síntoma → Mejor solución"

| Síntoma que vi | Causa probable | La mejor solución que usé |

|---|---|---|

| Se ve genial, pero el sujeto se desplaza | demasiada complejidad en el movimiento | reducir a una acción + un movimiento de cámara |

| Gran movimiento, detalles suaves | incompatibilidad de preferencia del modelo | cambiar modelos y mantener dirección idéntica |

| La identidad se siente "fuera" | referencia de entrada débil | usar una imagen de referencia limpia y frontal |

| El clip se siente aleatorio | el prompt intenta hacer todo | reescribir como plano: sujeto + acción + cámara + iluminación |

| Demasiados reintentos | pruebas sin foco | lote de 3 variaciones, luego detener y elegir |

11. ¿Quieres un generador de IA más potente? ¡Prueba GoEnhance AI!

Si quieres una plataforma más rápida, amigable para creadores y lo suficientemente flexible para producción diaria (no solo "experimentos cinematográficos"), GoEnhance AI es la que pondría en el centro de mi flujo de trabajo.

Como dije, Higgsfield AI puede sentirse como el escritorio de un director—impresionante cuando persigues un plano específico y estás dispuesto a iterar con cuidado. Pero cuando trabajo en proyectos más variados y de alto volumen (clips sociales, activos de marketing, pruebas rápidas, estilos diferentes), quiero algo que se mantenga rápido, flexible y fácil de repetir.

Por eso mi mejor sugerencia es GoEnhance AI. En el uso diario, se siente como un espacio creativo todo en uno diseñado para entregar, no solo experimentar. También es donde usualmente empiezo cuando necesito un generador de video AI que no me haga pelear con la interfaz solo para obtener un resultado limpio.

Lo que lo hace sentir más práctico es que va más allá de "generar una vez y esperar." Puedo pasar de idea → borrador → salida publicable con menos desvíos, ya sea haciendo un concepto liderado por imagen, un clip corto o un lote rápido de variaciones.

Uno de los mayores ahorradores de tiempo para mí es imagen a video. Puedo tomar una sola imagen fija (una toma de producto, una imagen de personaje, un visual clave, incluso un boceto rough) y convertirla en un clip de movimiento corto que ya es "presentable" para web, anuncios o redes sociales. Cuando estoy armando una canalización de contenido, esto suele ser la diferencia entre entregar hoy vs. sobreajustar durante una semana.

Y cuando empiezo desde cero visualmente, me gusta combinarlo con una mentalidad generador de imágenes AI: generas primero una imagen hero limpia, luego animas la mejor en movimiento. Mantiene todo consistente y las iteraciones se sienten intencionadas en lugar de aleatorias.

Lo que realmente distingue a GoEnhance AI para mí es lo fácil que es escalar la calidad cuando la necesito. Si quiero salidas de alta gama o una "personalidad de modelo" específica, puedo usar páginas dedicadas de modelos en lugar de adivinar:

- Para tests de movimiento estilo producción cinematográfica, pruebo Seedance 2.0.

- Cuando quiero clips más largos y amigables con la historia con buen ritmo, pruebo Vidu Q3.

- Y si busco esa apariencia nítida y controlada que resiste un examen detallado, reviso Kling O3.

Aquí está por qué GoEnhance AI se siente mejor para proyectos diversos:

- Experiencia centrada en flujo de trabajo: puedo iterar rápido, comparar salidas y mantener el impulso sin convertir cada intento en una "sesión de producción" pesada.

- Versatilidad en estilos: cuando cambio ambientes—limpio, cinematográfico, estilizado, juguetón—no me veo obligado a reconstruir todo desde cero.

- Resultados amigables para publicación: las salidas son más fáciles de adaptar a landing pages, contenido corto y canalizaciones de marketing.

Si Higgsfield es a donde voy cuando quiero "dirigir un plano," GoEnhance AI es a donde voy cuando quiero producir consistentemente—y mantener los proyectos creativos avanzando sin atascarme en reintentos infinitos.

12. Conclusión: Mi veredicto final de reseñas de Higgsfield AI (y a quién se lo recomendaría)

Mi veredicto final sobre Higgsfield AI es que es un sólido espacio creativo cuando planeas tus generaciones como planos, pero es un patio de recreo frustrante si solo quieres reintentos sin parar. Estudio de caso OpenAI

Si tuviera que reducirlo a una línea: trata a Higgsfield como un estudio, no una máquina tragamonedas. Elige primero el flujo de trabajo, mantén tu dirección simple, cambia modelos con intención, y obtendrás resultados mucho más predecibles.

Y para cualquiera que busque reseñas más amplias de Higgsfield: busca testers que muestren su método de iteración, no solo salidas seleccionadas. Eso te dice si la herramienta coincide con tu nivel de paciencia, tu tolerancia de presupuesto y el tipo de "control cinematográfico" que realmente quieres.