J'ai testé Higgsfield AI — Contrôle cinématographique, pas pour tout le monde

- 1. Avis sur Higgsfield AI en une phrase : Pour qui (et pour qui éviter)

- 2. Avis sur Higgsfield AI : La structure de la plateforme (Ce sur quoi on clique vraiment, en termes simples)

- 3. Modèles : Pourquoi choisir son modèle n'est pas optionnel

- 4. Langage caméra : Cinema Studio et la "direction" changent vraiment les résultats

- 5. Contrôle de mouvement : excellent quand on respecte ses limites

- 6. Personnages et avatars parlants : étonnamment pratiques pour le long format

- 7. Effets Visuels et Média Mixte : Le chemin le plus rapide vers quelque chose de partageable

- 8. Tarification et signaux de confiance : ce que je vérifie avant de dépenser des crédits

- 9. Mon workflow "livraison" (La partie que la plupart des avis Higgsfield ne décryptent pas)

- 10. Avis sur Higgsfield AI : Ce que je n'ai pas aimé (et les corrections que j'ai vraiment utilisées)

- 11. Vous voulez un générateur AI plus puissant ? Essayez GoEnhance AI !

- 12. Conclusion : Mon verdict final sur Higgsfield AI (et à qui je le recommande)

Les avis sur Higgsfield AI divisent généralement les utilisateurs en deux camps : ceux qui adorent les contrôles « style réalisateur », et ceux qui sont rebutés par le système de crédits ou la courbe d'apprentissage. Après l'avoir utilisé comme un véritable outil de production (et pas seulement un jouet « taper une commande → prier »), ma conclusion est simple : Higgsfield est plus performant quand vous le considérez comme un foyer de flux de travail — modèles + langage caméra + presets répétables — plutôt que comme un bouton magique unique. Vidéo Higgsfield AI

Je rédige cet article d'avis sur Higgsfield AI comme je teste toute plateforme de création : je commence par la voie la plus rapide vers un clip utilisable, puis je mets à l'épreuve les contrôles censés rendre ça « cinématographique », et enfin je vérifie si la plateforme m'aide vraiment à livrer du contenu plus vite (ou si elle me donne juste plus de boutons à tourner). J'ai aussi tenu un journal de notes rapides pour rester honnête sur ce qui fonctionnait bien et ce qui semblait confus.

1. Avis sur Higgsfield AI en une phrase : Pour qui (et pour qui éviter)

Si vous souhaitez un seul endroit pour essayer plusieurs modèles vidéo de pointe et diriger des plans avec des outils caméra/motion, Higgsfield vaut le coup ; si vous voulez expérimenter à bas coût, sans friction, vous serez agacé. Créez des vidéos avec Kling, Veo, Sora & plus

Voici le modèle mental qui a tout fait cliquer pour moi : Higgsfield ne propose pas « un modèle unique pour tout régner ». Il propose un espace de travail proche d'une production où vous choisissez un workflow, l'associez à un modèle, et dirigez le mouvement — plus comme faire un plan que « générer un clip ».

Ce dans quoi je l'ai trouvé vraiment bon

- Passer d'un modèle vidéo de pointe à un autre sans quitter la plateforme.

- Une approche structurée pour « créer du contenu rapidement » qui a été décrite publiquement comme transformant une intention brute en plan clair avant la génération.

Quand je le rangerais

- Si vous détestez les outils créatifs basés sur des crédits (chaque relance vous fera sentir la dépense).

- Si vous voulez surtout des images fixes et seulement occasionnellement un court clip.

- Si vous cherchez un modèle « unique meilleure réponse » et ne voulez pas comparer les résultats.

2. Avis sur Higgsfield AI : La structure de la plateforme (Ce sur quoi on clique vraiment, en termes simples)

La structure d'Higgsfield est son arme secrète : elle sépare « choisir un workflow » de « choisir un modèle », ce qui évite de forcer un outil à tout faire.

La plupart des outils vous jettent dans une boîte de saisie de prompt. Higgsfield vous guide vers des voies — génération vidéo, contrôles cinématographiques, contrôle de mouvement, effets, workflows dirigés par personnage — vous permettant de commencer simple, puis d'ajouter du contrôle quand vous en avez besoin.

L'idée du « Hub » (Pourquoi la disposition est importante)

Pour moi, la disposition a résolu une vraie douleur : je n'ai pas eu à réapprendre cinq sites différents juste pour comparer les résultats. Si un prompt semblait « à 80 % » correct mais que le mouvement était étrange, je pouvais tester la même idée sur un autre modèle et garder la logique du plan cohérente.

Voici une carte rapide de mon utilisation :

| Ce que j'essayais de créer | Où j'ai commencé | Ce que j'ai changé quand ça n'allait pas | Pourquoi ça a aidé |

|---|---|---|---|

| Clip court type produit | Workflow vidéo multi-modèles | Mouvement caméra plus précis + scène simplifiée | Moins de résultats "aléatoires" Vidéo AI |

| Clip de personnage avec mouvement lisible | Contrôle de mouvement | Complexité du mouvement réduite | Moins de scintillement + dérive Contrôle de mouvement |

| Post social axé sur le style | Média mixte / Effets | Choix d'un preset au lieu de réécrire les prompts | Plus rapide pour un résultat « utilisable » Média mixte |

3. Modèles : Pourquoi choisir son modèle n'est pas optionnel

Higgsfield est le plus utile quand vous considérez les modèles comme des moteurs que vous échangez selon le plan, car la plateforme est conçue pour basculer et comparer.

Sur la page AI vidéo d'Higgsfield, on met en avant l'accès à plusieurs modèles vidéo dans un seul espace de travail, avec la possibilité de passer de l'un à l'autre et de comparer les résultats. C'est important car les résultats réels varient : un modèle peut réussir le mouvement mais dévier sur les visages, tandis qu'un autre conserve les identités mais paraît rigide.

Ma règle pratique :

- Si le plan nécessite une lecture forte du mouvement, commencez par un modèle fiable pour le mouvement.

- Si le plan demande un réalisme haut de gamme, testez les options axées photoréalistes.

- Si le plan demande une séquence multi-plans / cinématographique, essayez la combinaison modèle + workflow conçue pour cela.

4. Langage caméra : Cinema Studio et la "direction" changent vraiment les résultats

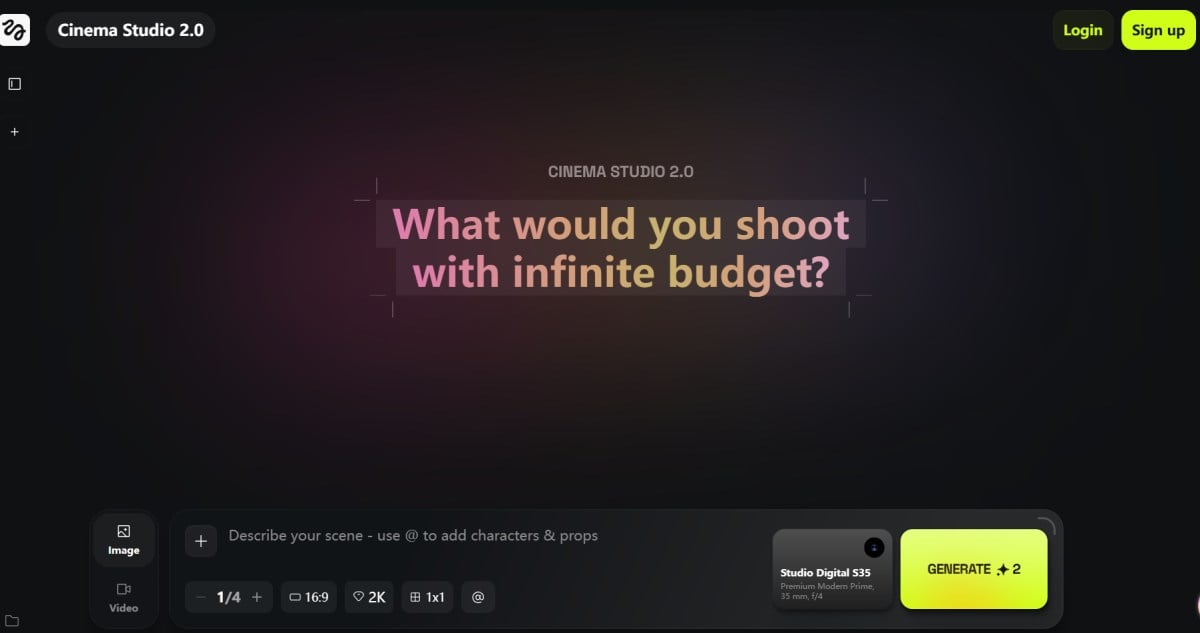

Les outils cinématographiques comptent car ils réduisent le hasard du prompt — vous façonnez le mouvement comme un plan au lieu d'espérer que le modèle devine votre intention. Cinema Studio Higgsfield

C'est le moment où Higgsfield cesse de ressembler à un jouet et devient un vrai flux de travail. Quand j'ai arrêté d'écrire de longs prompts pour donner des directions plus claires, mon taux de réussite a monté :

- Un seul mouvement caméra (pas trois)

- Un seul sujet (pas une foule)

- Une seule ambiance lumineuse (pas « cinématographique + néon + coucher de soleil + noir » tout en même temps)

Pour une explication « officielle » de ce que Cinema Studio cherche à accomplir (au-delà du marketing), leur guide est un bon contexte : Guide Cinema Studio 2.0

5. Contrôle de mouvement : excellent quand on respecte ses limites

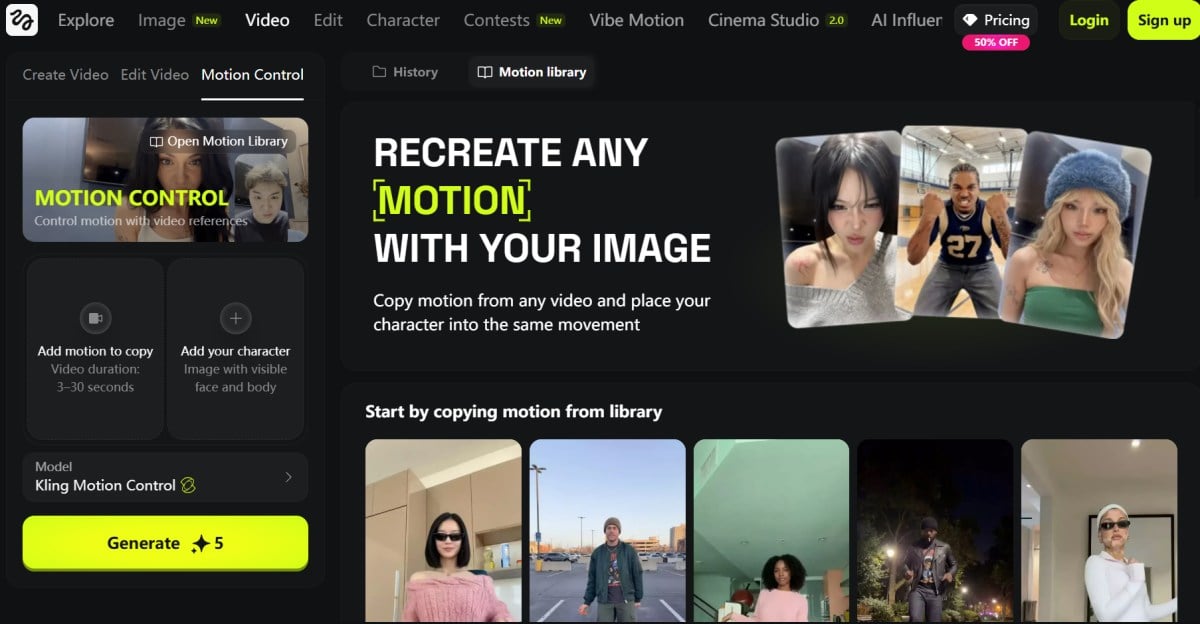

Le Contrôle de Mouvement est vraiment utile pour chorégraphier des actions, mais punit les entrées brouillonnes et les mouvements trop ambitieux.

Sur Higgsfield, le Contrôle de Mouvement est présenté comme un contrôle précis des actions et expressions de personnages (avec références vidéo). En pratique, je l'ai utilisé comme pour bloquer une scène : garder les mouvements lisibles, ne pas cumuler les micro-actions, et éviter les arrière-plans encombrés.

Ma checklist "Garder stable"

- Utiliser un sujet clair (en particulier pour travail sur visage/gestes).

- Éviter les fortes occlusions (mains couvrant visages, angles extrêmes).

- Réduire la complexité des actions avant d'ajouter du style.

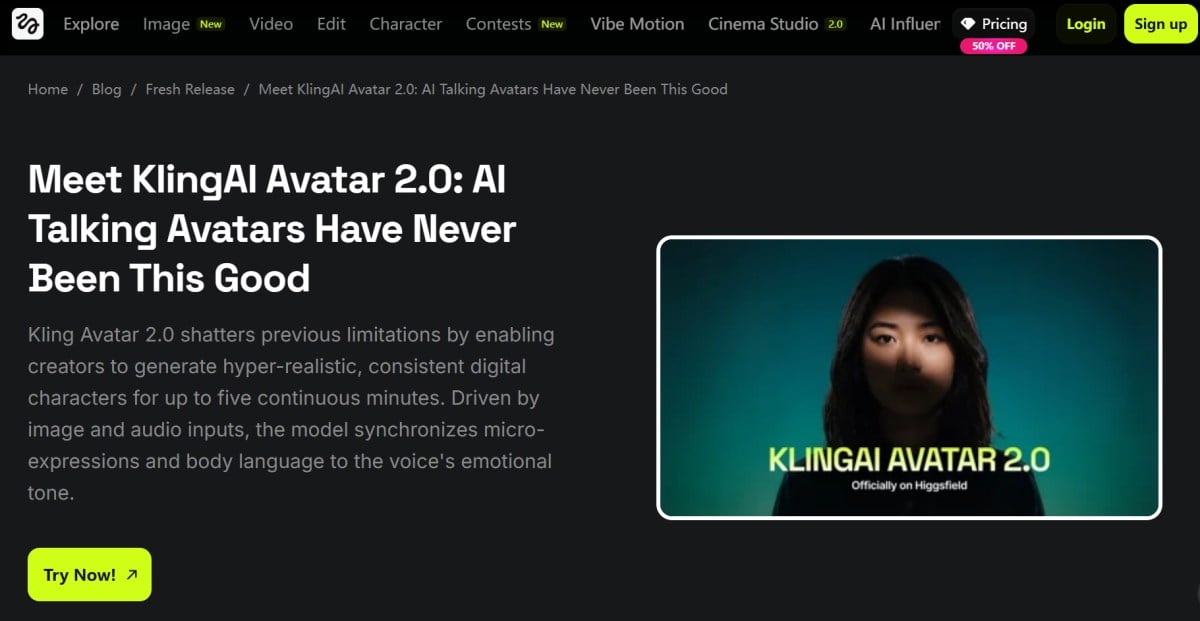

6. Personnages et avatars parlants : étonnamment pratiques pour le long format

Si vous avez besoin d'une performance parlante, le workflow avatar d'Higgsfield peut faire gagner du temps — à condition que les entrées soient propres et les attentes réalistes.

C'est là que mon avis sur Higgsfield est devenu plus pragmatique qu'esthétique : les workflows avatar ne visent pas la perfection d'un clip unique, mais une livraison répétable. Quand j'utilisais des images frontales propres et un bon audio, le résultat devenait une chaîne utile pour des explications, des pubs style UGC, ou des variantes multilingues.

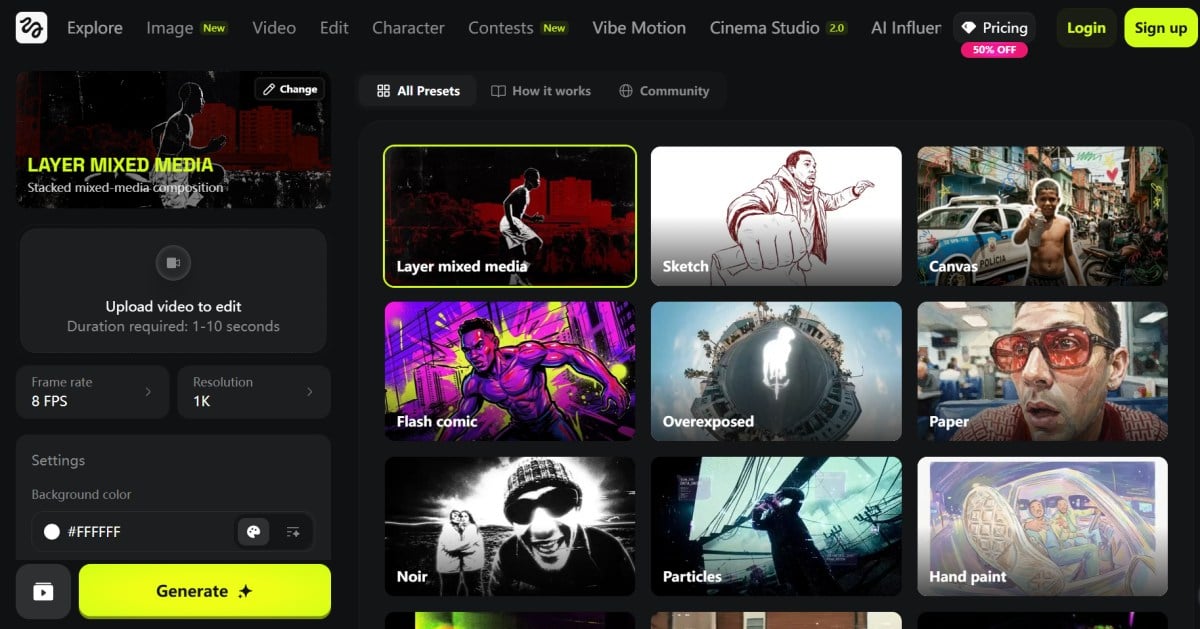

7. Effets Visuels et Média Mixte : Le chemin le plus rapide vers quelque chose de partageable

Les presets Effets et Média Mixte d'Higgsfield sont le moyen le plus rapide pour obtenir une ambiance « prête à poster » sans réécrire des prompts toute la journée.

Quand je voulais des résultats rapidement (pas un plan de film parfait), je me suis appuyé sur les presets. C'est là la vraie valeur : une bibliothèque capable de transformer un clip de base correct en quelque chose de stylisé et intentionnel.

Deux points d'entrée à bookmarker :

- Bibliothèque d'effets : Collection d'effets

- Bibliothèque Média Mixte : Média Mixte

Un workflow simple qui a fonctionné pour moi :

- Générer un clip simple et propre.

- Appliquer un preset effet ou média mixte.

- Exporter, puis décider s'il est publiable ou s'il faut passer une seconde fois.

8. Tarification et signaux de confiance : ce que je vérifie avant de dépenser des crédits

Higgsfield peut être génial, mais vous devez le traiter comme un outil de budget production — planifiez vos tests, suivez vos crédits, et vérifiez les signaux externes avant de monter en charge.

Je ne tente pas de « deviner » votre sensibilité au prix, car c'est personnel. Je cherche plutôt des schémas : les utilisateurs sont-ils surpris par leur facturation ? trouvent-ils le support réactif ? parlent-ils d'instabilité ou de temps d'attente ?

Voici les références que je survole (pas comme une vérité absolue, juste pour identifier des tendances) : Trustpilot : higgsfield.ai

9. Mon workflow "livraison" (La partie que la plupart des avis Higgsfield ne décryptent pas)

Le moyen le plus rapide de réussir avec Higgsfield est de l'utiliser comme un mini studio : une idée, trois variations contrôlées, puis choisir la meilleure prise.

Voici la boucle que j'utilise quand je veux un contenu publiable :

- Esquisser le plan en langage clair (ce qui se passe, ce que fait la caméra, l'ambiance).

- Générer trois variations avec des différences petites et intentionnelles (intensité du mouvement caméra, simplicité du fond, complexité du mouvement).

- Choisir la meilleure prise, puis seulement ensuite appliquer une passe de style/effet.

Si je produis du contenu pour un site, je maintiens aussi une chaîne parallèle sans dépendre d'un outil unique. Quand j'ai besoin d'un résultat propre et compatible web rapidement, je passe parfois d'abord par image vers vidéo, puis je décide si un passage plus « cinématographique » est justifié.

Et quand j'organise ce qui part en production vs ce qui reste expérimental, j'aime avoir une base stable — la mienne est GoEnhance AI.

10. Avis sur Higgsfield AI : Ce que je n'ai pas aimé (et les corrections que j'ai vraiment utilisées)

Higgsfield est puissant, mais la pression des crédits et l'incohérence entre modèles sont deux défauts à anticiper — sinon l'expérience peut être plus frustrante que « cinématographique ».

Je les mentionne parce que c'est ce que j'ai rencontré en testant comme un créateur réel : multiples itérations, modèles variés, et un délai de livraison.

Les principaux inconvénients (en langage simple)

- L'itération basée sur les crédits peut freiner vos essais. Je me suis surpris à hésiter à relancer même lorsque je savais qu'un second essai serait probablement meilleur.

- L'interface est riche, mais pas immédiatement évidente. Beaucoup de voies (modèles, Cinema Studio, Contrôle de mouvement, Effets, avatars), la première heure ressemble à un apprentissage de cockpit.

- Même prompt, modèle différent, réalité différente. Le positif : le choix — le négatif : vous devez créer une habitude de sélection.

- La lenteur aux heures de pointe peut casser l'élan. Si une génération échoue ou fait la queue plus longtemps que prévu, le coût en temps dépasse parfois celui en crédits.

- Caméra complexe + action complexe augmente le risque d'artefacts. Plus vous accumulez de mouvements et micro-actions, plus il est facile de déclencher scintillement, grains, déformation des mains ou scintillement des contours.

Mon tableau "Symptôme → Meilleure solution"

| Symptôme observé | Cause probable | La meilleure solution que j'ai utilisée |

|---|---|---|

| Ça a l'air cool, mais le sujet dérive | trop de complexité de mouvement | réduire à une action + un mouvement caméra |

| Mouvement super, détails flous | modèle mal adapté | changer de modèle en gardant la même direction |

| Identité « décalée » | référence d'entrée faible | utiliser une image de référence plus claire et frontale |

| Clip aléatoire | le prompt fait tout | réécrire comme un plan : sujet + action + caméra + lumière |

| Trop d'essais | tests pas ciblés | lancer 3 variations, puis arrêter et choisir |

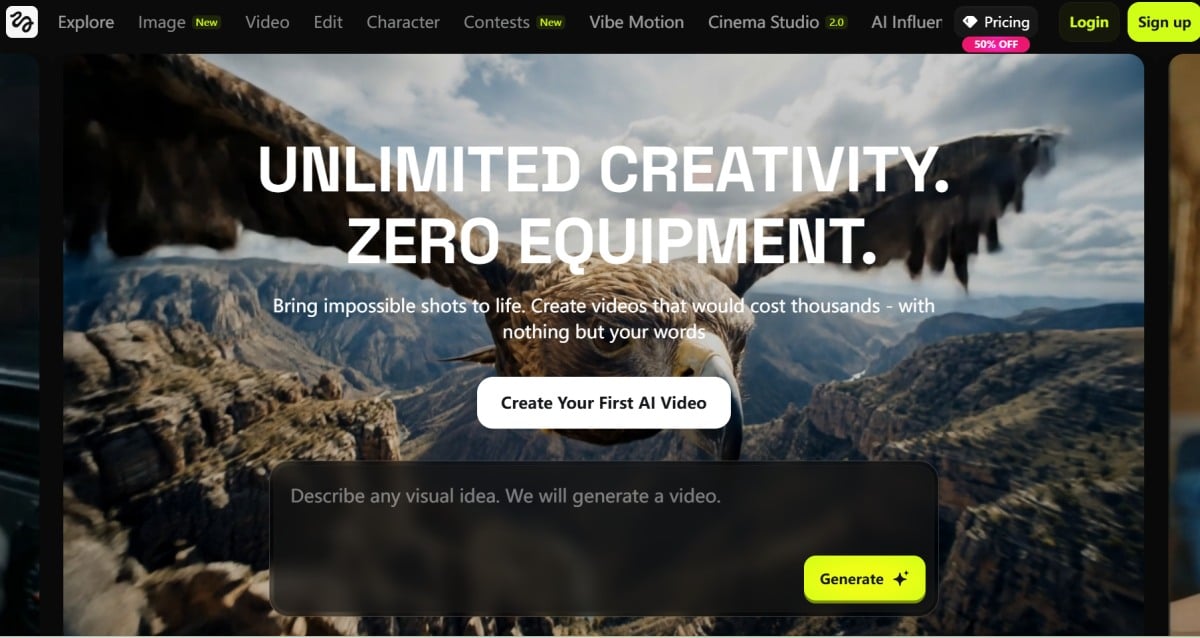

11. Vous voulez un générateur AI plus puissant ? Essayez GoEnhance AI !

Si vous voulez une plateforme plus rapide, plus conviviale, assez flexible pour une production quotidienne (pas seulement des « expériences cinématographiques »), GoEnhance AI est celle que je placerais au centre de mon workflow.

Comme je l'ai dit, Higgsfield AI peut ressembler à un bureau de directeur — incroyable quand vous chassez un « plan » précis et que vous acceptez d'itérer soigneusement. Mais quand je travaille sur des projets plus variés et volumineux (clips sociaux, contenus marketing, tests rapides, styles différents), je veux quelque chose qui reste rapide, flexible et facile à répéter.

C'est pourquoi ma meilleure suggestion est GoEnhance AI. Au quotidien, elle ressemble à un espace de travail créatif tout-en-un conçu pour livrer, pas juste expérimenter. C'est aussi là que je commence habituellement quand j'ai besoin d'un générateur vidéo AI qui ne me fait pas me battre avec l'interface pour obtenir un résultat propre.

Ce qui la rend plus pratique, c'est qu'elle va au-delà du « générer une fois et espérer ». Je peux passer de l'idée → brouillon → sortie publiable avec moins de détours, que je crée un concept mené par l'image, un clip court, ou un lot rapide de variations.

Un des plus grands gains de temps pour moi est l'outil image vers vidéo. Je peux prendre une image fixe unique (une photo produit, un personnage, un visuel clé, même un brouillon design) et la transformer en clip court et animé déjà « présentable » pour le web, les pubs ou les réseaux sociaux. Dans une chaîne de contenu, cela fait souvent la différence entre livrer aujourd'hui ou passer une semaine à trop affiner.

Et quand je commence visuellement de zéro, j'aime l'associer à une démarche générateur d'image AI : générer d'abord une image héros propre, puis animer la meilleure en mouvement. Cela garde tout cohérent et les itérations semblent intentionnelles plutôt qu'aléatoires.

Ce qui distingue vraiment GoEnhance AI pour moi, c'est la facilité à monter en qualité quand j'en ai besoin. Si je veux des sorties plus haut de gamme ou une « personnalité de modèle » spécifique, je peux utiliser des pages dédiées au lieu de deviner :

- Pour les tests de mouvement cinématographiques, façon production, j'essaie Seedance 2.0.

- Quand je veux des clips plus longs, adaptés aux histoires avec un rythme fort, je teste Vidu Q3.

- Et si je cherche ce look net, contrôlé, qui tient à l'examen, je vérifie Kling O3.

Voici ce qui rend GoEnhance AI mieux adaptée aux projets variés :

- Expérience centrée sur le workflow : je peux itérer vite, comparer les résultats, et garder l'élan sans transformer chaque essai en session production lourde.

- Polyvalence de styles : quand je change d'ambiance — propre, cinématographique, stylisé, ludique — je ne suis pas forcé de tout reconstruire.

- Résultats prêts à publier : les sorties s'adaptent plus facilement aux landing pages, contenus courts, et chaînes marketing.

Si Higgsfield est où je vais pour « diriger un plan », GoEnhance AI est où je vais pour produire régulièrement — et faire avancer mes projets créatifs sans rester bloqué dans des relances sans fin.

12. Conclusion : Mon verdict final sur Higgsfield AI (et à qui je le recommande)

Mon verdict final sur Higgsfield AI est que c'est un espace créatif solide quand on planifie ses générations comme des plans, mais un terrain frustrant si on souhaite juste des relances infinies. Étude de cas OpenAI

Si je devais résumer en une phrase : traitez Higgsfield comme un studio, pas une machine à sous. Choisissez d'abord le workflow, gardez votre direction simple, changez de modèle avec intention, et vous obtiendrez des résultats bien plus prévisibles.

Et pour ceux qui cherchent des avis plus larges sur Higgsfield : privilégiez les testeurs qui montrent leur méthode d'itération, pas juste des extraits triés sur le volet. Cela vous dira si l'outil correspond à votre patience, votre budget, et le type de « contrôle cinématographique » que vous souhaitez vraiment.