Seedance 2.0 vs HappyHorse 1.0: Quale si adatta al lavoro video reale?

- Confronto rapido prima di approfondire

- Video di test con lo stesso prompt

- La classifica dice che HappyHorse è più popolare. Non risolve tutta la decisione.

- HappyHorse 1.0 attira l'attenzione perché sembra più vicino a un video finito

- Seedance 2.0 sembra più forte quando il controllo inizia a contare

- Il vero divario si manifesta dopo il primo clip dall'aspetto gradevole

- Scene di dialogo e brevi momenti diretti rivelano più di scatti di bellezza silenziosi

- Quale dovresti scegliere?

- FAQ

- Conclusione

La maggior parte dei confronti si ferma troppo presto.

Guardano il primo clip attraente, indicano una classifica e dichiarano il vincitore. Non è inutile, ma è incompleto. La domanda più pratica è cosa succede dopo il primo risultato dall'aspetto piacevole: quando hai bisogno di una seconda revisione, di una performance più precisa, di una sincronizzazione labiale più pulita, di una continuità più stabile o di una revisione guidata da riferimenti che non rompa l'intero video. È qui che questo confronto diventa più utile.

La mia opinione è semplice. HappyHorse 1.0 ha attualmente il maggior slancio pubblico. Seedance 2.0 ha più senso quando il lavoro non è solo generare un clip, ma mantenere il controllo mentre il clip si trasforma in un flusso di lavoro. Questo non rende un modello universalmente migliore. Significa che iniziano a differenziarsi una volta che ti importa delle revisioni, del tempismo dei dialoghi, dell'input di riferimento o della coerenza multi-shot sotto pressione.

Confronto rapido prima di approfondire

| Lente decisionale | HappyHorse 1.0 | Seedance 2.0 |

|---|---|---|

| Slancio pubblico attuale | Maggior slancio generale nella classifica | Ancora vicino al vertice, particolarmente forte nell'immagine-video con audio |

| Per cosa sembra ottimizzato | Clip multi-shot dall'aspetto finito | Creazione diretta, riferimenti, tempismo e controllabilità |

| Stato pubblico | Modello confermato con forte risonanza pubblica | Modello ufficialmente lanciato con una storia di controllo più chiara |

| Migliore utilizzo | Trailer, brevi annunci, clip guidati dalla storia, sequenze rifinite | Scene di dialogo, riprese guidate da riferimenti, revisioni, continuazione |

| Maggiore punto interrogativo | La storia di accesso pubblico sembra più nuova e meno definita | Meno mistero e hype, più su quanto sia necessario il controllo |

Questa tabella è la versione principale. Il resto dell'articolo riguarda il motivo per cui queste differenze contano nell'uso reale.

Video di test con lo stesso prompt

Questa è la parte che conta di più in un confronto reale. Invece di affidarmi solo alle pagine dei prodotti o agli snapshot delle classifiche, ho usato la stessa struttura di prompt per generare due clip e ho osservato cosa succede quando i modelli devono gestire l'azione dei personaggi, la logica delle scene, il tempismo comico e una linea parlata chiara all'interno di una breve finestra di cinque secondi.

Prompt di test

5s stile Pixar 3D, singola ripresa lenta. Cantiere edile britannico fangoso, impalcature, muri di mattoni, pozzanghere, betoniera, luce diurna grigia e nuvolosa. Un muratore robusto con capelli corti siede su blocchi di cemento con un casco, un compagno dietro di lui tiene una borsa Greggs, un caposquadra consumato con una clipboard mette un cappello da mago malridotto e tarmato sul suo casco. Il cappello si muove, forma un volto, si apre come una bocca e urla: "SPARKY!" Il ragazzo salta su esultando, i muratori applaudono, uno colpisce l'impalcatura con una pala, il caposquadra segna sulla clipboard, il ragazzo si allontana indossando guanti puliti, il prossimo ragazzo deglutisce nervosamente, il cappello si affloscia su un secchio. Messa a fuoco nitida, identità stabile, forme della bocca chiare, tempismo comico fluido, colori britannici smorzati. Nessun tremolio, sfocatura, deriva, persone extra, anatomia errata, oggetti mancanti, testo, filigrana.

Test Seedance 2.0

Test HappyHorse 1.0

Messi fianco a fianco, questo tipo di test è più utile di un confronto generico di bellezza. Ti permette di giudicare se il modello può mantenere stabile l'identità del personaggio, organizzare più azioni in modo pulito e far sì che il momento parlato sia leggibile invece di essere incollato sopra.

La classifica dice che HappyHorse è più popolare. Non risolve tutta la decisione.

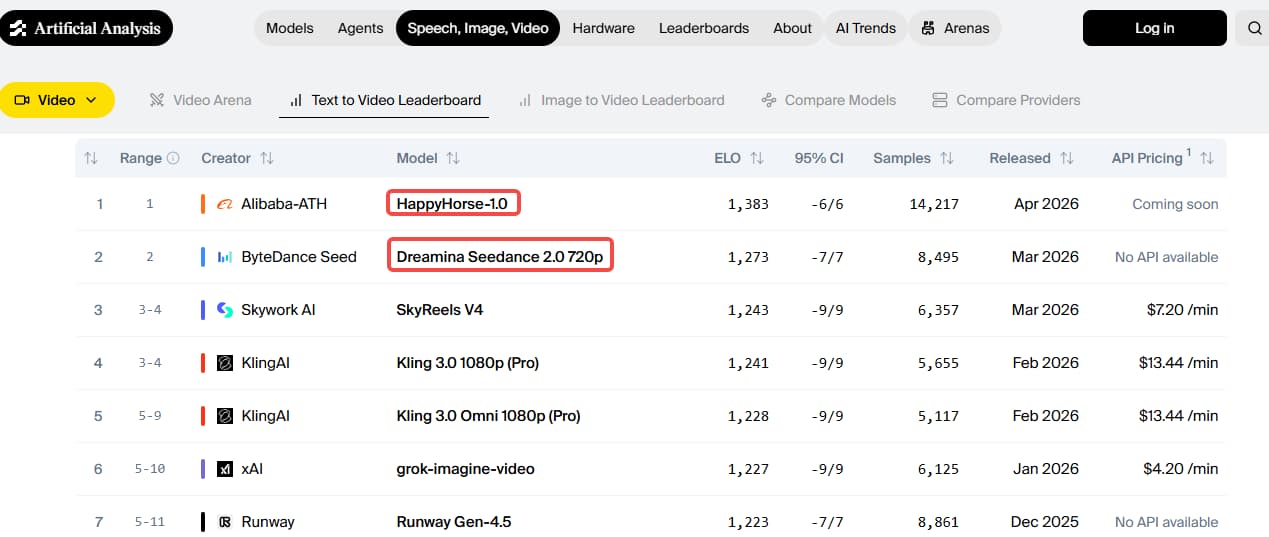

Una posizione forte nella classifica conta. Ti dice che gli spettatori ciechi stanno rispondendo bene all'output. Questo è parte della storia, ed è uno dei motivi per cui HappyHorse 1.0 ha attirato così tanta attenzione così rapidamente. Nella classifica video di Artificial Analysis attuale, HappyHorse sta chiaramente portando un maggiore slancio pubblico.

Ma una classifica è comunque un segnale di preferenza, non un verdetto completo sul flusso di lavoro. Ti dice quali output le persone preferiscono nell'arena. Non risponde completamente a una domanda di produzione come questa: posso mantenere lo stesso volto, lo stesso ritmo, la stessa logica d'azione e la stessa resa dopo un'altra revisione?

È qui che il confronto diventa più pratico rispetto all'hype sociale.

HappyHorse 1.0 attira l'attenzione perché sembra più vicino a un video finito

Questa è la parte che molti confronti azzeccano. HappyHorse 1.0 è convincente perché sembra costruito per scene collegate, non solo per scatti isolati di bellezza. Il suo fascino è facile da capire: flusso multi-shot, maggiore rifinitura al primo sguardo e output che già sembrano vicini a un asset breve e tagliabile.

Questa risonanza pubblica ha anche un vero aggancio di notizie dietro di sé. TechNode ha riportato che Alibaba ha confermato che HappyHorse appartiene alla sua unità ATH, il che aiuta a spiegare perché il modello ha ricevuto così tanta attenzione così rapidamente.

Questo conta per i creatori che realizzano trailer, brevi annunci e clip guidati dalla storia. In quei flussi di lavoro, il modello non deve essere perfetto in tutto. Deve far sembrare una sequenza finita abbastanza velocemente da mantenere lo slancio. Questa è una vera forza, non solo un effetto hype.

Ecco perché descriverei HappyHorse in questo modo: sembra particolarmente attraente quando la priorità è la qualità della sequenza al primo sguardo. Se il clip attrae rapidamente e sembra già abbastanza rifinito da essere pubblicato, è un vantaggio significativo.

Seedance 2.0 sembra più forte quando il controllo inizia a contare

Ecco dove descriverei la vera differenza.

Seedance 2.0 diventa più facile da difendere quando il brief dipende dalla direzione, non solo dalla generazione. Il valore non è solo che può produrre un clip dall'aspetto gradevole. Il valore è che si adatta meglio quando ti importa della leggibilità dei dialoghi, del movimento guidato da riferimenti, della continuazione e della capacità di spingere un risultato più avanti senza perdere il filo.

Questa posizione si allinea anche con il lancio ufficiale di Seedance 2.0 da parte di ByteDance, che punta sulla controllabilità, sull'input multimodale e su flussi di lavoro creativi più diretti piuttosto che sul puro spettacolo one-shot.

Ecco perché Seedance 2.0 ha più senso per i flussi di lavoro che già sembrano creazione video intenzionale: scene parlanti, momenti di personaggi con pressione di tempismo, riprese costruite da materiale di riferimento e revisioni in cui l'idea visiva originale deve ancora mantenersi.

In parole più semplici: Seedance 2.0 sembra particolarmente attraente quando la priorità è il controllo sotto iterazione. Non è così appariscente come un momento wow al primo passaggio, ma diventa più prezioso una volta che il lavoro smette di essere generazione one-shot e inizia a diventare un flusso di lavoro.

Il vero divario si manifesta dopo il primo clip dall'aspetto gradevole

Molti confronti video AI si comportano ancora come se il primo render fosse tutta la storia. Quasi mai lo è.

La parte più difficile è solitamente il passo successivo: mantenere lo stesso personaggio stabile, stringere la performance, estendere la ripresa, sostituire o aggiungere input di riferimento, o regolare un elemento senza rompere tutto ciò che lo circonda. È qui che la controllabilità diventa più importante dell'attrattiva grezza al primo passaggio.

Questo è anche il modo più pulito di pensare al confronto: quale tipo di problema stai cercando di evitare?

Se il tuo problema è un output piatto o imbarazzante al primo passaggio, lo slancio attuale di HappyHorse ha senso. Se il tuo problema è deriva nelle revisioni, tempismo dei dialoghi o rifacimenti guidati da riferimenti, Seedance 2.0 inizia a sembrare la scelta di lavoro più sicura.

Questa è una domanda più utile che semplicemente chiedere quale modello sia "migliore".

Scene di dialogo e brevi momenti diretti rivelano più di scatti di bellezza silenziosi

Questo è probabilmente il divisore pratico più chiaro nel confronto.

Se il lavoro è una sequenza breve rifinita con un forte senso di finitura, HappyHorse 1.0 ha un fascino molto intuitivo. Se il lavoro è una scena più diretta dove il tempismo, la leggibilità della bocca, la logica d'azione e la coerenza audio-visiva contano, Seedance 2.0 diventa più facile da raccomandare.

Questa distinzione è anche il motivo per cui il test con lo stesso prompt conta. Una breve scena di cinque secondi con un momento parlato e più azioni fisiche espone più di una panoramica cinematografica generica potrebbe mai fare. Costringe entrambi i modelli a gestire messa in scena, resa, continuità di movimento e stabilità visiva allo stesso tempo.

Quale dovresti scegliere?

Scegli HappyHorse 1.0 quando:

- il tuo deliverable è un breve annuncio, teaser, battuta di trailer o clip guidato dalla storia che deve sembrare rifinito rapidamente;

- ti importa di più dell'attrattiva visiva al primo passaggio e del flusso di scene collegate;

- sei meno dipendente da un condizionamento di riferimento più profondo o da un tempismo sensibile ai dialoghi.

Scegli Seedance 2.0 quando:

- la ripresa ha bisogno di sincronizzazione labiale, tempismo o coerenza audio-visiva per sembrare credibile;

- vuoi guidare il risultato più intenzionalmente invece di inseguire solo il miglior primo render;

- ti aspetti revisioni, estensioni o cambiamenti guidati da riferimenti dopo il primo passaggio.

Se il tuo flusso di lavoro è più vicino a "generare qualcosa di interessante", lo slancio di HappyHorse è facile da capire. Se il tuo flusso di lavoro è più vicino a "dirigere qualcosa di utilizzabile", Seedance 2.0 è il punto di partenza più forte.

FAQ

HappyHorse 1.0 è il modello migliore in assoluto?

Non in senso universale. Sembra più forte quando l'obiettivo è una sequenza rifinita al primo sguardo. Seedance 2.0 sembra più forte quando il lavoro inizia a dipendere dal controllo, dal tempismo e dalle revisioni successive.

Seedance 2.0 è migliore per scene di dialogo?

Questa è la scelta più chiara. Una volta che i momenti parlati, la leggibilità della bocca e la resa diretta contano, Seedance 2.0 ha più senso come scelta di lavoro.

Perché usare lo stesso prompt per entrambi i modelli?

Perché rimuove una delle maggiori fonti di rumore nei confronti video AI. Il punto non è dare a ogni modello un setup completamente diverso. Il punto è vedere come rispondono alla stessa richiesta creativa.

Conclusione

HappyHorse 1.0 è il titolo più entusiasmante al momento. Seedance 2.0 è la scelta più difendibile quando il brief inizia a sembrare una vera direzione piuttosto che una generazione one-shot.

Questa è la distinzione che terrei a mente.

Se stai creando clip brevi e rifiniti guidati dalla storia, HappyHorse merita l'attenzione che sta ricevendo. Se stai costruendo video che necessitano di sincronizzazione più stretta, controllo più forte e meno interruzioni una volta che iniziano le revisioni, Seedance 2.0 è dove il confronto diventa più pratico rispetto all'hype.