Revue de Kling 2.6 Motion Control : Le guide complet du créateur

- 1. Introduction : La double percée de la génération vidéo IA

- 2. Qu'est-ce que Kling 2.6 Motion Control AI ?

- 3. Capacités principales du contrôle de mouvement : Au-delà des invites textuelles

- 4. Synthèse audio-visuelle en un clic

- 5. Comparaison des versions : 2.6 vs 2.5 Turbo vs Kling O1

- 6. Maîtriser les tokens de mouvement : Le langage de contrôle

- 7. Dépannage : Pourquoi l'IA bouge les mauvaises parties

- 8. Kit de démarrage Motion Control : 10 invites prêtes à l'emploi

- 9. Applications réelles : Qui gagne déjà

- 10. Guide utilisateur : Maximiser vos résultats

- 11. Tarification & analyse ROI

- 12. FAQ : Tout ce que vous devez savoir

- 13. Verdict final & démarrage — Conclusion

Après avoir testé plusieurs outils vidéo IA dans des projets réels, le même problème revenait sans cesse : le mouvement avait l'air bon mais manquait de cohérence, et l'audio devenait toujours une étape séparée et chronophage. Kling 2.6 Motion Control s'est démarqué car il traite le mouvement comme un atout contrôlable et génère un audio synchronisé dans la même passe — ce qui change le flux de travail pour les créateurs de contenus courts.

1. Introduction : La double percée de la génération vidéo IA

Kling Motion Control résout deux des goulots d'étranglement les plus pénibles dans la production de contenus courts — le mouvement peu fiable et les flux audio séparés — en combinant un contrôle de mouvement basé sur une référence avec une génération audio native.

D'après des tests pratiques et l'expérience de projets, cette combinaison raccourcit les cycles d'itération et produit des clips utilisables et prêts à être publiés bien plus rapidement que l'approche traditionnelle « vidéo d'abord, audio ensuite ».

Pourquoi c'est important :

- Haut : Fournir une performance répétable avec un son synchronisé en une seule opération.

- Milieu : Réduire le besoin de capture de mouvement, d'animation manuelle par images clés et de passages séparés de conception sonore.

- Base : Économiser des jours de montage et réduire les budgets de production pour les contenus sociaux et prototypes.

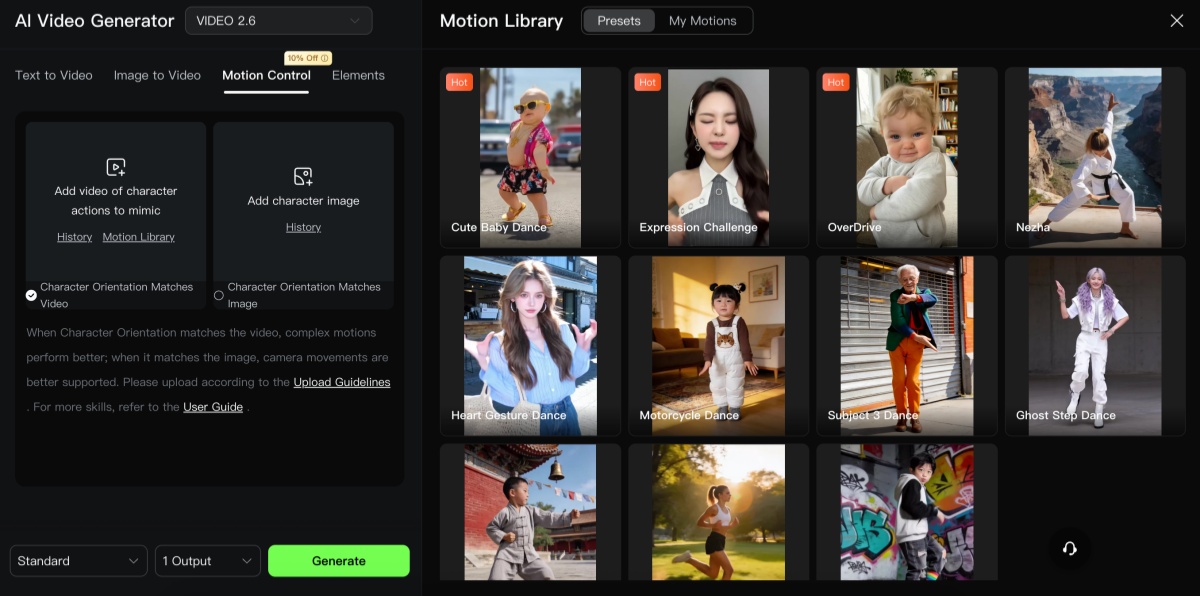

2. Qu'est-ce que Kling 2.6 Motion Control AI ?

Kling 2.6 est un système image-à-vidéo piloté par référence qui applique le mouvement extrait d'un clip source à une image cible tout en préservant l'identité et le style.

Concrètement, le modèle ingère une image fixe (ou une première image) plus une référence de mouvement, extrait des indices squelettiques et temporels, et génère un sujet effectuant ce mouvement — un flux de travail qui ressemble plus à de la marionnette qu'à de la supposition.

Architecture technique :

- Haut : L'encodeur de mouvement lit la référence et produit des données de pose/déplacement image par image.

- Milieu : Un moteur de rendu applique ce mouvement au sujet cible tout en assurant la cohérence du visage et du style.

- Base : Les étapes postérieures incluent le lissage temporel, le raffinement des mains/visage et l'alignement audio optionnel pour produire un clip unique cohérent.

3. Capacités principales du contrôle de mouvement : Au-delà des invites textuelles

Kling 2.6 agit comme un moteur précis de transfert de mouvement plutôt que comme un devineur créatif ; ce changement transforme la manière dont les invites sont écrites et dont les ressources sont préparées.

Là où le texte devait autrefois décrire une chorégraphie complexe, la référence de mouvement fournit désormais le mouvement et l'invite définit la scène, le costume et l'ambiance.

Forces principales

- Transfert de mouvement corps entier : Réplication précise de la pose image par image pour la danse, les cascades et la chorégraphie.

- Gestion de mouvements complexes : Fonctionne avec des actions dynamiques (patinage, arts martiaux) lorsque les références sont nettes et bien cadrées.

- Contrôle fin : L'articulation des mains/doigts en gros plan et les micro-expressions s'améliorent avec des passages dédiés.

- Modes d'orientation doubles : Choisissez entre un mouvement centré sur le personnage ou des trajectoires pilotées par la caméra.

- Rôle redéfini de l'invite : Utilisez le texte principalement pour définir l'environnement, la tenue et l'éclairage plutôt que pour décrire chaque mouvement de membre.

4. Synthèse audio-visuelle en un clic

Kling 2.6 intègre l'audio natif — voix, effets sonores et ambiance — dans la même passe de génération, ce qui modifie considérablement le calcul de production : un rendu unique peut désormais être une coupe quasi prête à la post-production.

Les tests sur des courtes pièces promotionnelles et des extraits de dialogues ont montré que l'audio intégré réduit les transferts et rend les tests A/B de variations créatives triviales comparé à une ingénierie audio séparée.

Valeur ajoutée :

- Haut : Un clip de 5 à 15 secondes peut arriver avec dialogue synchronisé et effets sonores réactifs prêts à l'emploi.

- Milieu : La génération vocale supporte plusieurs langues et aligne les phonèmes sur les images de bouche, tandis que les effets sonores correspondent à l'intensité du mouvement (pas, impacts).

- Base : Des couches d'ambiance sont ajoutées automatiquement pour situer la scène et améliorer la crédibilité.

5. Comparaison des versions : 2.6 vs 2.5 Turbo vs Kling O1

Kling 2.6 est le choix pragmatique pour la fidélité du mouvement et la synchronisation audio ; Kling 2.5 Turbo se concentrait sur la fidélité aux invites et les mouvements dynamiques de caméra ; Kling O1 vise à être une plateforme multimodale unifiée pour les workflows multi-plans.

Comparer ces options a aidé à définir quel modèle utiliser pour quels briefs : 2.6 pour des sorties performantes répétables, 2.5 pour un prototypage créatif rapide, et O1 pour des projets axés sur le montage ou la continuité multi-plans.

Points clés de comparaison

- Précision du mouvement : 2.6 domine quand une référence du monde réel influence le mouvement final.

- Découverte créative : 2.5 Turbo reste plus rapide pour les visuels exploratoires et le langage cinématographique dramatique.

- Pipelines unifiés : O1 est le meilleur pour les projets multi-plans nécessitant un montage cohérent et une continuité entre plans.

6. Maîtriser les tokens de mouvement : Le langage de contrôle

Les tokens de mouvement agissent comme un raccourci déterministe pour les membres, les caméras et les micro-expressions ; les apprendre augmente considérablement la prévisibilité des résultats.

Quand les tokens sont superposés après une référence propre, les sorties deviennent contrôlables d'une manière qui rappelle les pipelines d'animation traditionnels mais avec beaucoup moins de travail manuel.

Taxonomie des tokens

- Tokens de membres : Fixez ou ajustez les membres pour les interactions produit ou les ajustements chorégraphiques.

- Tokens de caméra : Commandes de travelling, panoramique et rotation pour le mouvement cinématographique.

- Micro tokens : Clignements, respiration et petits indices faciaux qui rendent les personnages vivants.

Flux de travail pratique

- Verrouillez les poses larges avec les tokens de membres.

- Ajoutez le langage caméra pour créer des relations de mouvement.

- Terminez avec les micro tokens pour renforcer le réalisme en gros plan.

7. Dépannage : Pourquoi l'IA bouge les mauvaises parties

Les discordances de mouvement proviennent presque toujours de références problématiques, d'instructions conflictuelles ou de différences d'échelle ; corriger ces trois éléments résout la majorité des problèmes.

Une approche disciplinée de la capture et de la conception des invites évite les itérations gaspillées et préserve les crédits de calcul.

Principaux modes d'échec et solutions

- Références floues ou occultées : refaites la prise avec une vitesse d'obturation plus élevée et un cadrage plus propre.

- Inadéquation d'échelle/ratio : recadrez ou choisissez une référence plus proche en proportion de la cible.

- Langage contradictoire : évitez de demander une pose statique tout en attachant un clip de mouvement dynamique.

Cinq règles de sélection

- Utilisez des clips de référence en un seul plan sans montage.

- Faites correspondre l'angle de caméra et le cadrage du sujet à la cible.

- Préférez des arrière-plans unis ou des passages chroma contrôlés.

- Capturez des passages dédiés pour mains/visage pour les micro-détails.

- Maintenez un éclairage cohérent avec le rendu final souhaité.

8. Kit de démarrage Motion Control : 10 invites prêtes à l'emploi

Une bibliothèque concise d'invites a permis une itération rapide lors des tests ; ces modèles ont été affinés sur des projets réels et peuvent être insérés dans l'interface tels quels avec de légers ajustements de durée ou de tokens.

Modèles représentatifs (anglais uniquement)

- Transfert de danse :

Appliquer le mouvement de ref_dance.mp4 à subject.png ; préserver l'identité ; sortie 10s @24fps. - Passage main produit :

Utiliser ref_hand_demo.mp4 pour montrer un passage produit ; garder la caméra en travelling gauche-droite ; mettre en valeur le produit à 00:03. - Ralenti sportif :

Mapper le pic de saut de ref_jump.mp4 ; accentuer l'image à 0,6s ; ajouter effets sonores d'impact.

Comment itérer

- Commencez prudemment : durée courte, moins de tokens, puis augmentez les détails une fois le mouvement de base correct.

9. Applications réelles : Qui gagne déjà

Les premiers utilisateurs — créateurs de contenus courts, équipes de marque et cinéastes indépendants — trouvent la combinaison de fidélité du mouvement et d'audio natif particulièrement avantageuse pour des délais rapides.

Les cas pratiques montrent une réduction des jours de reshoot et des cycles de localisation publicitaire plus rapides lorsque le contrôle de mouvement est utilisé pour standardiser les performances sur plusieurs marchés.

Applications à fort impact

- Créateurs de contenus courts : adaptations rapides de danse et séquences synchronisées labiales à grande échelle.

- Marketing de marque : performances d'acteurs cohérentes et localisées sans multiples tournages en studio.

- Cinéastes : prévisualisation rapide et prototypage de performances pour le blocage et les revues créatives.

- Éducation & formation : démonstrations précises image par image pour techniques sportives ou instructions procédurales.

10. Guide utilisateur : Maximiser vos résultats

Les résultats s'améliorent considérablement lorsque la capture et les choix de paramètres sont alignés sur les forces du modèle ; de petits changements dans la technique de tournage entraînent une forte diminution des reprises de rendu.

Spécifications pratiques

- Clips de référence : visez 3 à 30 secondes ; 24 à 60 fps selon la densité du mouvement.

- Résolution : minimum 720p, 1080p+ pour une fidélité en gros plan.

- Image cible : haute résolution, fond neutre, angle de caméra similaire à la référence.

Liste de contrôle de tournage

- Stabilisez la caméra ; évitez les tremblements à main levée quand c'est possible.

- Capturez des passages rapprochés séparés pour le visage et les mains si le détail est important.

- Utilisez un éclairage cohérent et des costumes neutres pour faciliter le transfert d'identité.

Conseils pour lot

- Numérotez et organisez les ressources, utilisez des jobs API asynchrones pour mettre en file les rendus, et automatisez la correspondance des couleurs à l'export.

11. Tarification & analyse ROI

Les travaux de contrôle de mouvement nécessitent généralement plus de calcul qu'une simple passe texte-à-vidéo, mais le coût global de la campagne diminue souvent une fois les jours de reshoot et les heures de montage évités pris en compte.

Lors de la proposition de Kling 2.6 pour une campagne, présentez la comparaison comme le coût de la plateforme plus les jours de studio et heures de post-production évités.

Checklist ROI

- Calculez le coût par minute du modèle vs. le jour de studio et les frais de talents.

- Ajoutez les coûts évités : déplacements, reshoots, équipement mocap, longs cycles de montage.

- Utilisez les crédits gratuits pour les itérations de concepts et réservez les crédits payants pour les rendus finaux.

12. FAQ : Tout ce que vous devez savoir

Réponses courtes et basées sur l'expérience aux questions opérationnelles courantes.

- Comment enlever le filigrane ? Les niveaux payants ou licences entreprise suppriment généralement les filigranes.

- Kling autorise-t-il le contenu NSFW ? Les politiques et filtres de la plateforme s'appliquent ; vérifiez les conditions du compte.

- Les vidéos Kling sont-elles privées ? La confidentialité dépend des paramètres du compte et des choix d'exportation/stockage.

- Durée supportée pour les références de mouvement ? 3 à 30 secondes est une plage pratique pour une extraction robuste. :contentReference[oaicite:3]{index=3}

- Plusieurs personnages ? Pris en charge avec des références multi-sujets soigneuses et des tokens supplémentaires.

- Voix personnalisées ? Le téléchargement d'audio personnalisé est possible ; l'audio intégré peut générer voix et effets sonores synchronisés.

13. Verdict final & démarrage — Conclusion

Kling 2.6 représente un saut pratique et immédiat en productivité : il transforme le mouvement piloté par référence en un outil de production répétable et associe ce mouvement à un audio synchronisé en une seule passe, ce qui raccourcit le temps entre l'idée et le clip publiable.

Ses points forts sont la fidélité du mouvement, l'audio intégré et l'itération prévisible ; des limites subsistent pour les stylisations extrêmes et les références fortement occultées, où la mocap traditionnelle ou la capture en studio contrôlé offrent encore des avantages.

Démarrage rapide en trois étapes

- Tournez un clip de référence propre de 5 à 12 secondes (plan unique, cadrage stable).

- Préparez une image cible de haute qualité qui correspond au cadrage et à l'éclairage.

- Lancez un test conservateur avec des tokens basiques, puis superposez des micro tokens pour les détails.

Les affirmations concernant l'architecture de contrôle de mouvement de Kling et ses capacités audio natives sont basées sur la documentation du modèle, les références API et des revues pratiques de Kling VIDEO 2.6 Motion Control et des versions Kling associées.