Reseña de Kling 2.6 Motion Control: La Guía Completa para Creadores

- 1. Introducción: El doble avance en la generación de video con IA

- 2. ¿Qué es Kling 2.6 Motion Control AI?

- 3. Capacidades centrales de Motion Control: Más allá de los prompts de texto

- 4. Síntesis audiovisual con un solo clic

- 5. Comparativa de versiones: 2.6 vs 2.5 Turbo vs Kling O1

- 6. Dominando los Motion Tokens: El lenguaje de control

- 7. Resolución de problemas: Por qué la IA mueve las partes equivocadas

- 8. Kit de inicio de Motion Control: 10 prompts listos para usar

- 9. Aplicaciones en el mundo real: Quién ya está ganando

- 10. Guía del usuario: Maximizando tus resultados

- 11. Análisis de precios y ROI

- 12. Preguntas frecuentes: Todo lo que necesitas saber

- 13. Veredicto final y cómo empezar — Conclusión

Después de probar múltiples herramientas de video con IA en proyectos reales, el mismo problema seguía apareciendo: el movimiento se veía bien pero carecía de consistencia, y el audio siempre se convertía en un paso separado y que consumía mucho tiempo. Kling 2.6 Motion Control destacó porque trata el movimiento como un recurso controlable y genera audio sincronizado en la misma pasada, algo que cambia el flujo de trabajo para los creadores de contenido de formato corto.

1. Introducción: El doble avance en la generación de video con IA

Kling Motion Control resuelve dos de los cuellos de botella más dolorosos en la producción de formato corto — movimiento poco confiable y flujos de trabajo de audio separados — combinando control de movimiento basado en referencia con generación nativa de audio.

Basándonos en pruebas prácticas y experiencia en proyectos, esta combinación acorta los ciclos de iteración y produce clips utilizables y listos para publicar mucho más rápido que el enfoque antiguo de "video primero, audio después".

Por qué esto importa:

- Superior: Entregar una actuación repetible con sonido sincronizado en un solo trabajo.

- Medio: Reducir la necesidad de captura de movimiento, keyframing manual y pases separados de diseño de sonido.

- Básico: Ahorrar días de edición y reducir presupuestos de producción para contenido social y prototipos.

2. ¿Qué es Kling 2.6 Motion Control AI?

Kling 2.6 es un sistema de imagen a video basado en referencia que aplica el movimiento extraído de un clip fuente a una imagen objetivo mientras protege la identidad y el estilo.

En términos prácticos, el modelo ingiere una imagen fija (o un primer cuadro) más una referencia de movimiento, extrae señales esqueléticas y temporales, y renderiza un sujeto realizando ese movimiento — un flujo de trabajo que se siente más como manipulación que como adivinanza.

Estructura técnica:

- Superior: El codificador de movimiento lee la referencia y produce datos de pose/flujo cuadro por cuadro.

- Medio: Un renderizador mapea ese movimiento al sujeto objetivo mientras mantiene la consistencia facial y de estilo.

- Básico: Los pasos posteriores incluyen suavizado temporal, refinamiento de manos/cara y alineación opcional de audio para producir un clip cohesivo único.

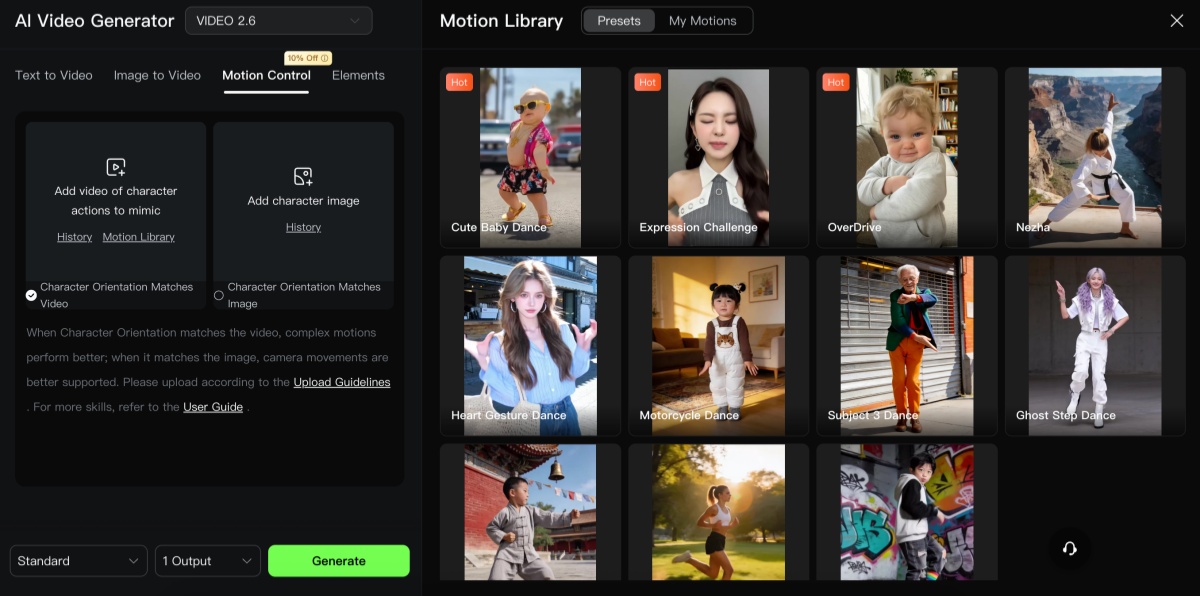

3. Capacidades centrales de Motion Control: Más allá de los prompts de texto

Kling 2.6 funciona como un motor preciso de transferencia de movimiento en lugar de un adivinador creativo; ese cambio transforma cómo se escriben los prompts y cómo se preparan los recursos.

Donde antes el texto tenía que describir coreografías complejas, la referencia de movimiento ahora suministra el movimiento y el prompt define la escena, el vestuario y el estado de ánimo.

Fortalezas principales

- Transferencia de movimiento de cuerpo completo: Replicación de poses con precisión cuadro a cuadro para danza, acrobacias y coreografía.

- Manejo de movimiento complejo: Funciona con acciones dinámicas (patinaje, artes marciales) cuando las referencias son limpias y bien encuadradas.

- Control fino: La articulación cercana de manos/dedos y microexpresiones mejoran con pases dedicados.

- Modos duales de orientación: Elige entre movimiento centrado en el personaje o trayectorias impulsadas por la cámara.

- Rol redefinido del prompt: Usa texto principalmente para establecer ambiente, vestuario e iluminación en lugar de describir cada acción de las extremidades.

4. Síntesis audiovisual con un solo clic

Kling 2.6 incorpora audio nativo — voz, efectos de sonido y ambiente — en la misma pasada de generación, lo que cambia materialmente el cálculo de producción: una sola renderización puede ser ahora un corte casi listo para postproducción.

Las pruebas en piezas promocionales cortas y fragmentos de diálogo mostraron que el audio integrado reduce las entregas y hace que las pruebas A/B de variaciones creativas sean triviales en comparación con la ingeniería de audio separada.

Cómo añade valor:

- Superior: Un clip de 5–15s puede llegar con diálogo sincronizado y efectos reactivos listos para usar.

- Medio: La generación de voz soporta múltiples idiomas y alinea fonemas con los cuadros de boca, mientras que los efectos se ajustan a la intensidad del movimiento (pisadas, impactos).

- Básico: Se añaden capas ambientales automáticamente para situar la escena y mejorar la credibilidad.

5. Comparativa de versiones: 2.6 vs 2.5 Turbo vs Kling O1

Kling 2.6 es la opción pragmática para fidelidad de movimiento y sincronización de audio; Kling 2.5 Turbo se centró en la adherencia al prompt y movimientos dinámicos de cámara; Kling O1 apunta a ser una plataforma multimodal unificada para flujos de trabajo de múltiples tomas.

Comparar estas opciones ayudó a definir qué modelo se usa para briefs específicos: 2.6 para salidas repetibles orientadas a la actuación, 2.5 para prototipos creativos rápidos, y O1 para edición o continuidad multi-toma.

Aspectos destacados de la comparación

- Precisión del movimiento: 2.6 lidera cuando una referencia del mundo real influye en el movimiento final.

- Descubrimiento creativo: 2.5 Turbo sigue siendo más rápido para visuales exploratorios y lenguaje dramático de cámara.

- Pipelines unificados: O1 es mejor para proyectos multi-toma que requieren edición consistente y continuidad entre tomas.

6. Dominando los Motion Tokens: El lenguaje de control

Los Motion Tokens actúan como una abreviatura determinista para extremidades, cámaras y microexpresiones; aprenderlos aumenta dramáticamente la predictibilidad de la salida.

Cuando los tokens se superponen después de una referencia limpia, las salidas se vuelven controlables de una manera que se asemeja a los pipelines tradicionales de animación pero con mucho menos trabajo manual.

Taxonomía de tokens

- Tokens de extremidades: Fijar o ajustar extremidades para interacciones con productos o ajustes coreográficos.

- Tokens de cámara: Comandos de dolly, paneo y rotación para movimiento cinematográfico.

- Micro tokens: Parpadeos, respiración y pequeñas señales faciales que hacen que los personajes se sientan vivos.

Flujo de trabajo práctico

- Bloquear poses amplias con tokens de extremidades.

- Añadir lenguaje de cámara para crear relaciones de movimiento.

- Terminar con micro tokens para vender realismo en primeros planos.

7. Resolución de problemas: Por qué la IA mueve las partes equivocadas

Los desajustes de movimiento casi siempre se deben a referencias problemáticas, instrucciones conflictivas o diferencias de escala; corregir esos tres elementos resuelve la mayoría de los problemas.

Un enfoque disciplinado en la captura y diseño de prompts previene iteraciones desperdiciadas y conserva créditos de cómputo.

Modos de falla clave y soluciones

- Referencias borrosas u ocultas: volver a grabar con mayor obturación y encuadre más limpio.

- Desajuste de escala/relación: recortar o elegir una referencia más proporcional al objetivo.

- Lenguaje conflictivo: evitar pedir una pose estática mientras se adjunta un clip de movimiento dinámico.

Cinco reglas de selección

- Usar clips de referencia de una sola toma sin ediciones.

- Igualar ángulo de cámara y encuadre del sujeto al objetivo.

- Preferir fondos lisos o pases de croma controlados.

- Capturar pases dedicados de manos/cara para microdetalles.

- Mantener iluminación consistente con el aspecto final deseado.

8. Kit de inicio de Motion Control: 10 prompts listos para usar

Una biblioteca concisa de prompts permitió iteración rápida en pruebas; estas plantillas se refinaron con trabajos reales y pueden usarse tal cual en la interfaz con ajustes menores de duración o tokens.

Plantillas representativas (solo en inglés)

- Transferencia de danza:

Apply motion from ref_dance.mp4 to subject.png; preserve identity; output 10s @24fps. - Pase de mano para producto:

Use ref_hand_demo.mp4 to show a product pass; keep camera dollied left-to-right; highlight product at 00:03. - Cámara lenta deportiva:

Map jump peak from ref_jump.mp4; emphasize frame 0.6s; add impact SFX.

Cómo iterar

- Comenzar conservador: duración corta, menos tokens, luego aumentar detalle una vez que el movimiento base sea correcto.

9. Aplicaciones en el mundo real: Quién ya está ganando

Los primeros adoptantes — creadores de formato corto, equipos de marca y cineastas independientes — encuentran la combinación de fidelidad de movimiento y audio nativo particularmente ventajosa para entregas rápidas.

Los casos muestran reducción de días de regrabación y ciclos de localización de anuncios más rápidos cuando se usa control de movimiento para estandarizar actuaciones en múltiples mercados.

Aplicaciones de alto impacto

- Creadores de formato corto: adaptaciones rápidas de danza y sincronización labial que escalan en canales.

- Marketing de marca: actuaciones consistentes y localizadas sin múltiples rodajes en estudio.

- Cineastas: previsión rápida y prototipado de actuaciones para bloqueos y revisiones creativas.

- Educación y entrenamiento: demos con precisión de cuadro para técnica deportiva o instrucción procedural.

10. Guía del usuario: Maximizando tus resultados

Los resultados mejoran dramáticamente cuando la captura y las elecciones de parámetros se alinean con las fortalezas del modelo; pequeños cambios en la técnica de filmación resultan en grandes disminuciones en reintentos de render.

Especificaciones prácticas

- Clips de referencia: apuntar a 3–30s; 24–60fps según la densidad del movimiento.

- Resolución: mínimo 720p, 1080p+ para fidelidad en primeros planos.

- Imagen objetivo: alta resolución, fondo neutro, ángulo de cámara similar a la referencia.

Lista de verificación para filmación

- Estabilizar la cámara; evitar vibraciones manuales cuando sea posible.

- Capturar pases separados de primeros planos para cara y manos si el detalle importa.

- Usar iluminación consistente y vestuario neutro para facilitar la transferencia de identidad.

Consejos para lotes

- Numerar y organizar activos, usar trabajos API asíncronos para poner en cola renders y automatizar la coincidencia de color en exportación.

11. Análisis de precios y ROI

Los trabajos de control de movimiento típicamente requieren más cómputo que un simple pase de texto a video, pero el costo total de la campaña suele disminuir al contar las regrabaciones evitadas y horas de edición.

Al presentar Kling 2.6 para una campaña, enmarca la comparación como costo de plataforma más días de estudio y horas de postproducción evitados.

Lista de verificación de ROI

- Calcular costo por minuto del modelo vs. día de estudio y honorarios de talento.

- Añadir costos evitados: viajes, regrabaciones, equipo de mocap, ciclos largos de edición.

- Usar créditos gratuitos para iteraciones conceptuales y reservar créditos pagados para renders finales.

12. Preguntas frecuentes: Todo lo que necesitas saber

Respuestas breves basadas en experiencia para preguntas operativas comunes.

- ¿Cómo eliminar la marca de agua? Los niveles pagos o licencias empresariales suelen eliminar marcas de agua.

- ¿Kling permite contenido NSFW? Aplican políticas y filtros de la plataforma; revisar términos de cuenta.

- ¿Los videos de Kling son privados? La privacidad depende de la configuración de cuenta y opciones de exportación/almacenamiento.

- ¿Duración soportada para referencia de movimiento? 3–30 segundos es un rango práctico para extracción robusta.

- ¿Múltiples personajes? Soportado con referencias multi-sujeto cuidadosas y tokens adicionales.

- ¿Voces personalizadas? Es posible subir audio personalizado; el audio incorporado puede generar voz y efectos sincronizados.

13. Veredicto final y cómo empezar — Conclusión

Kling 2.6 representa un salto práctico e inmediato en productividad: convierte el movimiento basado en referencia en una herramienta de producción repetible y combina ese movimiento con audio sincronizado en una sola pasada, lo que acorta el tiempo desde la idea hasta el clip publicable.

Las fortalezas son la fidelidad del movimiento, el audio integrado y la iteración predecible; las limitaciones persisten para estilizaciones extremas y referencias muy ocultas, donde la captura tradicional de mocap o estudio controlado aún ofrece ventajas.

Inicio rápido en tres pasos

- Graba un clip de referencia limpio de 5–12s (toma única, encuadre estable).

- Prepara una imagen objetivo de alta calidad que coincida en encuadre e iluminación.

- Realiza una prueba conservadora con tokens básicos, luego añade micro tokens para detalle.

Las afirmaciones sobre la arquitectura de control de movimiento de Kling y las capacidades de audio nativo se basan en documentación del modelo, referencias API y revisiones prácticas de Kling VIDEO 2.6 Motion Control y lanzamientos relacionados de Kling.