Guía definitiva sobre la censura en Kling AI

- 1. ¿Qué es Kling AI y por qué importa la censura?

- 2. ¿Qué tipo de contenido bloquea Kling?

- 3. ¿Cómo funciona la censura de Kling internamente?

- 4. Impacto en creadores y desarrolladores

- 5. Buenas prácticas al trabajar con modelos que incluyen censura

- 6. ¿Dónde encaja Kling en el ecosistema de modelos de video?

La censura en Kling AI no debe entenderse como un simple interruptor de “tema sensible activado/desactivado”, sino como una combinación de ingeniería de seguridad + cumplimiento normativo. Para decidir si Kling encaja en tu flujo de trabajo, es fundamental saber qué bloquea, por qué lo hace y cómo afecta a creadores y desarrolladores que solo quieren producir buen contenido en video.

Esta guía reúne lo que se conoce públicamente sobre Kling, cómo se comportan sus filtros en la práctica y cómo su enfoque se compara con las tendencias actuales de seguridad en modelos de texto a video. No es un manual para “saltarse” la censura, sino una visión práctica para que tomes decisiones responsables e informadas.

1. ¿Qué es Kling AI y por qué importa la censura?

Kling AI es un sistema de generación de video a partir de texto de alta capacidad, equipado con filtros estrictos y basados en políticas. Esto significa que la censura no es un efecto secundario, sino un componente fundamental del diseño del producto. Tal como destacan reportajes de TechCrunch, Kling opera dentro del marco regulatorio chino y no generará videos relacionados con temas políticamente sensibles u otros contenidos restringidos.

En la práctica, esto se traduce en:

- Algunos prompts devuelven un error como “Generation failed, try a different prompt.”

- Otros prompts generan un video totalmente seguro pero sin relación con la solicitud original.

- Las áreas “grises” (ej. comentarios políticos suaves, imágenes sugerentes) se manejan de forma conservadora: la plataforma prefiere bloquear antes que arriesgar.

Si estás comparando herramientas, una página de directorio sobre Kling AI podría resaltar su calidad de movimiento y coherencia temporal, mientras que esta guía se centra en lo que ocurre cuando tus ideas chocan con sus reglas de seguridad.

En el panorama general, el nivel de restricción de Kling no es único: proveedores como Google Gemini o Vertex AI documentan filtros de seguridad basados en daño con reglas similares, aunque ajustadas a políticas regionales distintas.

2. ¿Qué tipo de contenido bloquea Kling?

Kling bloquea muchos más tipos de contenido que una simple lista de contenido para adultos. Informes públicos y experiencias de usuarios confirman que los temas políticos se tratan con una severidad comparable al contenido NSFW, y que el contenido “casi sensible” se rechaza antes que permitirlo.

A grandes rasgos, los temas restringidos incluyen:

| Categoría | Ejemplos típicos | Respuesta habitual del sistema |

|---|---|---|

| Política & temas sociales | Protestas, disputas territoriales, críticas gubernamentales, figuras públicas en contextos sensibles | Bloqueo directo o error de generación |

| Contenido explícito | Desnudos, pornografía, fetiches, escenas altamente sugerentes | Bloqueo completo; no existe modo “adulto” |

| Violencia & gore | Heridas graves, ejecuciones, autolesiones, crueldad extrema | Bloqueo o sustitución por un video neutro |

| Actividades ilegales | Producción de drogas, tráfico de armas, terrorismo, planificación criminal | Bloqueo; a veces con advertencias de cuenta |

| Desinformación | Noticias falsas, propaganda estilo deepfake, rumores dañinos | Bloqueado o modificado drásticamente |

Este enfoque coincide con investigaciones como T2VSafetyBench, que define múltiples dimensiones de riesgo: pornografía, violencia, sensibilidad política, copyright, riesgos temporales y más.

Observaciones prácticas de usuarios:

- Los prompts políticos se bloquean incluso cuando son neutrales.

- No existe un “modo adulto”. Kling funciona como un entorno completamente seguro por diseño.

- Los prompts borderline suelen degradarse silenciosamente. El sistema no explica la razón.

Si tu trabajo incluye sátira, historias políticas o contenido más maduro, estas reglas pueden sentirse restrictivas; si construyes una plataforma familiar, pueden ser exactamente lo que necesitas.

3. ¿Cómo funciona la censura de Kling internamente?

Aunque Kling no revela su diseño interno, la documentación disponible y los patrones de la industria sugieren que usa múltiples capas coordinadas de filtrado:

1. Filtro a nivel de prompt

- El texto se analiza buscando entidades sensibles, palabras clave y riesgos semánticos.

- Si la puntuación de riesgo es alta, el sistema bloquea inmediatamente.

2. Generación condicionada por políticas

- Incluso si el prompt pasa el primer filtro, la generación está guiada por restricciones que evitan ciertos patrones visuales.

- Esto puede degradar conceptos o sustituirlos por imágenes neutras.

3. Revisión del video generado

- Un modelo de seguridad analiza los fotogramas del video para detectar:

figuras políticas, desnudos, sangre, violencia, etc. - Si detecta algo, descarta el resultado o lo reemplaza.

Estudios como SafeWatch y SAFREE describen sistemas de control similares, basados en múltiples etapas.

La clave es que esto es un sistema de seguridad, no un sistema configurable: el usuario no puede reducir los filtros.

4. Impacto en creadores y desarrolladores

Para los creadores y equipos de desarrollo, la censura de Kling representa un equilibrio entre cumplimiento legal, seguridad del usuario y libertad creativa.

Algunos efectos típicos:

-

Más prompts rechazados

Especialmente si trabajas en noticias, política o crimen real. -

Un vocabulario visual más limitado

Ciertos símbolos, banderas o personajes simplemente no aparecen. -

Iteraciones menos predecibles

Al no explicar los bloqueos, es difícil saber qué modificar. -

Menor esfuerzo de moderación

Para productos donde la seguridad es crucial, Kling reduce carga operativa.

En sistemas complejos, muchos equipos tratan a Kling como un motor dentro de un conjunto, no como el único.

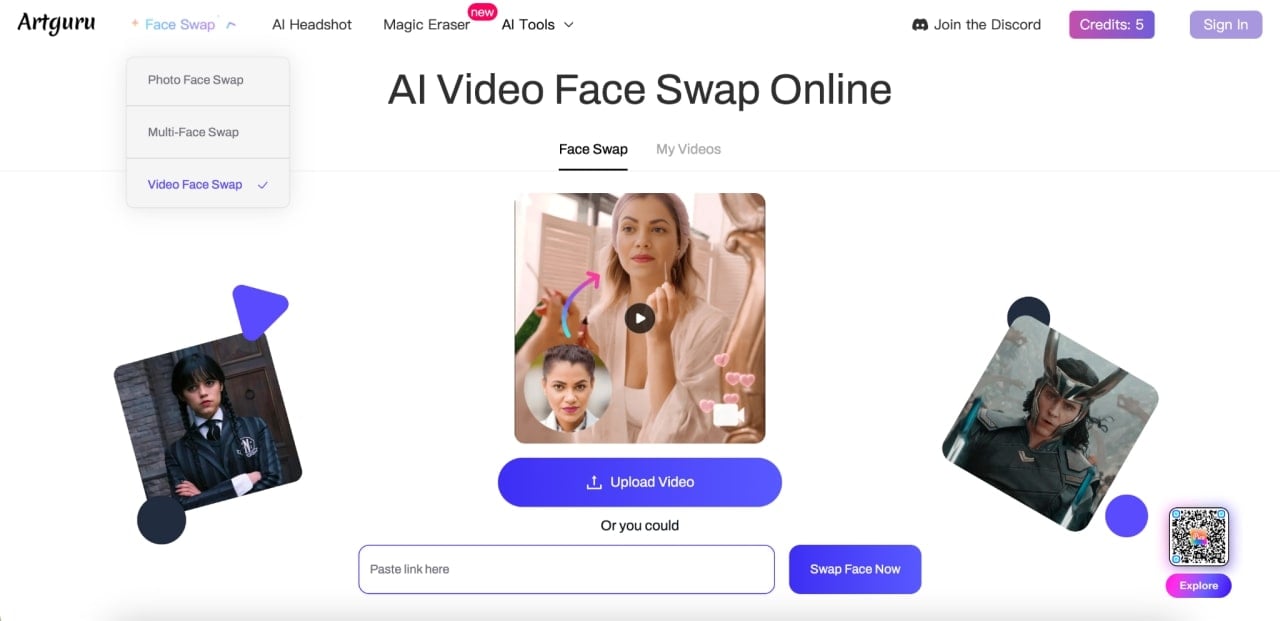

Por ejemplo, un panel de un AI video generator puede enviar temas “seguros” a Kling y dirigir temas más flexibles a otros modelos.

5. Buenas prácticas al trabajar con modelos que incluyen censura

La mejor estrategia es asumir los límites como fijos y diseñar dentro de ellos, no buscar formas de evitarlos.

Estudios muestran que algunos modelos visuales pueden ser “jailbreakeados” con prompts adversariales, pero estas técnicas violan los términos de uso y eliminan las protecciones diseñadas para seguridad de usuarios.

Recomendaciones responsables:

-

Diseña pensando primero en la seguridad.

-

Usa varios motores con propósitos distintos.

- GoEnhance AI → coordinar múltiples modelos.

- Kling → tomas cinematográficas seguras y de alta calidad.

- Otros → guiones gráficos, edición, subtitulado, etc.

-

Define tu propia política de contenido.

-

Prueba casos límite antes del lanzamiento.

-

Mantente actualizado con la documentación oficial.

Un ejemplo de matriz interna:

| Caso de uso | Tolerancia al rechazo | Necesidad de temas políticos / maduros | Enfoque recomendado |

|---|---|---|---|

| Contenido educativo infantil | Alta | Baja | Kling u otros modelos estrictos |

| Narrativas de marca global | Media | Baja–Media | Mezcla de motores estrictos y flexibles |

| Medios políticos o investigativos | Baja | Alta | Motores con reglas claras pero menos rígidas |

| Arte experimental / performance | Baja | Alta | Motores flexibles + revisión humana |

6. ¿Dónde encaja Kling en el ecosistema de modelos de video?

Kling debe verse como una opción dentro de un ecosistema creciente de modelos de texto a video, cada uno con un equilibrio diferente entre capacidad y seguridad.

Evaluaciones independientes demuestran que ningún modelo destaca en todas las categorías de seguridad.

Kling es una buena elección cuando:

- Prioriza la seguridad y el cumplimiento normativo

- El contenido es comercial, educativo o de entretenimiento

- Puedes tolerar rechazos ocasionales sin explicación

Considera combinar Kling con otros motores cuando:

- Necesitas libertad narrativa (historia, política, documentales)

- Comparas estilos, calidad de movimiento y filtros de varios video models

- Tu plataforma sirve a usuarios con distintos niveles de seguridad

En resumen:

La pregunta no es cuál modelo es mejor, sino cuál encaja mejor con tus necesidades y restricciones.

Reflexión final

La censura de Kling es intencional, sistemática y vinculada a políticas y requisitos legales—no es un error ni algo que el usuario pueda “desactivar”.

Al entender esto, podrás decidir con claridad cuándo usar Kling, cuándo recurrir a otros modelos y cómo mantener segura tu plataforma sin sacrificar creatividad responsable.

Como siempre, consulta regularmente la documentación oficial y evaluaciones independientes; las reglas y capacidades cambian rápidamente.