A2E AI Video Generator

A2E AI Funktionen für Avatar- und Talking-Photo-Videos

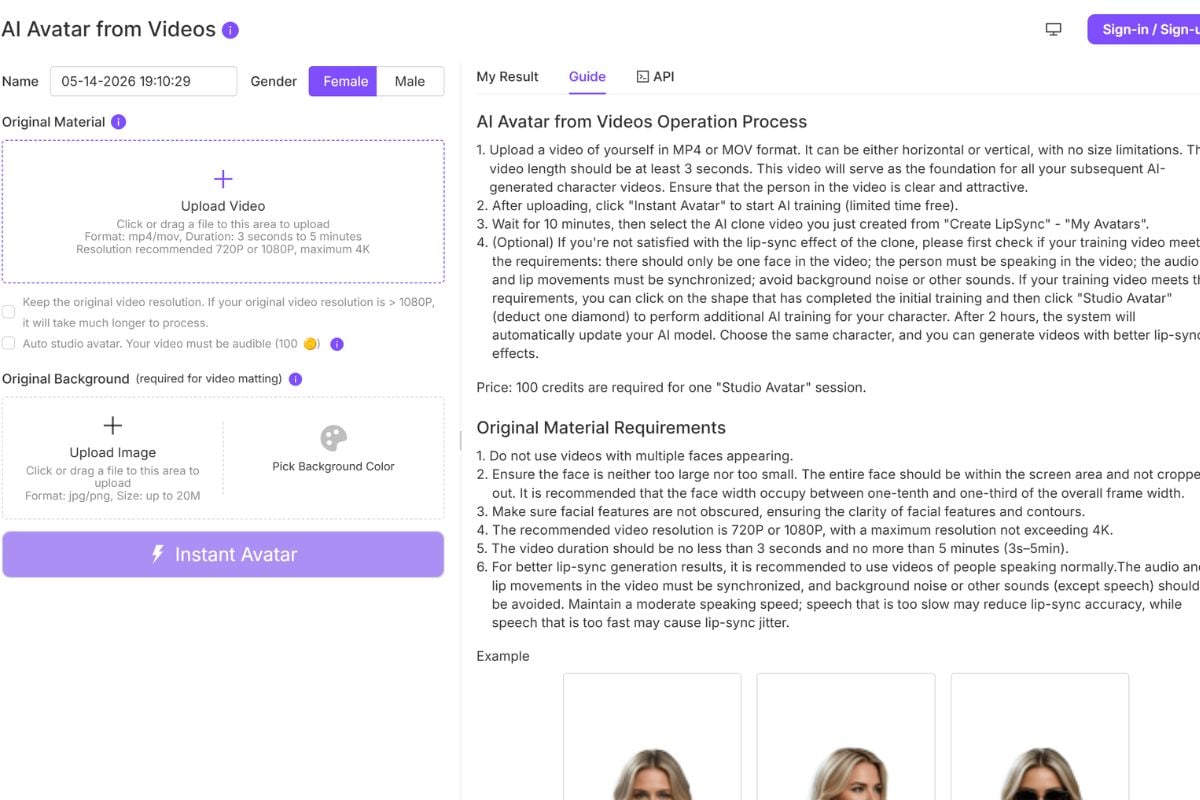

Lassen Sie Fotos in Sekunden sprechen

Verwandeln Sie ein klares Porträt in ein kurzes sprechendes Video mit Audio oder einem einfachen Skript. Dieses Format eignet sich gut für Grüße, kurze Lektionen, Produkteinführungen, Support-Nachrichten und Clips im Präsentationsstil, bei denen das Gesicht sichtbar bleibt und die Botschaft leicht zu verfolgen ist.

Stimmen mit natürlicher Gesichtsbewegung synchronisieren

Verwenden Sie A2E AI, wenn das Hauptziel darin besteht, eine Tonspur an ein sichtbares Gesicht anzupassen. Beginnen Sie mit einem kurzen Testclip und überprüfen Sie dann das Timing der Lippen, den Kopfwinkel, die Stabilität des Ausdrucks und den allgemeinen Realismus, bevor Sie eine längere Version erstellen.

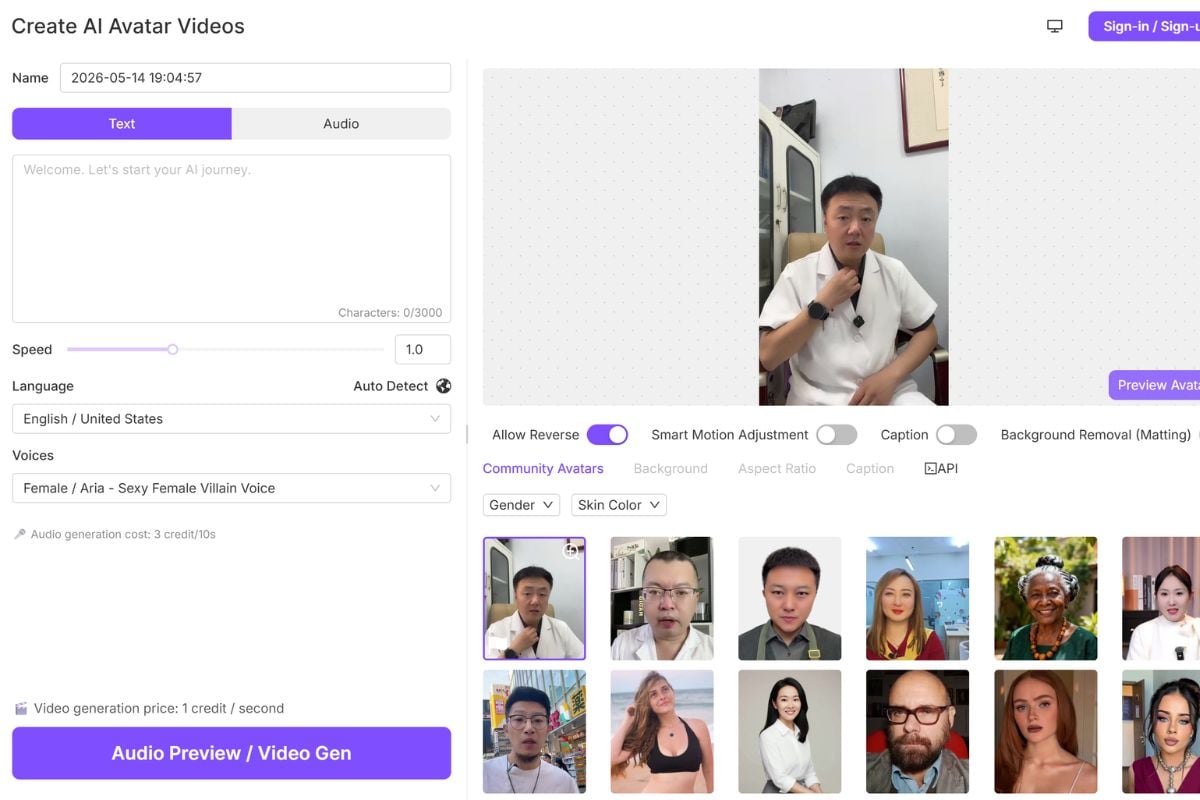

Avatar-Presenter-Clips erstellen

Erstellen Sie einfache Videos im Presenter-Stil für E-Learning, Kundensupport, soziale Medien und Produkterklärungen, ohne ein neues Talking-Head-Video aufnehmen zu müssen. Überprüfen Sie Identitätskonsistenz, Tempo, Gesichtsbewegung und Stimmanpassung vor der Veröffentlichung.

Warum A2E AI für gesichtszentrierte Video-Workflows wählen?

Mehrere Eingabewege

Avatar-fokussierte Ausgabe

Lip-Sync-Überprüfungsschleife

Creator-freundlicher Umfang

Umfassende Tool-Abdeckung

Praktische Qualitätsprüfungen

A2E AI-Funktionen für echte Creator-Workflows

- Talking Photo Video Generator: Animieren Sie Standporträts mit Sprache für kurze gesichtszentrierte Videos, Lektionen und Grüße.

- Lip-Sync-Video-Workflow: Stimmen Sie eine Tonspur auf ein vorhandenes Gesicht ab und halten Sie dabei die Kosten für Überprüfung und Neugenerierung überschaubar.

- KI-Avatar-Präsentator-Clips: Erstellen Sie Videos im Präsentator-Stil aus Porträts oder Avatar-Assets, ohne einen neuen Talking Head filmen zu müssen.

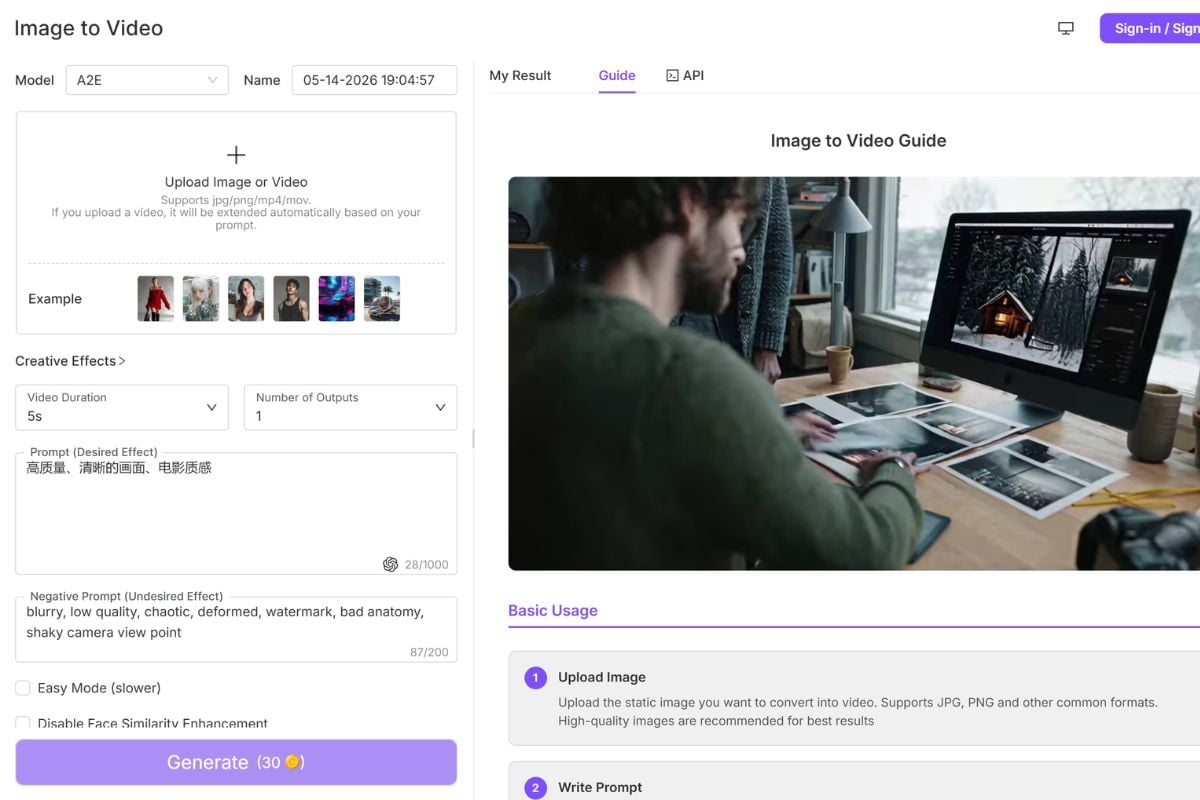

- Bild-zu-Video-Entwürfe: Verwandeln Sie Standbilder in Bewegungstests für kreative Konzepte, Produktideen und Charakter-Assets.

Talking Photo Video Generator

Lip-Sync-Video-Workflow

KI-Avatar-Präsentator-Clips

Bild-zu-Video-Entwürfe

Häufige Fragen zu A2E AI

Was ist A2E AI?

Was kann ich mit A2E AI erstellen?

Ist A2E AI gut für sprechende Fotos?

Unterstützt A2E AI Lip-Sync?

Wer sollte A2E AI verwenden?

Ist A2E AI sicher in der Anwendung?

Kann ich A2E AI für Marketing- oder kommerzielle Videos verwenden?

Wie erziele ich bessere Ergebnisse mit A2E AI?

Was sollte ich bei der Verwendung von A2E AI vermeiden?

A2E AI-Diskussionen auf Reddit

Bereit, Avatar-Videos mit GoEnhance AI zu erstellen?

Starten Sie mit Bildern oder Clips, testen Sie KI-Videoeffekte und verfeinern Sie die Ergebnisse in einem GoEnhance AI-Workflow, bevor Sie sie veröffentlichen.

Kostenlos starten